基于纹理谱的视频帧间篡改检测

2015-12-06林新棋林云玫林志新孔祥增严晓明

林新棋,林云玫,林志新,孔祥增,严晓明

(1.福建师范大学数学与计算机科学学院,福州350007;2.福建省网络安全与密码技术重点实验室,福州350117;3.电子科技大学信息与软件工程学院,成都611731)

基于纹理谱的视频帧间篡改检测

林新棋1,2,林云玫1,林志新3,孔祥增1,2,严晓明1,2

(1.福建师范大学数学与计算机科学学院,福州350007;2.福建省网络安全与密码技术重点实验室,福州350117;3.电子科技大学信息与软件工程学院,成都611731)

为提高视频篡改检测算法的准确率,提出一种基于纹理谱的时间域视频篡改检测算法。计算视频片段的纹理谱图像序列的相关系数,根据阈值法判定视频篡改位置。实验结果表明,该算法能准确检测出视频帧删除、复制以及插入3种篡改方式。在分辨率为352×288的视频片段上,平均每帧处理时间不超过0.4 s,而查准度和查全率全部超过94%。

纹理谱图像;视频篡改;相关系数;异常度;阈值

1 概述

随着计算机和各种多媒体相关的电子产品的普及,图像、视频逐渐成为人们生活中信息交流和传递的重要媒介,尤其是监控视频、新闻视频等与人们的日常生活息息相关。然而,各种操作简便的视频编辑软件可以免费下载,无需复杂的专业技术就可以对数字视频进行编辑修改,使得一些视频的真实性受到破坏,监控视频记录真实的情况被篡改,新闻视频反映的社会现象被歪曲,从而影响了人们的正常生活和正确判断。因此,视频的真实性、原始性的检测技术成为近十年国内外多媒体领域的一个研究热点,也是社会亟需解决的一个关键问题。

图像纹理不仅反映了图像的局部灰度或颜色变化,而且反映了图像的局部空间相关性,包含了物体表面结构组织排列的重要信息以及它们与周围环境的联系,是图像视觉内容的表示方法之一。相关文献已经证明了纹理是视频被动检测技术的一种有效可行的特征之一,但是采用纹理共生矩阵来表示,存在计算量大和无法检测删除操作的缺点。本文选择纹理谱方法表示纹理。首先计算视频片段的纹理谱矩阵序列,接着计算纹理谱矩阵序列的相关系数以及纹理谱的异常度序列,最后根据设定的阈值,判断异常度序列的异常度,超过阈值的位置即为被篡改的位置。

2 相关工作

近年来,视频篡改检测技术已取得一些建设性的成果。从发表的文献可以看出,视频篡改检测技术主要分为主动认证和被动检测2种技术。由于主动认证技术需满足的附加条件较多,如事先嵌入特定信息,这些嵌入的特定信息需要额外的硬件设备,提高了产品的价格,而且嵌入的信息或多或少都会影响视觉质量。因此视频篡改检测主要采用被动检测技术。这种技术借助视频数据本身的统计信息某方面的特征进行篡改检测,如设备噪声、运动矢量、预测误差、纹理、色彩等[1]。

基于噪声的视频篡改检测方法思想源于数字图像篡改检测,发展相对比较成熟。这种方法主要步骤是运用去噪方法估计设备的模式噪声,如CCD感光不均匀模式噪声、镜头透镜失真噪声等,然后采用相关性或聚类的方法,利用被篡改信息中隐藏的噪声特征的不一致性来检测是否被篡改[2-3]。但是这种方法不适用于同源篡改。

针对常用的视频编码格式,文献[4]提出二次压缩检测的视频篡改检测方法。随后,以二次压缩导致运动估计、量化误差、预测残差、块效应等不一致性为基本依据的相关研究成果被提出[5-7]。但是这些方法均与编码格式有关,是否适用其他编码格式尚未得到考证。

以视频内容为依据的研究方法受到重视。文献[8]提出基于Y分量相关性的视频篡改检测方法。文献[9]提出基于纹理共生矩阵的视频帧间复制、插入篡改检测方法。文献[10]提出基于颜色内容的视频帧间删除、复制、插入篡改检测方法。这类方法只跟视频内容有关,独立于编码格式、硬件等因素。

3 视频纹理谱表示

纹理谱方法是文献[11]提出的使用局部纹理模式作为纹理基元来分析纹理的一种方法。视频帧的局部纹理模式是一种体现视频帧内像素点领域内灰度变化的纹理结构,在这种结构下所产生的像素点的映射值(通常取值介于0~255的整数)称为该像素点的纹理谱值。灰度图像可以使用纹理谱图像来描述其纹理结构,如图1所示。

图1 视频帧的纹理谱图像

文献[12]首次提出局部二值模式(Local Binary Pattern,LBP)作为局部纹理模式。其基本思想是在图像或视频帧中的一个8-邻域,将邻域中心的像素值与邻域内其他位置的像素值进行比较,若该位置上的像素值不小于中心像素值,则将该点赋值为1,否则赋值为0,然后将处理结果与一个权值模板对应相乘求和,即得到LBP值[12]。尽管不断有人对纹理谱进行研究,提出很多改进方法,但是LBP理论简单,计算开销小,且能有效地刻画像素邻域内的灰度变化模式和空间相关性,因此,本文使用LBP来表示视频帧的纹理视觉内容。

对于给定的视频片段,其视频帧灰度图像序列表示为V={V(1),V(2),…,V(N)},第i帧视频帧的灰度图像V(i)用V表示,那么V就是一个二维矩阵,表示如下:

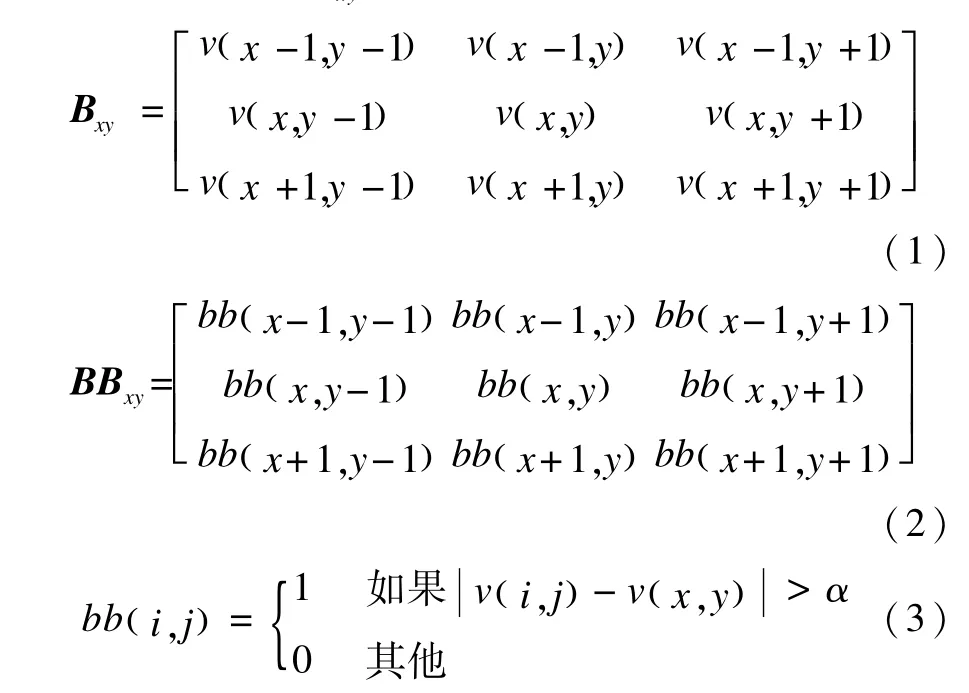

对于视频帧中(x,y)处的像素,其纹理谱值记为LBP(x,y),计算过程如下:

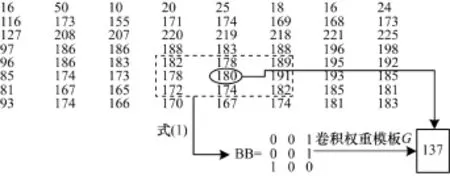

(1)获取视频帧中(x,y)处的8-邻域像素块,记为矩阵Bxy,如式(1)所示,将像素块Bxy中的每个像素按照式(3)转化为二值像素块,映射结果为同样大小的矩阵,记为BBxy,如式(2)所示。

其中,i∈{x-1,x,x+1},j∈{y-1,y,y+1}。这个映射过程很好地解释了像素(x,y)与周边像素的变化细节,变化大小依赖于阈值α。

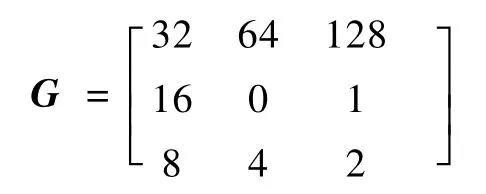

(2)选择合适的3×3权值模板,记为矩阵G,本文的权值模板为:

(3)将BBxy和权值模板G进行卷积,显然卷积结果介于0~255之间,卷积结果定义为LBP(x,y),具体如式(4)所示。

对V中可操作的每个元素按照上面3个步骤逐一进行计算,获得一个(n,m)二维数组LBP,数组中每个元素值是一个介于0~255之间的整数,将其视为灰度值,若LBP的显示结果是一幅灰度图像,称为纹理谱图像。图2是一个像素的纹理谱计算过程,将图中椭圆位置的像素180映射为纹理谱值137。

图2 纹理谱计算过程示意图

从图1(c)可知,灰度图像的纹理谱图像确实可以反映图像纹理的微观变化,而且这种微观变化能够以可视化的方式显示,比起纹理共生矩阵描述的图像纹理更加符合人类视觉习惯,因而在图像检索、计算机视觉、遥感图像分析等多个领域得到广泛应用。

综上可知,任何一个视频片段,都可以用一个纹理谱图像序列W={LBP(1),LBP(2),…,LBP(N)}来表示该视频片段的纹理视觉内容。

4 视频帧间纹理谱相关性

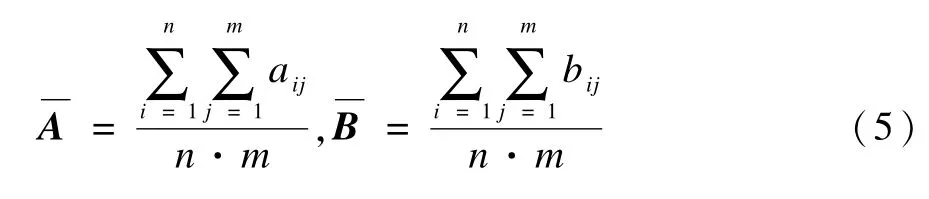

由上节可知,对于给定的视频帧,其纹理视觉内容可以使用纹理谱矩阵来表示,于是视频帧间的视觉内容相似性问题就转化为视频帧间纹理谱矩阵相似性问题。目前度量2个矩阵或数组之间的相似性经常采用相关系数,随后实验统计结果证实了本文采用相关系数度量矩阵间相似性的合理性。

对于2个给定的相邻视频帧,其视频帧纹理谱矩阵分别表示为A,B,如果帧的分辨率为(n+2)×(m+2),则纹理谱矩阵A,B均为n×m的矩阵,具体表示如下:

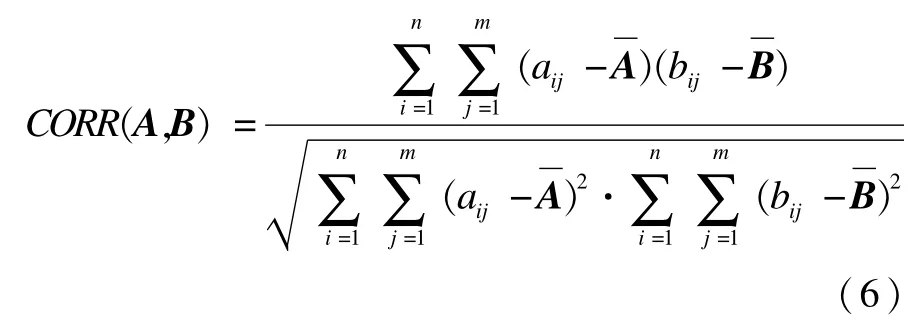

那么矩阵A和B之间的相关系数定义如式(6)所定义。

本文接下来的部分将借助矩阵之间的相关系数来度量视频帧之间的纹理谱相关性,从纹理方面体现视频帧之间的视觉内容相似性。

5 视频帧间纹理谱异常度

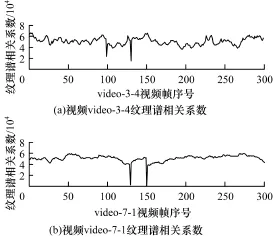

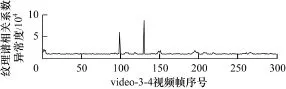

对于给定的视频片段,如果长度为N帧,那么根据第4节可以获得N-1个纹理谱相关系数,用一维数组CORR=[c1,c2,…,cN-1]来表示,则CORR(i)表示纹理谱相关系数CORR中的第i个系数,该值的大小度量了第i个视频帧和第i+1个视频帧之间的纹理谱相关程度。图3(a)、图3(b)是视频片段video-3-4和video-7-1的纹理谱相关系数曲线。

图3 纹理谱相关系数曲线

可以看出:纹理谱相关系数值随着帧序号改变而改变,时而大时而小,没有规律,不易发现其异常位置,直接根据纹理谱相关系数来判断视频片段是否被篡改容易做出错误的结论;另一方面,不同视频的纹理谱相关系数取值范围存在较大的差异,在阈值判决法中,难以选择恰当的阈值,容易造成错判和遗漏。

因此,本文对视频帧间纹理谱相关系数CORR引入度量分量异常程度的算子,期望这种算子能够有助于判定异常位置。

2000年,Breunig等人提出局部离群因子孤立点经典检测算法(LOF算法)[13]。该算法为每个数据建立一个离群因子模型来度量该数据的异常程度,不仅考虑到数据周围的密度,而且考虑到数据之间的距离,排除将具有相同密度而具有不同距离的数据点视为相同的异常程度,在数据异常检测中得到广泛的应用,因此本文采用该算法来度量视频帧间纹理谱相关系数的异常程度。下面3个子节给出相关的定义。

5.1 第k小距离

对于给定视频片段的纹理谱相关系数CORR=[c1,c2,…,cN-1],K为事先给定的一个正整数,现在将CORR中其他相关系数与CORR(i)的欧几里得距离中第k小的距离定义为第i个纹理谱相关系数的第k小距离,记为distk(i),如式(7)所示:

其中函数small返回集合中数据从小到大排序后的第k个最小值。

根据定义,distk(i)可以度量数据CORR(i)附近聚集k个数据的密集程度。显然该值越小,k个数据围绕在CORR(i)周围的密集程度的可能性越高,那么CORR(i)出现异常的可能性就降低了。因此,distk(i)在一定程度上刻画了数据CORR(i)的异常程度。但是该值无法反映所聚集的k个数据之间的分散情况。

5.2 局部密度

对于CORR(i),根据5.1节,指标distk(i)难以完全刻画数据CORR(i)的分散程度。本节利用数据间的距离来刻画数据的分散情况,由此引入局部密度的度量公式。

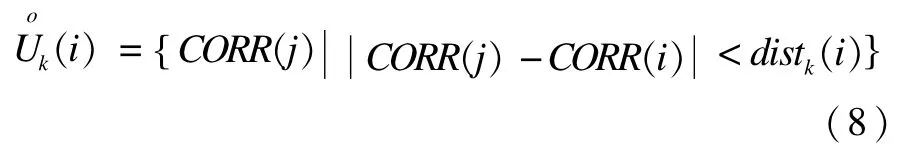

首先定义数据CORR(i)的distk(i)去心领域,具体如式(8)所示:

5.3 异常度

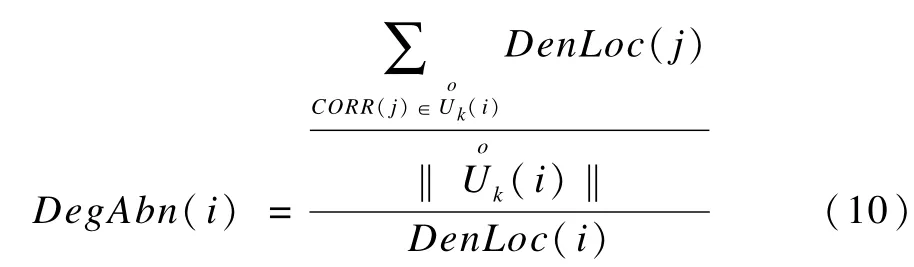

从5.2节可知,一维数据中的局部密度可以反映该数据的异常程度,但是一个数据的异常情况和其周围的数据密切相关,因此,对于数据CORR(i),将去心领域内数据的平均局部密度和数据CORR(i)的局部密度DenLoc(i)的比值定义为数据CORR(i)的异常度,记为DegAbn(i),如式(10)所示。

根据定义可知指标DegAbn(i)值的大小反映了纹理谱相关系数CORR=[c1,c2,…,cN-1]中第i个相关系数的异常程度。于是,对于给定的视频片段,通过上述公式,使用序列{DegAbn(1),DegAbn(2),…,DegAbn(N-1)}刻画该视频片段对应的纹理谱相关系数的异常度。

与图中video-3-4纹理谱相关系数相对的异常度曲线如图4所示。

图4 video-3-4纹理谱相关系数异常度曲线

从图3(a)难以确定纹理谱相关系数序列中是否存在异常现象。而图4明显地展示了纹理谱相关系数序列中存在2个异常数据。

因此,在纹理谱相关系数基础上引入的异常度算子是有效的、可行的,有助于揭露视频篡改的位置,对于检测视频片段是否被篡改是行之有效的。

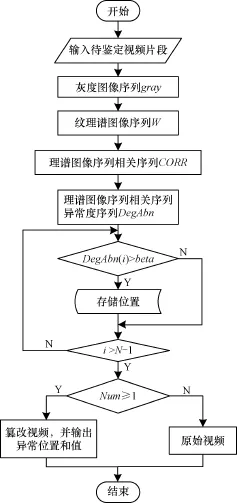

6 篡改检测算法

6.1 算法基本思想

对于单一镜头的视频片段来说,其视觉内容具有很高的相似性,对应的纹理谱图像序列也存在很高的相似性,因此,这样的视频片段的纹理谱相关系数变化幅度较小,相应的异常度变化比较平稳。如果对单一镜头的视频片段进行某些人为的篡改操作,那么视觉内容将会在篡改位置附近发生一些不易被人发现的微观变化,这种微观变化相对其他视觉内容来说可以看作是一个异常。在事先设定阈值的条件下,将纹理谱相关系数异常度序列中超过阈值的位置视为篡改位置,一旦某视频片段检测出异常位置,就认为该视频被人为篡改过。

6.2 算法流程

根据算法基本思想,结合时间域上视频帧间篡改流程、纹理谱矩阵、相关系数、异常度的理论框架,本文提出的算法流程如图5所示。

图5 本文算法流程

本文算法基本步骤描述如下:

(1)将待鉴定的视频片段读入M atlab操作系统;

(2)采用M atlab系统自带的函数rgb2gray()将彩色图像转化为灰度图像,灰度级为256;

(3)采用式(1)~式(4)计算该视频片段的纹理谱矩阵序列;

(4)采用式(5)~式(6)计算纹理谱矩阵序列的相关系数;

(5)采用式(7)~式(10)计算纹理谱矩阵序列相关系数的异常度序列;

(6)设定阈值beta=5,逐个判定异常度序列中是否存在超过阈值beta的异常度,并记录位置;

(7)如果存在异常位置,则判定输入视频片段被认为篡改过,否则认为是原始视频片段。

7 实验与结果分析

7.1 实验视频集与实验环境

为了评价所提出算法的性能,需要一个合适的篡改视频测试集合。目前,在视频篡改取证研究领域上尚未有公开的统一测试集,已有的各种算法都是使用自建的测试集来评价其性能,考虑到获取别人自建数据集的困难性,本文亦采用自建的数据集。

首先,从网上下载8个公开YUV格式的视频片段,分辨率均为352×288,长度有150帧、250帧、300帧和350帧,总长度为2 250帧,对现有的视频依次命名为video-i,i=1,2,…,8。其次,分别使用索尼HDR和佳能LEGRIA的数码摄像机拍摄MOV格式的视频片段video-9和video-10,长度分别为500帧和1 499帧,分辨率均为1 920×1 080。

于是本文使用的原始视频片段总共为10个,部分代表帧如图6所示。在此基础上,使用M atlab软件将视频片段转化为帧序列,格式为jpg;其次,对原始视频片段进行各种时间域上的篡改;最后,将篡改后的图像序列使用Matlab程序再次转化为视频片段。为了便于后面的实验,篡改后的视频片段命名格式为video-i-j,其中,i序号表示该视频片段videoi-j是由第i个原始视频video-i篡改而来的,具体通过一个视频片段来体现。video-3为原始视频片段,它有2个删除篡改操作,命名为video-3-1和video-3-2,1个插入篡改操作,命名为video-3-3,1个复制替换篡改操作,命名为video-3-4。其余类似,最后统计得:删除篡改操作共有7个视频片段,复制插入篡改操作共有5个视频片段,复制替换篡改操作共有4个视频片段,没有篡改操作的视频片段共有2个。实验环境:W indow7-64位操作系统,奔腾8600双核处理器,主频2.4 GHz,内存2.0 GB,硬盘容量250 GB,M atlab版本R2014a。

图6 原始视频的部分代表帧

7.2 算法参数

由于视频是高速的图像播放序列,根据人眼视觉特性,帧率最小值为24 f/s,因此LOFS算法中的第k小距离参数k取值24。

其他的2个参数通过实验总结获得,如表1所示。

表1 参数取值

7.3 实验结果

为了说明本文算法的效果,下面分别对每种篡改方式举一个例子进行详细说明。

7.3.1 删除

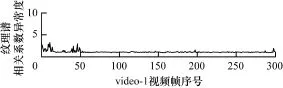

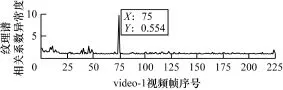

对于篡改视频片段video-1-1,该视频片段是原始视频video-1中第76帧~第149帧视频帧删除,目的是将穿黑色上衣男子放下皮包的过程删除,这样给人的错觉是皮包原本就在走廊的凳子上。图7和图8分别是原始视频video-1和篡改视频video-1-1的纹理谱相关系数曲线。

图7 video-1纹理谱值相关系数异常度曲线

图8 video-1-1纹理谱值相关系数异常度曲线

从图7可知,原始视频video-1中的纹理谱值相关性异常度均低于4,这表明原始视频片段中帧间相关性比较强。从图8可知,篡改视频video-1-1的纹理谱值相关性异常度曲线中存在一个明显的异常,位置在第75帧,其值等于9.774,大大超过本文所设置的阈值β=5。这表明第75帧和第76帧之间的纹理谱值相关性异常度比视频片段video-1-1中其他视频帧之间的纹理谱值相关性异常度要大很多,这种情况与操作在视频片段video-1上的删除篡改操作相吻合。综上可知,本文算法能有效地检测出时间域视频帧间删除篡改。

7.3.2 插入

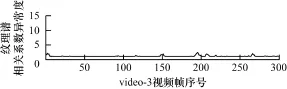

对于篡改视频片段video-3-3,该视频片段是将原始视频video-3中的第210帧~第230帧这21帧复制并插入到原来第149帧~第150帧之间生成的,目的是改变哑语所表达的意思。图9、图10分别是原始视频video-3和篡改视频video-3-3的纹理谱相关系数曲线。

图9 video-3纹理谱值相关系数异常度曲线

图10 video-3-3纹理谱值相关系数异常度曲线

从图9可知,原始视频video-3中的纹理谱值相关性异常度均低于5,这说明尚未篡改的原始视频片段的纹理谱相关性较大。从图10可知,篡改视频video-3-3的纹理谱值相关性异常度中存在2个明显的异常,位置在第149帧和第170帧处,其值分别大约等于13.38和10.28,大大超过本文所设置的阈值β=5。这表明第149帧和第150帧、第170帧和171帧之间的纹理谱值相关性异常度比视频片段video-3-3中其他视频帧之间的纹理谱值相关性异常度要大,这与实际将原来第210帧~第230帧这21帧复制并插入到原来第149帧和第150帧之间的篡改操作相符合。此结果表明本文算法可以检测出时间域视频帧间复制插入篡改,也就是可以检测出同源间插入篡改。

7.3.3 复制

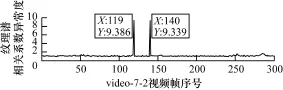

视频片段video-7-2是将原始视频video-7中的第220帧~第240帧之间的复制后替换原来第120帧~第140帧之间的帧而生成的。目的是将火车和球的运动顺序进行调整,给人的感觉是火车突然后退了的错觉。图11和图12分别是原始视频片段video-7和篡改视频片段video-7-2的纹理谱相关系数曲线。

图11 video-7纹理谱值相关系数异常度曲线

图12 video-7-2纹理谱值相关系数异常度曲线

从图11可知,原始视频video-7中的纹理谱值相关性异常度均低于2,这说明原始视频片段的纹理谱存在很强的相关性,进一步说明视频帧之间的视觉内容存在很大的相似性。从图12可知,篡改视频video-7-2的纹理谱值相关性异常度中存在2个明显的异常,位置在第119帧和第140帧处,其值分别大约等于9.386和9.339,大大超过本节所设置的阈值β=5。这表明第119帧和第120帧、第140帧和第141帧之间的纹理谱值相关性异常度比视频片段video-7-2中其他视频帧之间的纹理谱值相关性异常度要大得多,这与实际将原来第220帧~第240帧之间的帧复制后替换原来第120帧~第140之间的帧的篡改操作相符合。此结果表明本文算法可以检测出时间域视频帧间复制替换篡改。

7.3.4 篡改检测性能

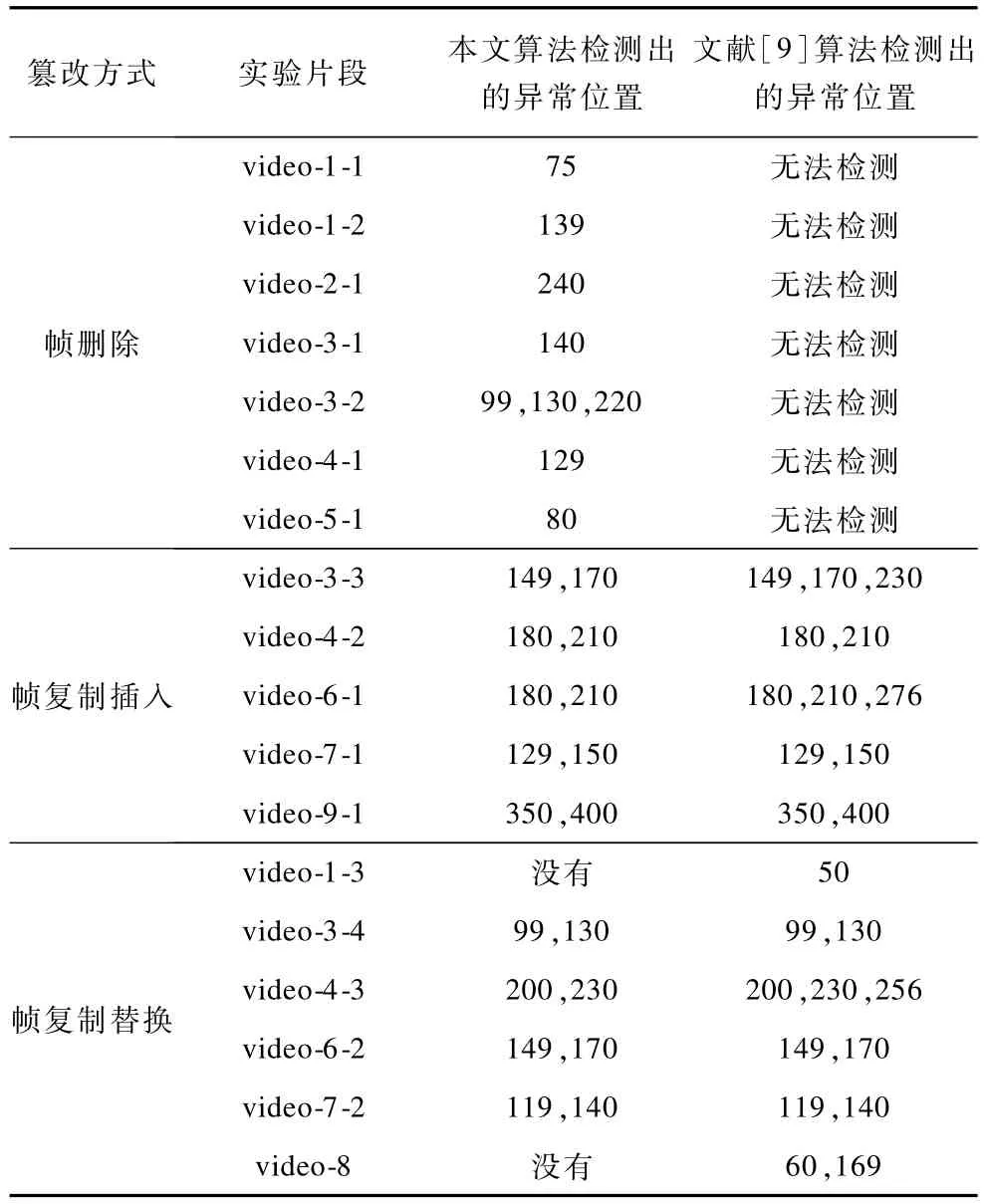

上文通过篡改和原始视频片段的纹理谱值相关性异常度曲线的对比证明了本文算法可以检测出视频帧间的删除、复制插入和复制替换3种时间域篡改。但是否具有普适性还有待于验证。表2为本文算法和文献[9]算法的检测结果。

表2 本文算法和文献[9]算法检测出的异常位置

如果实际篡改操作位置的异常点出现在检测表中,就断定该视频片段遭到人为篡改。进一步,采用信息检索领域中常用的查准率Rp和查全率Rr 2个指标来评价算法的性能。统计和计算结果如表3所示。

表3 统计和计算结果

7.4 结果分析

7.4.1 算法性能指标分析

从检测结果可以看到,无论使用哪种篡改方式,本文算法除了篡改视频片段video-1-3没有正确判断之外,其他的篡改或未篡改视频片段均能正确给出结果,因此本文算法具有很高的篡改检测效果。

对于篡改视频片段video-1-3,其纹理谱值相关性异常曲线如图13所示。

图13 video-1-3纹理谱值相关系数异常度曲线

从图13可以看出,实际上,相对本视频片段来说,在第50帧处异常达到最大值,而第50帧正是替换的最后一帧,从这个角度看,利用纹理谱相关性异常度可以检测出。而算法没有检测出的原因是因为该点的异常值没有超过事先预定的阈值β。

对于篡改视频片段video-3-2,虽然算法可以确定该视频是被认为的篡改。但是本来只存在1个异常位置,而算法却检测出3个异常为位置。

而文献[9]无法检测帧删除篡改,而且在插入和替换篡改方式中都存在误检的异常点,另外在替换篡改方式中也漏检一个异常点。由此可见,本文的算法比文献[9]算法具有更好的篡改检测效果。

表3数据表明,利用本文算法的篡改查准率和查全率比文献[9]算法均有了明显提高。本文算法的查准率为100%,比文献[9]算提高了9.09%。而查全率上,本文算达到94.44%,比文献[9]算提高了接近40%。统计指标显示了本文算法具有更高的查准率和查全率。

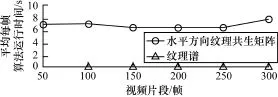

7.4.2 算法时间效率分析

本节分析算法的时间效率,用于分析的视频分辨率为352×288。将本文算法分别在50,100,150,200,250,300帧长度的若干视频片段上运行,将同一长度的视频片段运行所开销的时间按照式(11)计算平均每个视频帧的时间效率:

其中,si为长度为M帧的视频片段检测算法程序运行所需的时间;N表示总共有N个长度为M的视频片段。

另一方面,在同样的视频片段上,测试基于纹理共生矩阵的视频帧间相关系数计算算法的时间开销,这里计算的纹理共生矩阵仅仅是水平方向的,没有考虑其他方向,按照式(11)计算平均值,结果如图14所示。

图14 算法运行时间

从图14可知,本文算法运行时间基本比较稳定,在分辨率352×288的视频片段中平均每帧所需要的时间基本不超过0.4 s。而基于纹理共生矩阵的视频篡改检测算法运行时间基本上也比较稳定,但是其平均每帧的时间开销明显高于本文算法,基本在每帧7 s左右。所以,从时间效率上分析,基于纹理谱的视频篡改检测算法性能明显优于基于纹理共生矩阵的视频篡改检测算法。

综上可知,无论是从精确度指标或查全率指标,还是从时间效率分析,基于纹理谱的视频篡改检测算法性能明显优于基于纹理共生矩阵的视频篡改检测算法。

8 结束语

为能在准确地检测视频篡改的同时减少算法的运行时间,本文提出基于纹理谱的视频篡改检测算法,该算法简单,计算开销小。实验结果表明,本文算法可检测帧删除、帧插入和帧复制3种篡改方式。另外,本文算法未在异源篡改方式上进行分析,今后将在多镜头篡改类型上做进一步分析和研究。

[1] 谭茂洲,蒋兴浩,孙锬锋.视频篡改被动检测技术研究[J].信息安全与通信保密,2012,(3):68-69.

[2] 李晓梅.基于残留噪声相关性的视频篡改检测算法[J].信息技术,2013,(10):103-105.

[3] Kobayashi M,Okabe T,Sato Y.Detecting Video Forgeries Based on Noise Characteristics[C]//Proceedings of the 3rd Pacific Rim Symposium.Berlin,Germany:Springer,2009:306-317.

[4] Wang Weihong,Farid H.Exposing Digital Forgeries in Video by Detecting Double MPEG Compression[C]// Proceedings of the Multi-media and Security Workshop. New York,USA:ACM Press,2006:37-47.

[5] 秦运龙,孙广玲,张新鹏.利用运动矢量进行视频篡改检测[J].计算机研究与发展,2009,46(zl):227-233.

[6] Wang Weihong,Farid H.Exposing Digital Forgeries in Video by Detecting Double Quantization[C]//Proceedings of the 11th Workshop on Multimedia and Security. Washington D.C.,USA:ACM Press,2009:39-48.

[7] 王 琬,蒋兴浩,孙锬锋.基于首位数字特征的双重MPEG压缩检测算法[J].电子与信息学报,2012,34(12):3046-3050.

[8] 黄添强,陈智文,苏立超,等.利用内容连续性的数字视频篡改检测[J].南京大学学报,2011,9(5):493-504.

[9] 袁秀娟,黄添强,陈智文,等.基于纹理特征的视频篡改检测[J].计算机系统应用,2012,21(6):91-95.

[10] 李海涛,林新棋,吴 鹏,等.基于颜色内容一致性的视频篡改检测[J].福建师范大学学报:自然科学版,2014,30(2):26-33.

[11] He Dongchen,Wang Li.Texture Features Based on Texture Spectrum[J].Pattern Recognition,1991,24(5):391-399.

[12] Ojala T,Pietikainen M,Hardwood D.A Comparative Study of Texture Measures with Classification Based on Feature Distribution[J].Pattern Recognition,1996,29(1):51-59.

[13] Breuning M M,Kriegel H P,Raymond T N,et al.LOF:Identifying Density-based Local Outliers[C]// Proceedings of ACM SIGMOD International Conference on Management of Data.New York,USA:ACM Press,2000:427-438.

编辑 顾逸斐

Detection of Video Inter Frame Forgery Based on Texture Spectrum

LIN Xinqi1,2,LIN Yunmei1,LIN Zhixin3,KONG Xiangzeng1,2,YAN Xiaoming1,2

(1.School of Mathematics and Computing Science,Fujian Normal University,Fuzhou 350007,China;

2.Fujian Provincial Key Laboratory of Network Security and Cryptology,Fuzhou 350117,China;

3.School of Information and Software Engineering,University of Electronic Science and Technology of China,Chengdu 611731,China)

In order to improve the accuracy and time efficiency of the tam per video detecting algorithm,a new algorithm based on texture spectrum is proposed.The algorithm is implemented in three stages:firstly,the spectrum image sequences of the video clip is computed;then,the correlation coefficient and abnormality degree of texture spectrum image sequences are defined and calculated;finally,the forgery places are detected by threshold approach.Experimental results show that the proposed method can effectively localize the tamped position of the frame duplication,insertion,deletion tampers.The average consumption of time is 0.4 s per frame in resolution 352×288.The precision and recall are all exceeding 94%.

texture spectrum image;video forgery;correlation coefficient;abnormality degree;threshold

林新棋,林云玫,林志新,等.基于纹理谱的视频帧间篡改检测[J].计算机工程,2015,41(11):314-321.

英文引用格式:Lin Xinqi,Lin Yunmei,Lin Zhixin,et al.Detection of Video Inter Frame Forgery Based on Texture Spectrum[J].Computing Engineering,2015,41(11):314-321.

1000-3428(2015)11-0314-08

A

TP391.41

10.3969/j.issn.1000-3428.2015.11.054

福建省教育厅基金资助项目(JA12075,JA10064,JB11036);福建省科技厅高校产学合作科技基金资助重大项目(2012H6006);福建省高等学校科技创新团队基金资助项目(IRTSTFJ,J1917);福建师范大学创新团队基金资助项目(IRTL1207)。

林新棋(1972-),男,副教授、博士,主研方向:多媒体技术,编码理论;林云玫、林志新,硕士研究生;孔祥增,实验师、博士研究生;严晓明,副教授、硕士。

2014-09-15

2014-10-11 E-m ail:xqlin@fjnu.edu.cn