空中目标的多模跟踪算法研究*

2015-08-10陈金令崔宝明卜晓东

陈金令 冯 胜 李 娜 崔宝明 罗 文 卜晓东

(四川九洲电器集团有限责任公司 绵阳 621000)

1 引言

运动目标检测与跟踪是机器视觉研究的主要内容,它利用图像处理、目标检测、模式识别等技术对图像进行处理和分析,广泛应用于工业制造、智能监控、航空航天、智能交通等领域。国内外专家在这个领域进行了大量研究,目前有基于特征点的跟踪、基于模板匹配的跟踪、基于运动估计的跟踪、基于主动轮廓的跟踪等多种算法[1],但是这些算法各有其优缺点,有其适用的场景,并不能适用于所有的应用场合。

在这些方法中,基于模板匹配的跟踪算法利用目标的灰度信息进行相似度比对,找出最合适的位置进行跟踪,可适应较复杂场景下的目标跟踪,具有较强的抗干扰能力[2];基于特征点匹配的跟踪算法对目标的角点进行检测,对图像的旋转和噪声干扰具有较好的抗干扰能力[3];基于运动估计的跟踪算法利用目标运动状态的连续性和目标过去的运动状态来预测目标的运动状态和位置信息,具有一定的抗遮挡能力[4]。对目标的遮挡问题进行分析可以得出:当遮挡出现时,模板匹配算法的相关系数开始降低,遮挡部分越多相关系数就越小,当目标离开遮挡后,相关系数又逐渐增大最终达到稳定状态。由此可见,在遮挡过程中,相关系数先逐渐缩小,达到一个极值后逐渐增大[5~7]。因此本文提出了一种多模式融合的跟踪算法,综合运用模板匹配、特征点匹配、Kalman滤波等跟踪算法,以达到较好的跟踪效果。其中,模板匹配跟踪算法应用于背景复杂、目标未发生遮挡的情况,特征点匹配则在目标发生部分遮挡进行跟踪,而Kalman滤波则用于预测目标位置,减少运算量,并在目标丢失时继续预测目标位置[8~10]。实验证明该算法可以有效地提高目标跟踪的稳定性和鲁棒性。

2 模板匹配

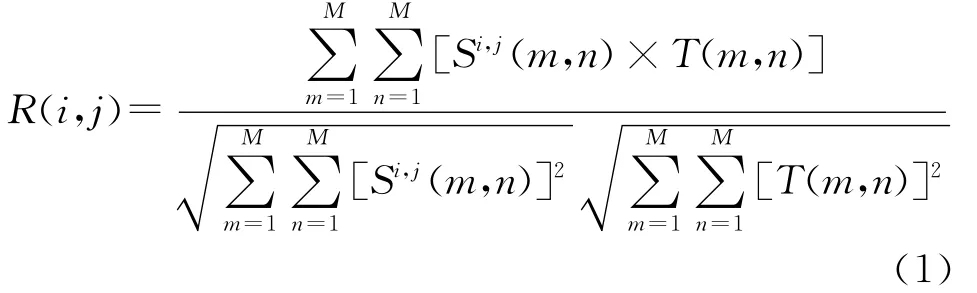

模板匹配算法是以图像灰度信息直接进行匹配,利用相关函数来判定匹配程度,因此可以适应复杂的图像背景。本文采用经典互相关相似性测度,以归一化的相关函数来进行相似度计算,其表达式为

其中:模板为T(m,n),搜索区域为S,Sij(m,n)表示模板覆盖下的子图,i、j表示位置,m、n表示模板的宽和高。R(i,j)在0~1之间取值,当且仅当模板和子图完全一致时,R(i,j)取得最大值1。所以,最佳的匹配位置就是图像上能够使R(i,j)取得最大值的位置。但是,这种算法需要对整幅图像进行遍历,计算量很大,而Kalman滤波可以预测目标的大致位置,在目标大致位置处进行小范围遍历可以减少计算量,因此本文采用Kalman跟踪算法对目标的位置进行预测,只在预测位置附近的较小范围进行模板匹配,可以大大减少运算量,满足实时性要求。但是,该算法在目标发生遮挡、变形时,跟踪效果不好,因此需结合其它算法来提高跟踪的可靠性。

3 SUSAN角点匹配

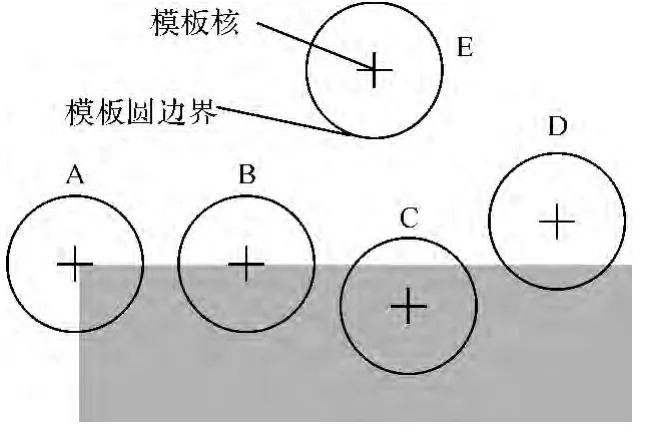

SUSAN算法是基于灰度信息的特征点获取方法,抗噪声能力强,运算速度快,适用于实时图像处理。算法使用一个圆形模板在图像上移动,模板核(模板中心像素)与模板内某点进行灰度值比较,其差值小于给定的阈值,则模板核与该点的灰度值相近,满足这样条件的像素组成的区域称为USAN(Univalue Segment Assimilating Nucleus)区域,如图1所示,当模板圆在图像上移动时,USAN区域的面积大小会发生变化。当模板核与角点A一致时,USAN区域面积达到最小,根据这个特性可以确定图像中的角点。

图1 模板在不同位置时的USAN区域

SUSAN算法可快速检测出目标的角点和边缘,因此当目标被部分遮挡时,可以根据目标的角点及边缘特征,采用SUSAN算法继续跟踪目标。

4 Kalman滤波

为了满足目标跟踪实时性的要求,应尽量缩小模板匹配算法的搜索范围。本文采用Kalman滤波算法预测下一帧图像中目标的位置,从而缩小目标搜索范围。并且当目标被遮挡时,目标将从图像中暂时消失,此时可利用目标的预测位置来代替目标的实际位置,直到目标重新出现并与保存的模板能够匹配,则重新采用模板匹配算法进行跟踪,或者目标丢失的帧数超过设定值,则判断为目标丢失,此时结束目标的跟踪。

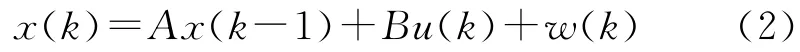

Kalman滤波是基于系统先前的状态对下一个状态做最优估计,通过状态方程和观测方程来描述系统。

状态方程:

观测方程:

式中,x(k)、x(k-1)分别为k、k-1时刻系统的状态向量;A为k-1至k时刻的状态转移矩阵;B是系统控制作用矩阵;u(k)是系统的确定性输入,Δt为连续两个状态之间的时间差;H为状态向量与观测向量之间的联系矩阵;z(k)是k时刻的状态观测向量;w(k)是过程噪声;v(k)是测量噪声;w(k)和v(k)相互独立。Kalman滤波算法包括初始化、运动轨迹预测和观测值修正等三部分。首先,确定状态方程的初始值,将检测到的目标位置、速度、加速度等值设置状态方程,如果目标的位置、速度和加速度等状态参数未知,则赋值为零;然后通过目标的当前状态来预测运动目标在下一帧的状态,进行状态估计;最后修正状态估计,作为下一时刻预测状态估计的输入值。循环上述步骤,就可以实现对运动目标的跟踪。

5 多模跟踪算法

本算法根据相关系数在遮挡情况下的变化规律,采用相关系数作为相似度度量准则来判定目标的遮挡程度,进而选择合适的算法来进行跟踪。设置阈值λ1和阈值λ2(λ1>λ2),将目标的跟踪状态分为目标未遮挡、部分遮挡和全遮挡三个状态[11~13],具体算法步骤如下:

1)当相关系数大于阈值λ1,即R(i,j)>λ1成立,说明此时目标未发生遮挡现象,此时应采用模板匹配算法,则将匹配跟踪的结果作为Kalman跟踪算法的观测值,进行下一时刻目标运动的估计,并计算相关系数,在此阶段,相关系数高于阈值λ1,因此每帧都进行模板更新,同时将目标匹配模板存为备用模板并替换原备用模板;在检测出目标后,先使用Kalman滤波估计出目标下一时刻可能出现的位置,再利用模板匹配算法在以该位置为中心的小区域内进行搜索,确定目标的最终位置。

2)当相关系数小于阈值λ1而高于阈值λ2时,即λ1≥R(i,j)≥λ2成立,此时应为目标被部分遮挡、形变、光照变化等因素影响了跟踪效果,导致当前模板和目标的匹配度较低,模板匹配算法已不适合,而SUSAN算法可检测出角点和边缘,抗局部噪声能力强,因此算法采用SUSAN角点算法来继续跟踪。

3)当物体发生全部遮挡,本算法将相关系数小于阈值λ2(即R(i,j)<λ2)定义为目标发生全部遮挡,SUSAN角点算法也已无法准确跟踪,应采用Kalman滤波算法对目标的位置进行预测,在短时间内对目标进行跟踪,同时将备用模板继续在跟踪位置附近进行比对,当目标重新出现时,备用模板就可以与目标匹配,直到相关系数高于阈值λ1,则继续采用模板匹配算法;如果超出设定的帧数相关系数依然无法高于阈值λ1,则结束跟踪流程。

6 实验结果与分析

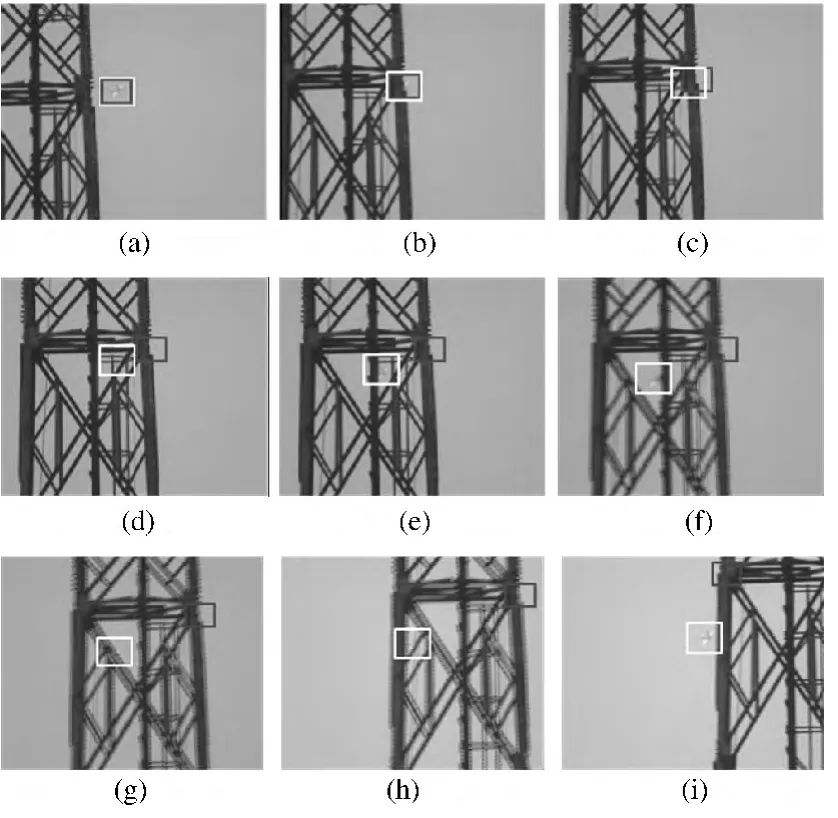

实验对模板匹配算法和本文算法进行了比较,如图2所示。目标为空中的飞机,对目标飞过遮挡物的过程进行跟踪,白色矩形框为多模跟踪算法的目标跟踪位置,黑色矩形框为模板匹配算法的跟踪位置。整个过程分为目标为被遮挡、部分遮挡和完全遮挡几个状态,图2(a)和图2(i)为目标未被遮挡时的图像,由模板匹配算法来确定跟踪位置,此时R(i,j)>λ1,每帧都需要模板更新;图2(b)是目标被部分遮挡的情况,即λ1≥R(i,j)≥λ2,此时应采用SUSAN角点匹配算法进行跟踪;图2(c)、(d)、(e)、(f)、(g)、(h)则是目标大部分或完全被铁塔遮挡,模板匹配计算得出的相关系数低于阈值λ2,即R(i,j)<λ2,此时采用 Kalman跟踪算法预测目标的位置,目标仍然可以稳定跟踪。而模板匹配方法的目标模型受背景影响,模板已不能反映飞机原来的特征,因此发生匹配错误,黑色跟踪区域停留在错误位置。实验证明,尽管目标发生了遮挡和旋转等情况,但是多模融合的跟踪方法依然可以对目标进行稳定跟踪。

图2 实验结果

7 结语

为了提高目标跟踪的稳定性和实时性,本文提出了一种多模式融合的目标跟踪方法,该算法融合了模板匹配、SUSAN角点匹配以及Kalman滤波等算法的优点:在背景复杂的环境下采用模板匹配算法,部分发生遮挡时则采用SUSAN角点匹配,在全遮挡的情况下采用Kalman滤波对目标运动状态进行预测。实验结果表明,该算法有效减少了计算量,提高了目标跟踪的实时性,并且在目标形变、光照变化、遮挡等情况下仍能保持对目标的稳定跟踪。

[1]林明秀,刘伟佳,徐心和.基于模板匹配的多模式车辆跟踪算法[J].系统仿真学报,2007,19(7):1519-1522.

[2]朱永松,国澄明.基于相关系数的相关匹配算法的研究[J].信号处理,2003,19(6):531-534.

[3]刘彬,李学斌.角点匹配与均值漂移相结合实现目标跟踪[J].计算机应用与软件,2013,30(4):239-243.

[4]陈少华,闫钧华,朱智超,等.基于Kalman预测和自适应模板的目标相关跟踪研究[J].电子设计工程,2011,19(11):189-192.

[5]郝志成,高文.多模跟踪技术在轮式侦察车图像处理器的应用[J].中国光学,2011,4(5):480-487.

[6]陈爱华,孟勃,朱明.多模式融合的目标跟踪算法[J].光学精密工程,2009,17(1):185-190.

[7]Pan Zhou-jin,Wang Xiu-juan.Correlation Tracking Algorithm Based on Adaptive Template Update[J].Proc.IEEE Conf.on Image and Signal Processing,2010:98-101.

[8]陈小林,赵建,王延杰.多模实时跟踪算法研究[J].仪器仪表学报,2009,30(6):204-208.

[9]柴宏亮,许鹏程,杨莉,等.一种多模式融合的红外成像跟踪算法[J].制导与引信,2006,27(2):31-35.

[10]Dorin Comaniciu,Peter Meer.Mean Shift:A Robust Approach Toward Feature Space Analysis[J].IEEE Transactions on Pattern Analysis and Machine Intelligence(S0162-8828),2002,24(5):600-619.

[11]刘扬,张云峰,董月芳.复杂背景下抗遮挡的运动目标跟踪算法[J].液晶与显示,2010,25(6):890-895.

[12]郑林,韩崇昭,左东广,等.一种基于集中式融合的多模型图像跟踪系统[J].信息与控制,2003,32(4):380-384.

[13]Khan Z H,Gu I Y H.Joint Feature Correspondences and Appearance Similarity for Robust Visual Object Tracking[J].IEEE Transactions on Information Forensics and Security,2010,5(3):591-606.