基于局部精确直方图匹配的无人机景象匹配导航色彩恒常算法

2015-06-05靳珍璐赵春晖魏妍妍马娟娟

靳珍璐,潘 泉,赵春晖,魏妍妍,马娟娟

(西北工业大学 信息融合技术教育部重点实验室 自动化学院,西安 710072)

基于局部精确直方图匹配的无人机景象匹配导航色彩恒常算法

靳珍璐,潘 泉,赵春晖,魏妍妍,马娟娟

(西北工业大学 信息融合技术教育部重点实验室 自动化学院,西安 710072)

为了解决无人机景象匹配导航中实时图和基准图之间的色彩差异性问题,提出了一种基于局部精确直方图匹配的色彩恒常算法。将实时图分成一系列子块图像,根据景象匹配辅助导航系统预测的无人机位姿信息,获得实时图与基准图的粗略对应关系,考虑平移、尺度、旋转等补偿,选取基准图中与实时图子块对应的基准图子块,求解每对子块图像红、绿、蓝颜色通道色彩直方图的颜色映射关系,并根据建立的颜色映射关系,对实时图子块的三个颜色通道进行变换,从而降低实时图与基准图之间的色彩差异。试验结果表明,所提色彩恒常算法对光源颜色估计的欧拉角误差约降低到传统色彩恒常算法的

20%,相比于不采用色彩恒常处理的景象匹配算法,将景象匹配平均误差降低了约70%,由于算法中引入了分块处理机制,能够克服多光源成像导致的色彩差异,具有并行计算的优势,便于工程应用。

色彩恒常;局部精确直方图匹配;几何校正;景象匹配导航;无人机

景象匹配辅助导航[1-3]具有无源性、自主性、廉价性和可靠性等优点,是自主导航领域的研究热点之一。景象匹配辅助导航技术已广泛应用于自主地面机器人、无人车、无人机、深空探测器和水下机器人等。无人机的景象匹配视觉导航[4]作为惯性导航的一种重要备份手段,其原理是将机载视觉传感器实时采集到的场景图像(实时图)与预先存储的卫星基准数据库图像(基准图)进行图像匹配,进而获取实时图在基准图中的精确位置,实现对无人机的精确定位和导航。

由于实时图和基准图通常是在不同时间、不同环境条件下拍摄的图像,其场景光照以及成像噪声、快门速度、曝光度等成像参数存在着不可避免的差异性。因此,对同一地物场景拍摄的实时图和基准图之间存在着颜色差异,直接影响景象匹配过程中的图像预处理、适配区选取、特征提取、甚至特征匹配,最终会导致无人机位置估计的不精确和不可靠,并且会大幅增加景象匹配算法的复杂度。为此,研究色彩差异性问题对于视觉导航、目标识别、场景感知、图像融合等工程应用具有很大的研究价值[5]。

解决色彩差异性问题的关键在于,当照射到物体表面的光照颜色发生变化时,确保物体的颜色在视觉系统中保持不变,视觉系统的这种特性被称为“色彩恒常性”[6]。色彩恒常处理能够消除光源颜色的影响,并近似得到物体真正的颜色,是一类解决色彩差异性问题的方法。

Gijsenij等[6]将色彩恒常算法分为三类:统计类方法、色域映射方法、机器学习方法。统计类方法是指采用固定的参数进行色彩恒常处理,如Grey-World算法[7]、White-Patch算法[8]、Grey-Edge算法[9]等。色域映射算法[10]的原理是,假设在某种光源下只能观察到有限的色域,而图像颜色的变化是由光源颜色的变化引起的,因此可以通过计算标准光源和未知光源之间的色域映射关系估计光源的颜色。机器学习方法通过机器学习的方式从训练数据集构建模型,并以此为特征来估计光源的颜色,如神经网络方法[11]、支持向量回归[12]等。

目前众多的色彩恒常方法对不同种类的图像很难具有普适性,Morovic等在文献[12]中指出应当通过研究不同图像特征对色彩恒常性的影响来决定选取何种方法。经过研究图像色域这一初级特征,Morovic等将研究重点集中在更高级的图像特征,即图像直方图[12]。在文献[13]中,Morovic等提出了一种快速而精确的直方图匹配算法(Exact Histogram Matching, EHM),当两幅图像的相似性较高时,该方法具有很好的色彩恒常处理效果。

针对景象匹配辅助导航中实时图和基准图之间存在的色彩差异性问题,为了进一步提高色彩恒常性处理的精确性和可靠性,本文提出了一种基于局部精确直方图匹配(Local Exact Histogram Matching, LEHM)的色彩恒常算法。利用景象匹配辅助导航系统的预测位置,得到实时图和基准图之间的粗略对应关系,采用所提色彩恒常算法降低它们之间的色彩差异,确保二者直方图在 RGB色彩空间中的一致性,进而提高景象匹配辅助导航的定位精度。

基于局部精确直方图匹配的色彩恒常算法,将实时图分成一系列子块图像,利用导航系统预测的位姿信息得到实时图与基准图的粗略对应关系,考虑平移、尺度、旋转等补偿,选取基准图中与实时图子块对应的基准图子块,对每一对实时图子块和基准图子块分别计算其红(R)、绿(G)、蓝(B)色彩直方图,求解其色彩直方图的颜色映射关系,并根据每对图像子块三个颜色通道的直方图颜色映射关系,对实时图子块的三种颜色进行变换。该方法考虑了平移、尺度、旋转等补偿,可以提高颜色校正的精确性。通过引入分块处理机制,该方法还可以克服多光源成像导致的色彩差异,同时具有并行处理的潜力,能够提高运算的实时性,便于实际工程应用。此外,经过一次色彩恒常处理和景象匹配之后,还可以选择根据新得到的无人机位姿信息进行第二次色彩恒常处理,以获得更优的色彩恒常性。

1 直方图匹配

1.1 传统的直方图匹配

传统的直方图匹配(Histogram Matching,HM)方法是通过累积分布函数计算直方图之间的强度映射关系,对原始图像的强度进行调整,使其直方图与参考图像直方图相近,从而解决同一场景在不同成像条件、不同光照情况,或者不同成像系统中获得的两幅图像之间的强度差异性问题[13]。该方法的优点是不需要像其他色彩恒常算法一样建立相机成像模型,并且能够消除颜色的线性差异以及伽马效应之类的非线性差异[14]。

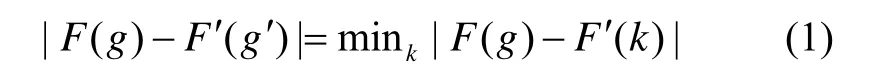

直方图匹配方法首先需要计算原图I′的直方图H′和参考图像I的直方图H;其次,计算各自的累积分布函数F′和F;然后,对于参考图像直方图中的任一强度值 g∈[0,255]在原图像直方图中确定一个与其对应的强度值g′,使其满足下式:

并且,g′∈[0,255];最后,构建直方图强度映射关系M(g′)=g,并采用该映射关系调整原图像每一个像素处的强度值,从而达到强度校正。直方图匹配算法的原理如图1所示。

图 1 直方图匹配算法原理Fig.1 Principle of histogram matching algorithm

1.2 精确直方图匹配

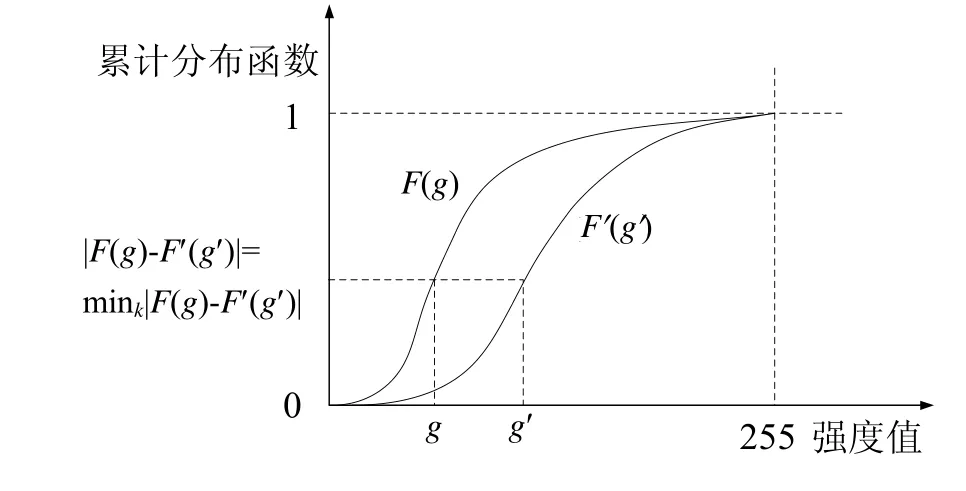

传统的直方图匹配方法是单值、单调增加的变换,无法确保强度变换的精度[13]。为此,Morovic等人提出了精确直方图匹配算法(EHM)[13],该方法能够精确、快速地实现图像的强度校正。EHM算法的原理如图2所示。

图 2 精确直方图匹配算法原理Fig.2 Principle of exact histogram matching algorithm

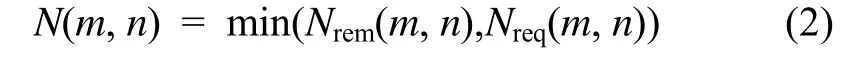

EHM 算法中的强度变换也是通过构建强度映射关系实现的,该变换是对直方图中从小到大的每一个强度值独立实施变换的。在实施变换的每一步需要计算两个变量:原始直方图中强度值保持为m的像素个数Nrem(m,n),目标直方图中需要赋予新的强度值n的像素个数 Nreq(m,n)。因此,在所构建的强度映射关系中,被赋予新的强度值的像素个数则为N(m, n):

以图2为例,对于原始直方图I′中强度值为m = 1以及目标直方图I中强度值为n = 1这一步对应的变换,有Nreq(m, n) = 2,以及Nrem(m, n) = 3。因此,被赋予强度值n = 1的像素个数为N(m,n)=min(3, 2)=2。同理,对于m = 1,n = 2,有Nreq(m, n) = 3,以及Nrem(m, n) = 1,则被赋予强度值 n = 2的像素个数为 N(m, n)= min(1, 3)=1。以此类推。关于该方法的描述和讨论详见文献[13]。

2 基于局部精确直方图匹配的无人机景象匹配导航色彩恒常算法

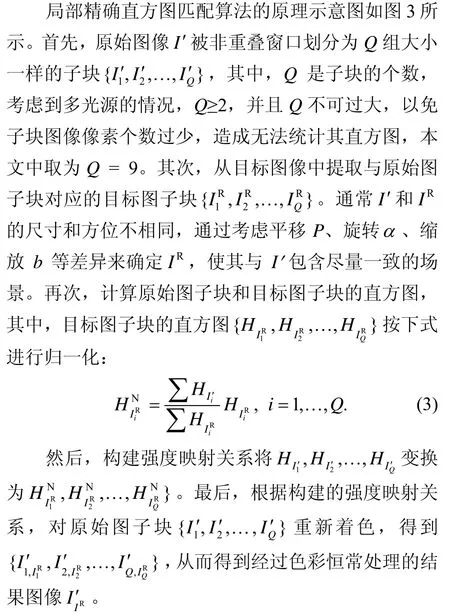

虽然EHM算法能够快速、精确地进行直方图匹配,使原始图像具有与目标图像几乎完全一样的直方图,但是在景象匹配色彩恒常处理过程中,由于基准图和实时图之间不但具有色彩差异,还不可避免地存在着平移、尺度、旋转等差异,直接采用该方法将会严重影响色彩恒常处理的效果并限制景象匹配系统的定位精度。为此,本文考虑平移、尺度、旋转等影响因素,利用导航系统参数进行补偿,并通过引入分块处理机制解决多光源的问题,提出了一种局部精确直方图匹配(LEHM)算法。

图 3 LEHM算法原理示意图Fig.3 Illustration of the LEHM algorithm

2.1 局部精确直方图匹配2.2 基于LEHM的无人机景象匹配导航色彩恒常算法

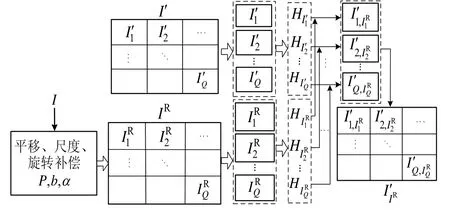

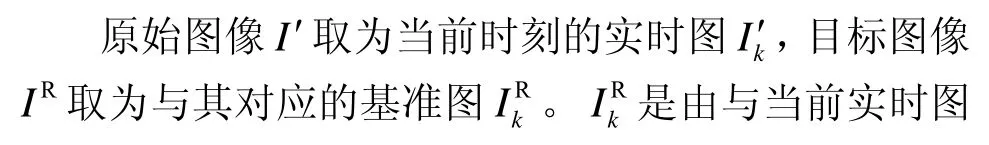

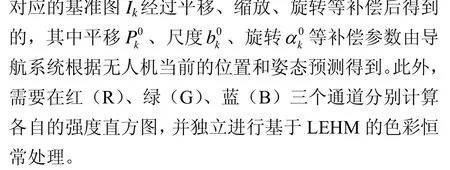

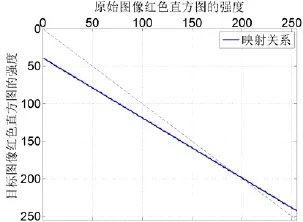

为解决景象匹配辅助导航中实时图和基准图之间存在的色彩差异性问题,提出了基于LEHM的色彩恒常算法的处理过程,如图4所示。

值得注意的是,无人机的位姿信息越精确,LEHM算法的性能越好。为此,经过景象匹配之后,可以选择根据得到的更准确的位置和姿态信息再次进行色彩恒常处理,以得到更满意的处理结果,确保景象匹配辅助导航系统获得更高的定位和导航精度。

图 4 基于LEHM的景象匹配导航色彩恒常算法框图Fig.4 Block diagram of the color constancy algorithm for scene matching navigation based on LEHM

3 实验与分析

3.1 局部精确直方图匹配实验

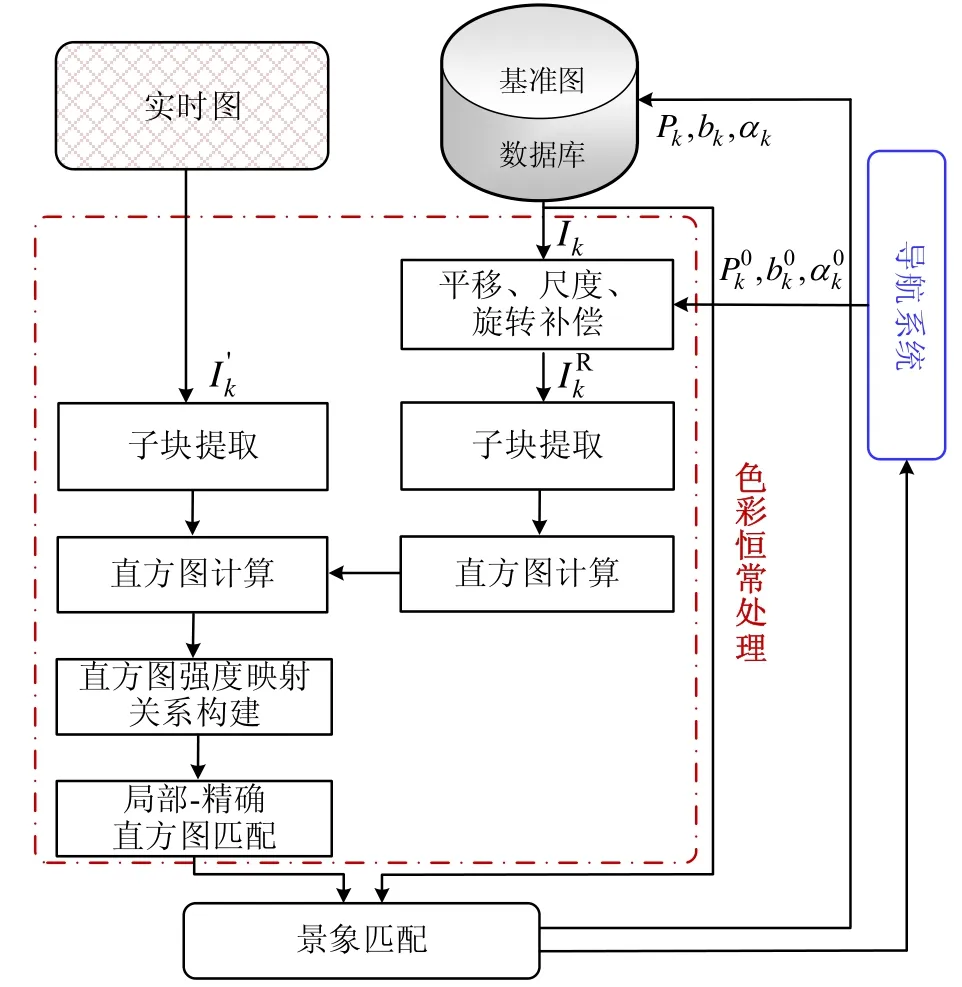

为了说明本文所提局部精确直方图匹配方法的色彩恒常处理过程,将该方法运用于几组具有代表性的景象匹配图像,如图5所示,其中涵盖道路、操场、河流、建筑物等地物特征。图5中,第1列是目标图像,第2列是原始图像,第3列是原始图像经过基于LEHM色彩恒常算法处理后的结果图像。对比图5的第1列和第3列可见,局部精确直方图匹配方法能够消除原始图像和目标图像之间的颜色差异,处理效果比较好,使其几乎逼近目标图像的颜色。

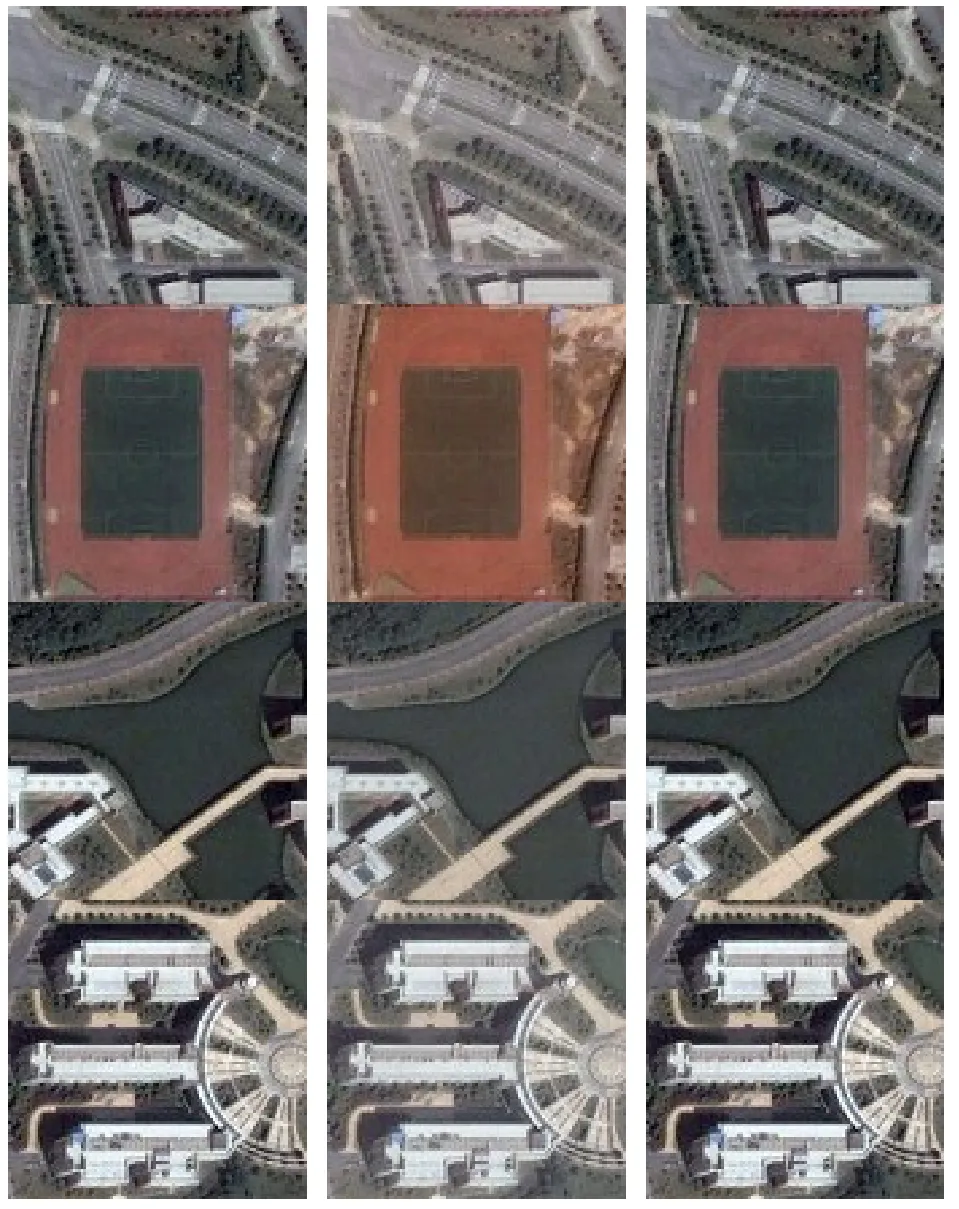

针对图5中第4行所示的目标图像和原始图像,根据式(2)计算得到在红色通道直方图的颜色强度映射关系如图6所示。图6中的黑色虚线为参照线,当原始图像直方图与目标图像直方图相同时,强度映射关系应当与此线完全重合。

图 5 色彩恒常处理结果Fig.5 Results of the color constancy processing

图 6 红色通道直方图的颜色强度映射关系Fig.6 Intensity mapping relationships of the histogram in red channel

图 7 红色通道的图像直方图Fig.7 Histogram of image in red channel

图5中第4行所示目标图像、原始图像,以及经色彩恒常处理后的结果图像在红色通道的直方图如图7所示。由图7可见,色彩恒常处理改变了原始图像的直方图,使其处理后的结果图像具有和目标图像相同的直方图。因此,基于LEHM的色彩恒常算法能够通过改变图像的直方图达到校正图像颜色的目的。

3.2 色彩恒常算法对比实验

本文所提基于 LEHM 的色彩恒常算法不需要训练数据,仅利用当前输入的图像数据即可完成色彩恒常处理。为了验证其性能,与近年来的经典统计类算法进行对比实验,这几种经典算法包括Grey-World算法[7]、White-Patch算法[8]、Grey-Edge算法[9]。

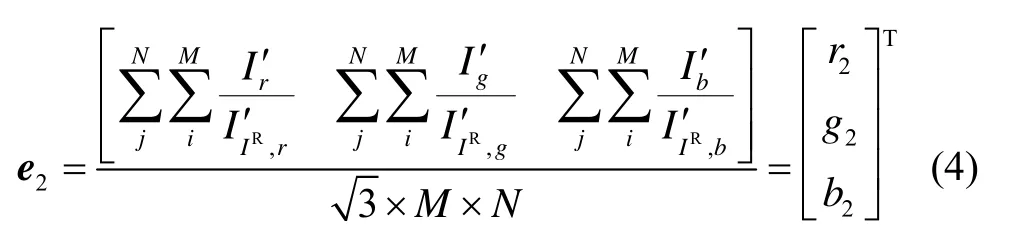

本实验中的原始图像(I′)均来自SFU Greyball数据集[15]中,并将原始图像按照数据集所提供的光源颜色真值校正后的图像作为目标图像(I),该数据集中一共包含 15个不同的场景下来自不同光源的11346张图片。色彩恒常处理后的结果图像记为,光源颜色的估计值计算公式如下:

对光源颜色进行估计的欧拉角误差用来衡量色彩恒常算法的性能,计算公式如下:

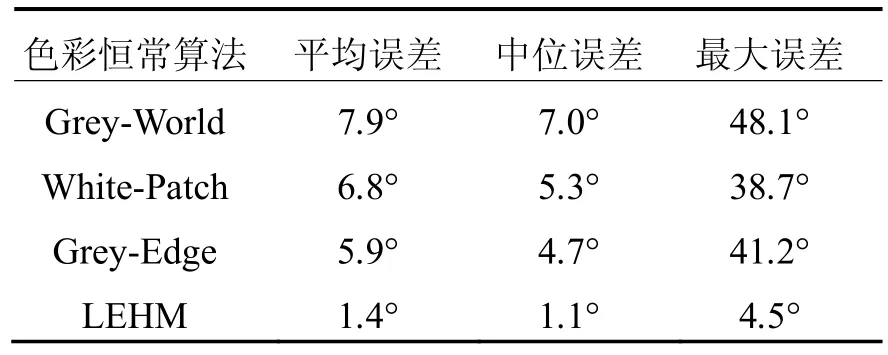

色彩恒常算法对比实验的部分结果如图8所示,每一行为一组实验,从左到右分别是目标图像、原始图像、Grey-World算法处理结果、White-Patch算法处理结果、Grey-Edge算法处理结果、本文算法的处理结果。由图8可以看出,本文所提色彩恒常算法的处理结果最接近目标图像,性能优于其它3种色彩恒常处理算法。

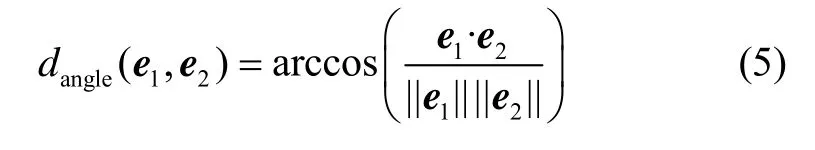

表1所示是按照式(4)和(5)计算得到的3种传统算法和本文所提基于 LEHM 的色彩恒常算法应用于SFU Grey-ball数据集[15]的平均欧拉角误差、中位欧拉角误差和最大欧拉角误差。由图8和表1可见,本文所提算法对光源颜色的估计非常接近真值,欧拉角平均误差降低到传统色彩恒常算法的20%左右,因而使处理后的图像与目标图像具有非常好的色彩一致性。

值得注意的是,本文所提算法与传统算法不同,并不是对单一图像进行色彩恒常处理,而是有效利用了原始图像与目标图像之间的对应关系,当两幅图像的场景接近或颜色分量的比例相似时,可以达到非常好的色彩一致性。所提算法能够对两幅图像之间对应关系进行有效利用,非常适合应用于景象匹配辅助导航系统中,利用导航系统提供的位姿信息获得两幅图像之间的平移、尺度、旋转等参数,解决实时图和基准图之间的色彩差异性问题。

表 1 欧拉角误差Tab. 1 Euro angle errors

3.3 景象匹配导航的色彩恒常性实验

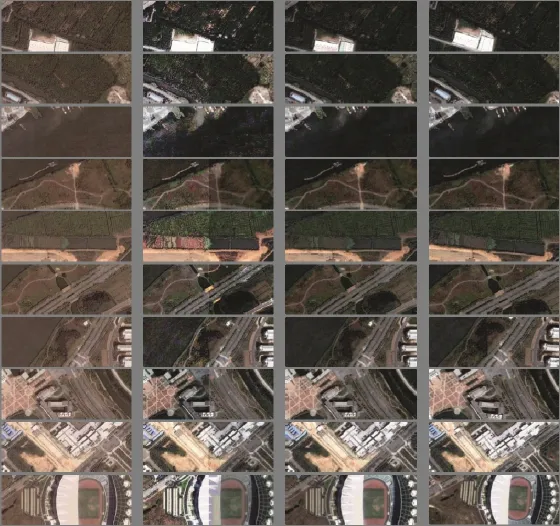

为了消除实时图与基准图的色彩差异对景象匹配系统定位精度的影响,需要对实时图进行色彩恒常处理。一些用于景象匹配导航的实时图和基准图的色彩恒常处理结果如图9所示。图9中,第1列是实时图,第2列是根据预测的无人机位姿信息对实时图进行色彩恒常处理的结果,第3列是根据景象匹配后的无人机位姿信息对实时图进行色彩恒常处理的结果,第4列是基准图。

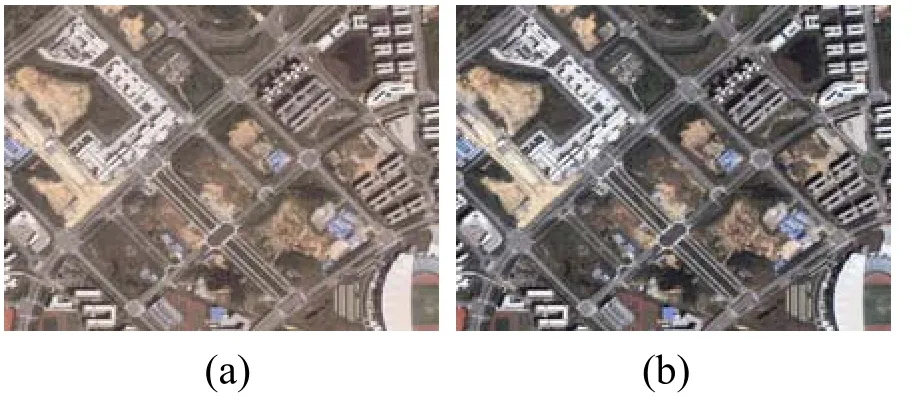

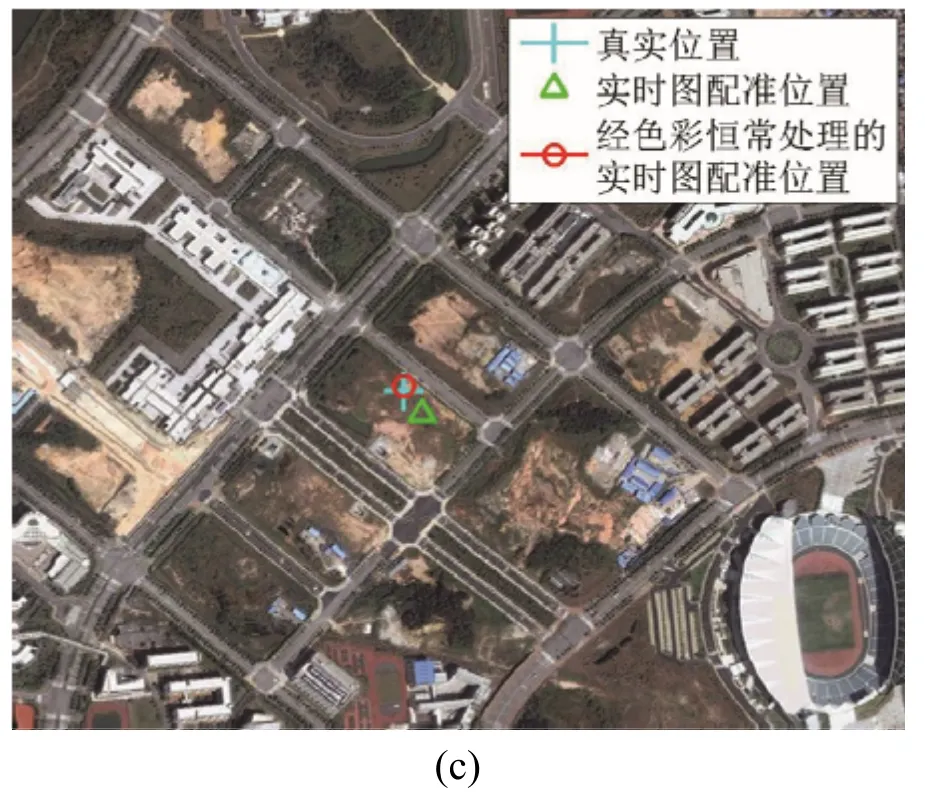

由图9可以看出,相比于第1列的实时图,对其经过色彩恒常处理后的第2列和第3列图像的颜色更为接近第4列所示的基准图的颜色,并且由于景象匹配之后提供了更为精确的无人机位姿信息,第3列的处理结果没有出现第 2列中的部分像素颜色失真的情况,其性能优于第 2列的处理结果。因此,基于LEHM 算法的色彩恒常处理能够消除无人机景象匹配辅助导航系统中实时图和基准图之间的颜色差异问题,并且迭代更为精确的无人机位姿信息能够进一步提高色彩恒常处理的效果,从而确保景象匹配辅助导航系统进行精确的无人机定位和导航。图10为一组景象匹配实验,图10(a)为实时图,图10(b)为经过色彩恒常处理的实时图,图 10(c)为实时图在基准图中的匹配位置。由图10可见,经过色彩恒常处理以后的实时图具有与基准图更为一致的颜色分布,并且具有更高的匹配精度。

通过对 480组景象匹配实验数据进行景象匹配,统计基于LEHM的色彩恒常处理和不采用色彩恒常处理下实时图在基准图中的匹配位置,误差曲线如图 11所示。所用实验数据中,实时图和基准图之间存在颜色、平移、尺度、角度等差异。由图11可见,经过色彩恒常处理以后的实时图具有更高的匹配精度和鲁棒性。

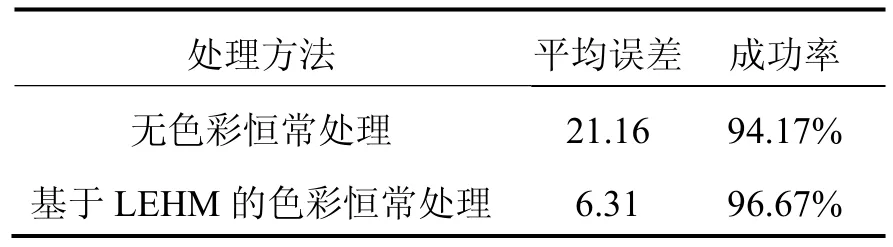

计算景象匹配平均误差和匹配成功率作为评价基于 LEHM的进行匹配色彩恒常算法的定量评价指标,如表2所示。实验中当景象匹配误差低于25个像素(相当于地面上的距离为10 m)时,认为景象匹配成功。表2表明,采用所提色彩恒常算法后,相比于不采用色彩恒常的景象匹配算法,景象匹配平均误差降低了约70%,能够使景象匹配系统具有比不采用色彩恒常处理得到更优的性能。在基准图和实时图之间存在颜色、平移、尺度、角度等差异时,所提基于LEHM的无人机景象匹配导航色彩恒常算法具有更为精确和鲁棒的定位性能。

图 8 色彩恒常算法对比实验结果Fig.8 Comparative experiment results of color constancy algorithms

图 9 色彩恒常处理结果Fig.9 Results of the color constancy processing

表 2 景象匹配误差Tab. 2 Scene matching errors

图 10 景象匹配实验Fig.10 Scene matching experiment

图 11 景象匹配误差曲线Fig.11 Curves of scene matching errors

4 结 论

针对景象匹配辅助导航中实时图和基准图之间存在的色彩差异性问题,本文从提高色彩恒常性处理的精确性和可靠性的角度入手,提出了一种基于局部精确直方图匹配的色彩恒常算法。通过考虑平移、尺度、旋转等补偿,引入分块处理机制,所提算法可以提高颜色校正的精确性。通过对SFU Grey-ball数据集中的图像和景象匹配具体应用中的实时图进行色彩校正实验,并与经典色彩恒常算法进行对比分析,从视觉主观判断、光源颜色估计的欧拉角误差、景象匹配平均误差、景象匹配成功率四个方面,验证了所提算法能够有效降低图像之间的色彩差异,使景象匹配系统获得色彩恒常性,提高景象匹配辅助导航的定位精度和鲁棒性。

References)

[1] 曲圣杰, 潘泉, 赵春晖, 程咏梅. 景象匹配辅助导航系统匹配置信度评估方法[J]. 中国惯性技术学报, 2012, 19(6): 713-719. Qu Sheng-jie, Pan Quan, Zhao Chun-hui, Cheng Yongmei[J]. Confidence evaluation method for scene matching aided navigation system[J]. Journal of Chinese Inertial Technology, 2012, 19(6): 713-719.

[2] 郑辛, 孙伟, 李群, 郭元江. 基于证据推理的惯性/景象匹配组合导航方法[J]. 中国惯性技术学报, 2014, 22(5): 624-628. Zheng Xin, Sun Wei, Li Qun, Guo Yuan-jiang. INS/ Scene matching integrated navigation based on evidence reasoning[J]. Journal of Chinese Inertial Technology, 2014, 22(5): 624-628.

[3] 李耀军, 潘泉, 赵春晖, 于盈, 李军伟. 基于 INS/ SMNS紧耦合的无人机导航[J]. 中国惯性技术学报, 2010, 18(3): 302-306. Li Yao-jun, Pan Quan, Zhao Chun-hui, Yu Ying, Li Junwei. INS/SMNS tightly-coupled navigation for unmanned aerial vehicle[J]. Journal of Chinese Inertial Technology, 2010, 18(3): 302-306.

[4] Yu Qi-feng, Shang Yang, Liu Xiao-chun, et al. Fullparameter vision navigation based on scene matching for aircrafts[J]. Science China Information Sciences, 2014, 57(5): 1-10.

[5] Ng Hui-fuang, Chen I-chi, Liao Hung-yu. An illumination invariant image descriptor for color image matching [J]. Scientometrics, 2013, 25(1): 306-311.

[6] Gijsenij A, Gevers T, Joost Van De Weijer. Computational color constancy: Survey and experiments[J]. IEEE Transactions on Image Processing, 2011, 20(9): 2475-2489.

[7] Pan Bin, Jiang Zhi-guo, Zhang Hao-peng, et al. Improved grey world color correction method based on weighted gain coefficients[C]//SPIE/COS Photonics Asia. Beijing, 2014: 927331-1- 927331-7.

[8] Banić N, Lončarić S. Improving the White patch method by subsampling[C]//2014 21st IEEE International Conference on Image Processing. Paris, France, 2014: 605-609.

[9] Gijsenij A, Gevers T, Joost Van De Weijer. Improving color constancy by photometric edge weighting[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(5): 918-929.

[10] Urban P, Berns R S. Paramer mismatchbased spectral gamut mapping[J]. IEEE Transactions on Image Processing, 2011, 20(6): 1599-1610.

[11] Faghih M M, Moghaddam M E. Neural gray: A color constancy technique using neural network[J]. Color Research & Application, 2014, 39(6): 571-581.

[12] Sun Hua-dong, Jin Xue-song, Fan Zhi-peng, et al. Color correction for multi-view video based on SVR[C]// Advanced Science and Technology Letters, 2014, 53: 392-397.

[13] Morovic J, Shaw J, Sun Pei-li. A fast, noniterative and exact histogram matching algorithm[J]. Pattern Recognition Letters, 2002, 23(1): 127-135.

[14] 陈建乐, 刘济林, 叶建洪, 陈妤姗. 多视点视频中基于局部直方图匹配的亮度和色差校正[J]. 中国图象图形学报, 2007, 12(11): 1992-1999. Chen Jian-le, Ji-lin Liu, Ye Jian-hong, Chen Yu-shan. Luminance and chrominance correction for multiview video using overlapped local histogram matching[J]. Journal of Image and Graphics, 2007, 12(11): 1992-1999.

[15] Ciurea F, Funt B. A large image database for color constancy research[C]//IS&T/SID Eleventh Color Imaging Conference. Scottsdale, 2003: 160-164.

Color constancy algorithm based on local exact histogram matching for scene matching navigation of UAVs

JIN Zhen-lu, PAN Quan, ZHAO Chun-hui, WEI Yan-yan, MA Juan-juan

(Key Laboratory of Information Fusion Technology Ministry of Education, School of Automation, Northwestern Polytechnical University, Xi’an 710072, China)

To address the color variability issues existing between the sensed images and the reference images in scene matching navigation of unmanned aerial vehicles (UAVs), a color constancy algorithm is proposed based on local exact histogram matching (LEHM). The sensed image is divided into a set of sub-images, and the erroneous correspondence between the sensed image and the reference image is obtained according to the location and attitude of UAV predicted by the scene matching aided navigation system. The shifting, scaling and rotation compensation are taken into account to select the sub-images from the reference image corresponding to the sub-images from the sensed image. Three intensity mapping relationships are established from the histograms of each pair of sub-images in red, green, and blue channels. At last, the three color channels of the sub-images from the sensed image are adjusted in accordance with the established intensity mapping relationships. This will reduce the color differences between the sensed image and the reference image. Experimental results show that the euro angle error of the estimated illuminant color using the proposed algorithm is reduced by 80% compared with those by traditional color constancy methods. Moreover, the mean scene matching error is reduced by almost 70% in comparison to the scene matching algorithm without color constancy processing. By introducing the blocking scheme, the proposed algorithm could overcome the color variability issues caused by multi-illuminant imaging and possess the potential of parallel computation, which is suitable for engineering applications.

color constancy; local exact histogram matching; distortion compensation; scene matching navigation; unmanned aerial vehicle

U666.1

:A

2015-06-21;

:2015-09-20

国家自然基金项目(61135001);国家自然基金项目(61473230,61403307);航空基金项目(2014ZC53030)

靳珍璐(1988—),女,博士研究生,从事景象匹配视觉导航研究。E-mail:jinzhenlu@mail.nwpu.edu.cn

联 系 人:赵春晖(1973—),男,硕士生导师,从事视觉导航、组合导航等研究。E-mail:zhaochunhuinpu@126.com

1005-6734(2015)05-0674-07

10.13695/j.cnki.12-1222/o3.2015.05.020