基于小波变换和小波神经网络的3D遮挡人脸识别方法*

2015-05-29孔令美

孔令美, 汤 庸

(1.广东技术师范学院 天河学院 信息与传媒学院,广东 广州510540;2.华南师范大学 计算机学院,广东 广州510631)

人脸识别作为一种最为直观的生物特征识别方法,一直是生物特征识别领域的研究热点,目前,在门禁考勤、出入控制、视频监控等领域已有广泛应用 .然而,现有人脸识别方法受环境光照、人脸表情与姿态、遮挡的影响较大,当这些因素在人脸的注册阶段和验证阶段发生较大变化时,人脸识别性能会急剧下降,导致无法应用.[1]基于人脸的3D信息进行人脸识别是解决姿态、光照、遮挡变化问题的有效途径,目前已涌现出许多有效的3D人脸识别方法,大幅提高了人脸识别方法对姿态和光照变化的鲁棒性[2~5].然而,3D人脸识别目前对人脸遮挡的鲁棒性较弱,是3D人脸识别亟待解决的难点问题,[6,7].研究了3D人脸的遮挡检测与复原方法,通过比较待检测深度图像与通用人脸深度图像之间的距离差异来检测遮挡区域,并基于通用人脸深度图像复原遮挡区域.[8]提出了一种GPCA(Gappy Principal Component Analysis)方法,利用人脸遮挡区域与非遮挡区域的PCA特征差异来检测遮挡区域,采用PCA方法提取特征并进行识别,但识别性能依赖于遮挡物体的先验知识.[9]提出了一种基于ARM(Average Regional Models)的3D遮挡人脸识别方法,通过ICP(Iterative Closest Point)算法求取人脸局部区域特征,对3D人脸的遮挡和表情变化都有一定效果,但识别性能也依赖于遮挡物体的先验知识.[10]提出了一种基于三维建模的眼镜遮挡下的人脸识别方法,将眼镜作为人脸的固有部分,通过三维重建方法生成虚拟人脸样本,使虚拟样本更加合理地反映眼镜的反光、模糊等变化,补偿眼镜的不稳定性,提高眼镜遮挡图像的识别率 .但该方法对其他遮挡物体的识别性能还有待加强.

本文提出一种基于小波变换和小波神经网络的3D遮挡人脸识别方法,主要创新点包括两方面:一是基于小波变换的系数检测3D人脸的遮挡区域,相对于PCA等特征,不同层次的小波变换系数对区域遮挡更加敏感,从而可以提高遮挡区域的检测率;二是基于小波神经网络分类器识别3D人脸,通过构建小波神经网络自分类器,适应处理不同遮挡情况下的3D人脸比对问题,还可以利用小波神经网络的输出结果复原3D人脸的遮挡区域 .通过在国际上通用的UMB-DB和BOSPHORUS-DB两个常用的3D遮挡人脸图像库上进行实验对比与分析,证明本文方法对有意遮挡和无意遮挡的鲁棒性强、识别性能好.

1 基于小波变换的遮挡人脸检测

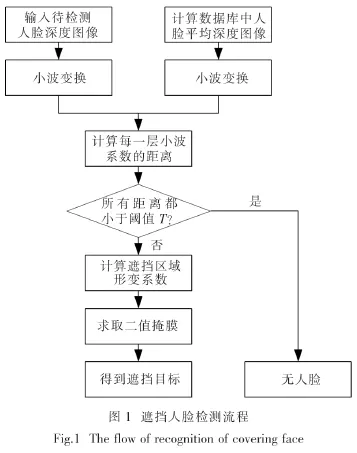

本文采用小波变换方法检测人脸的遮挡区域,检测流程如图1所示.

小波变换(Wavelet Transform,WT)是短时傅立叶变换局部化的思想的继承和发展,它克服了变换窗口尺寸不随频率变化的问题,构造了一种便于信号时频分析的“时间-频率”窗口,可通过伸缩平移运算对信号逐步进行多尺度细化,实现高频处时间细分、低频处频率细分的要求[11].常用的小波变换公式为

其中,a表示时间,b表示尺度,ψ表示小波母函数,满足以下三个条件:

对于待检测深度图像和数据库中的人脸平均深度图像,分别进行小波变换,计算其小波变换系数之间的距离D,表示为Dl=|Il-IMl|,其中,Il表示待检测深度图像第l层的小波变换系数,IMl表示数据库中人脸平均深度图像第l层的小波变换系数,Dl表示第l层的小波变换系数之间的距离.

给定阈值T,如果对于所有l都有Dl<T,则表明待检测深度图像不是人脸.否则,进入下一步,检测人脸是否存在遮挡.

假设I:D⊂R×R→R2;(x,y)aI(x,y)是分布在域D内的一个深度灰度图,遮挡区域与非遮挡区域的联系可以表示为I(x,y)=I(w(x,y))+n(x,y).

遮挡可以看作是人脸图像的局部形变,为了表示这种形变,定义映射w:D×R→R;(x,y)a w(x,y)≡x+dx,y+dy,将I(x,y)映射到I(x+dx,y+dy)的域 .其中,(dx,dy)为随机偏移量,表示为dx =Random(-3,3), dy =Random(-3,3),其中,Random(x,y)是一个随机数,取值为[x,y]内的一个整数.

n(x,y)用于调和不同环境变化的影响,如光照、仿射和尺度变化等 .假设人脸尺寸已归一化,且光照变化和仿射变换对遮挡的影响可以忽略,那么n(x,y)→0.此时可以依据数据库中获取的平均深度图像的小波变换系数IM(x,y)来计算待检测人脸图像的形变系数,表示为

为了更好地定位遮挡区域,本文对小波变换的每一层l构建了一个二值掩膜Ml,表示为

待检测人脸图像和二值掩膜进行“与”运算,可以得到遮挡目标Ol,表示为

其中,El表示第l层的区域遮挡误差,实际应用过程中可以忽略不计 .∧表示“与”运算.

如果遮挡不存在,则二值掩膜Ml为空,表示为

将公式(4)代入公式(3),并忽略El,得

2 基于小波神经网络分类器的遮挡人脸识别

图2所示为小波神经网络分类器的体系结构,该体系结构主要包括三层:线性输入层、隐藏层和线性输出层[12].线性输入层由Ni个神经元组成,用于接收遮挡目标Ol和数据库中每一个深度图像之间的差异;隐藏层由Nw个小波构成;线性输出层用于接收多维小波的输出.

小波神经元的输入记为Γl(x,y),表示为

其中,Il表示数据库中的第l个深度图像 .小波神经网络分类器的输出形式为:

由公式(5)和(6)可得,

现在所有的问题可以转换为最小化代价函数NDWk.在训练阶段,通过采用图2所示的体系结构调整小波神经网络的参数,使得NDWk达到最小 .在识别阶段,选择使NDWk达到最小的深度图像作为识别的结果 .另外,遮挡区域可以采用数学形态学方法进行重建,重建后的图像为

其中,∨表示“或”运算.

3 实验结果分析与对比

3.1 实验数据与评价指标

本文使用国际上主流的两个三维人脸数据库:一是UMB-DB,该数据库包含132幅无遮挡的人脸深度图像和76幅存在遮挡的人脸深度图像;二是BOSPHORUS-DB,该数据库包含105个个体的三维人脸图像,每个个体有54幅不同表情、姿态和遮挡(如眼镜、手、头发)的图像,共有4 652幅图像 .其中,每一个体至少有三幅人脸图像是存在遮挡的.

性能评测采用检测率,识别率和平均识别时间三个评价指标。检测率和识别率越高平均识别时间越小则性能越好.

3.2 参数分析

本文方法涉及两个参数:固定阈值T和小波变换层数l.

(1)固定阈值:本文方法在遮挡人脸检测部分采用了一个固定阈值T.一般地,该阈值取值越小,检测出现无人脸的结果越少,但同时遮挡人脸被检出的几率也越小 .本文分析了T=0.02、0.04、0.06、0.08和0.10五种情况下的人脸检测率指标,其中,小波变换层数l=2.可见,当T=0.06时,两个数据库的人脸检测率指标都达到最大 .故本文取T=0.06.

(2)小波变换层数:小波变换的层数l对本文方法的检测率有较大影响,分析l取1、2、3和4四种情况下的人脸检测率指标,其中,T=0.06.当l=2时,两个数据库的人脸检测率指标都达到最大 .故本文取l=2.

3.3 实验结果对比

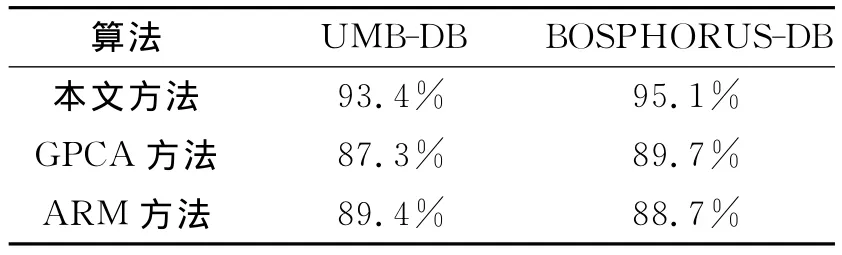

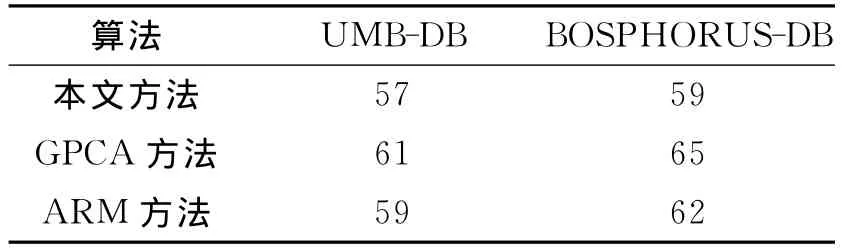

为了验证本文算法的性能,在UMB-DB和BOSPHORUS-DB两个数据下,分别使用本文方法与经典的GPCA和ARM方法测试遮挡的人脸的检测率、识别率和平均识别时间,对比结果详细讨论如下.

检测率对比如表1所示.可以明显看出两个数据库下本文方法的检测率指标都是最高的.

表1 不同方法不同数据库下的GDR指标对比Tab.1 Comparison of GDR index in different methods

表2 不同方法、不同数据库下的GAR指标对比Tab.2 Comparison of GAR index in different methods and different databases

表3 不同方法不同数据库下的ART指标对比Tab.3 Comparison of ART index in different methods

识别率对比结果如表2所示 .表3对比了上述测试过程中不同方法的评价识别时间 .其中,时间的单位为ms.测试环境为AMD A6 3.6GCPU、8G内存、Windows 7操作系统 .三种方法的运算效率相当.

综合上述三项测试结果的对比分析,本文方法在运算效率相当的情况下,检测率和识别率指标都高于经典的GPCA和ARM方法,说明本文方法可以更好地处理遮挡人脸的检测和识别.

4 结束语

本文提出一种基于小波变换和小波神经网络的3D遮挡人脸识别方法.首先,对待检测人脸的深度图像进行小波变换,依据各层小波变换系数与数据库中平均人脸深度图像的小波变换系数进行比较,获取人脸的遮挡区域;然后,对非遮挡区域提取小波变换系数,构建小波神经网络分类器,依据小波网络的人脸空间距离进行3D遮挡人脸识别.仿真实验表明,本文方法对3D人脸的有意遮挡和无意遮挡的鲁棒性强,与目前经典的3D人脸识别方法相比具有更好的识别性能.

[1]MT A P.Eigenfaces for recognition[J].J Cogn Neurosci,1991,3(1):71-86.

[2]蔡亮,达飞鹏.基于几何图像滤波的3D人脸识别算法[J].东南大学学报:自然科学版,2012,42(5):859-863.

[3]蔡亮,达飞鹏.结合形状滤波和几何图像的3D人脸识别算法[J].中国图象图形学报,2011,16(7):1 303-1 309.

[4]柴秀娟,山世光,卿来云,等.基于3D人脸重建的光照、姿态不变人脸识别[J].软件学报,2006,17(3):525-534.

[5]FENG S,KRIM H,KOGAN I A.3Dface recognition using euclidean integral invariants signature[C]//IEEE/SP Workshop on Statistical Signal Processing,2007:156-160.

[6]SCHETTINI R,CUSANO C,COLOMBO A.Face^3a2D+3Drobust face recognition system[C]//International Conference on Image Analysis &Processing.IEEE Computer Society,2007:393-398.

[7]COLOMBO A,CUSANO C,SCHETTINI R.Detection and restoration of occlusions for 3Dface recognition[C]//IEEE International Conference on Multimedia & Expo IEEE Computer Society,2006:1 541-1 544.

[8]ALESSANDRO C,CLAUDIO C,SCHETTINI R.Gappy PCA classification for occlusion tolerant 3Dface detection[J].Journal of Mathematical Imaging & Vision,2009,35(3):193-207.

[9]ALYUZ N,GOKBERK B,AKARUN L.A 3Dface recognition system for expression and occlusion invariance[C]//IEEE International Conference on Biometrics:Theory,Applications and Systems,2008:1-7.

[10]熊鹏飞,刘昌平,黄磊.基于三维建模的眼镜遮挡下人脸识别[J].模式识别与人工智能,2011,24(5):692-699.

[11]SHENSA M.The discrete wavelet transform:wedding the a trous and Mallat algorithms[J].Signal Processing,IEEE Transactions,1992,40(10):2 464-2 482.

[12]NIAN C,KUANG H H,SHU Y L,et al.Wavelet neural network and its application[J].Chinese Journal of Stereology &Image Analysis,2001,6(4):239-245.

[13]NEMATI R J,JAVED M Y.Fingerprint verification using filter-bank of Gabor and Log Gabor filters[C]//International Conference on Systems,Signals and Image Processing.IEEE,2008:363-366.

[14]喻祖国,Vo Anh,刘家成.迭代函数系统模型在生物序列分析中的应用[J].湘潭大学自然科学学报,2003(3):131-139.