基于运动和散焦线索的深度提取研究

2015-04-29牛连丁孙华东陈铭

牛连丁 孙华东 陈铭

摘 要:随着立体图像在社会各个领域的发展与普及,三维资源的需求逐步提升,而将二维图像转换为三维图像是解决三维资源稀缺的重要手段。二维图象三维化技术的关键在于深度信息的获取。分析了两种重要的深度提取线索,运动线索和散焦模糊线索。为了弥补这两个线索在深度提取的局限性,提出了两种线索的深度融合策略。实验结果表明,这两种线索采用分段线性融合的方法能提高生成深度图的质量。

关键词:深度提取;运动线索;散焦线索;深度融合策略

中图分类号:TP391 文献标识号:A 文章编号:2095-2163(2015)02-

Depth Extraction based on Motion and Defocusing Cue

NIU Lianding1, SUN Huadong2, CHEN Ming 2

(1 Network?and?Educational?Technology?Center, Harbin University of Commerce, Harbin 150028, China;2 Department of Computer and Information Engineering, Harbin University of Commerce, Harbin 150028, China)

Abstract: With the development and popularity of stereo image in field of society, the demand of stereo resource gradually upgrades. 2D to 3D image conversion is an important methods to solve the problem of stereo resource scarcity. As a new interactive way, 3D visualization technology eliminates the disadvantages of plane communication interface. Depth extraction is the key for three dimensional visualization technique. The two important cues, motion cue and defocusing cue are analyzed. In order to compensate for the limitations of the two cues, the fusion strategy of the two cues is presented here. Experimental results show that piecewise linear combination of the two cues can improve the quality of depth map.

Keywords: Depth Extraction; Motion Cue; Defocusing Cue; Depth Fusion Strategy

0 引 言

由于三維影像具有更逼真的效果、更具临场感,使其备受推崇。随着显示设备迅速普及,市场对相应的显示内容也有着大量的需求。然而,传统的三维影像的制作却存在制作成本高、技术难度大、周期长等问题,并不能满足市场需求。通过获取二维影像的深度信息,并利用该信息将现有二维影像三维化处理获得三维影像,成为解决三维显示内容不足的一个重要手段。该方案不但可以降低制作成本,缩短制作周期,还能够充分利用现有的影像资源避免资源浪费。二维影像三维化技术的关键在于深度提取[1]。目前,已有多种线索用于二维视频的深度提取,总体上可分为帧间线索和帧内线索。

运动线索是重要的帧间线索之一。其原理是利用相邻帧的运动矢量获得深度图,离镜头较远的物体运动矢量小,较近的物体运动矢量大。利用相邻帧获得运动矢量的方法主要有块匹配法和光流法。徐枫等提出了一种基于光流法的三维转换方案[2],该方法使用改进的光流法提取每一帧像素级的运动,较基于块匹配的方法得到了更多细节结果,但光流法计算复杂度很高,不适合于实时情况下计算高分辨率的视频。

聚散焦线索是重要的帧内线索之一,其实现依据了越是远离聚焦平面的物体成像越模糊的原理获得场景中物体的深度。2003年,S.A.Valenecia等用聚散焦线索提取图像的深度信息,相继提出了基于多分辨率小波分析的局部频域测量和显著边缘的Lipschitz估计的深度估计方法[3];2007年,Malik A.S等利用具有带通特性的光学传递函数来估计模糊程度,所提出的聚焦测量方法相比其他方法在噪声处理方面有很大的改善[4]。

当然,单独利用这两种线索提取深度有各自的缺陷。单独采用运动线索提取图像深度信息,对图像中存在的静止物体深度估计效果较差,对图像中存在的很明显的光照变化情况,其深度估计效果也不是很理想。同时深度不是产生模糊的唯一因素,模糊不仅可以由散焦产生,也可以由其他因素产生,例如相机的运动,大气干扰,模糊的物体;因此,利用模糊线索提取深度要求图像中要有丰富的纹理。由上可知,单独采用某种线索提取图像的深度信息的局限性很大,场景限制较多,为此考虑将运动线索和聚散焦线索结合起来,提高视频的深度提取效果。

1运动线索提取深度

运动线索是利用帧间信息提取深度信息的重要线索。对输入二维视频序列做运动估计,获得运动矢量;进而利用该运动矢量生成初始深度图;最后滤波去噪获得最终的深度图。

块匹配运动估计算法是目前应用最为普遍的运动估计算法,具有原理简单、计算复杂度低等优点。如图1所示,首先按照预先定义的尺寸将预测帧分成若干宏块,宏块是块匹配中的基本操作单元;然后选定坐标为的宏块,在参考帧中的搜索范围内按照匹配准则寻找其最优匹配宏块,假设坐标为。该宏块的运动矢量即为。

图1 块匹配运动估计示意图

Fig.1 Schematic diagram of block matching motion estimation

运动估计中的匹配准则有很多种,本文采用平均绝对值差(MAE),在公式(1)中给出[5]. 其中M、N为预先设定的宏块尺寸;x、y为预测宏块左上角像素的横纵坐标;为参考帧中坐标为的像素值;为预测帧中坐标为的像素值。在搜索范围内,可以使MSE最小的就是预测宏块对应的运动矢量。

(1)

另外,宏块的尺寸也将影响到深度图的质量以及计算复杂度。如采用的尺寸较大,可以有较快的计算速度,但会在景物边缘产生较大的锯齿效应;反之,选择较小尺寸则在降低锯齿效应的同时提高了计算复杂度,不利于实时处理。为了提高深度图质量和降低计算复杂度,采用变宏块匹配技术进行运动估计。宏块尺寸由最小拉格朗日代价函数决定[6],如公式(2)所示。其中Scur表示当前宏块,Sref表示参考宏块。

(2)

变宏块技术可以生成包括16×16,16×8,8×16,8×8,8×4,4×8,4×4七种不同尺寸,使得前景对象的深度图内部行对平缓,边缘相对精细,可以获得边缘较为清晰的深度图。

获得运动矢量后,利用公式(3)生成初始深度图[7],式中,是运动矢量的模。是深度调整系数。通过调节来调节整个深度帧的深度大小。为了获得视差效果更好的三维视频,取,其中为提取运动矢量场中运动矢量的最大值。深度图是范围为8bit的灰度图,而255为深度图的最大值。

(3)

以上过程中每一个宏块内部的所有像素的深度值是共用同一个运动矢量生成的,这必然会导致生成的深度图边缘部分会出现宏块锯齿效应;前景中物体面积较大的平坦区域会因为运动估计错误,使得深度图中产生孔洞现象。为了获得质量更好的深度图,采用形态学滤波方法,通过膨胀腐蚀操作平滑锯齿边缘、填补孔洞,将以上得到的原始深度图进一步处理,以提高深度图质量。

2 聚散焦线索提取深度

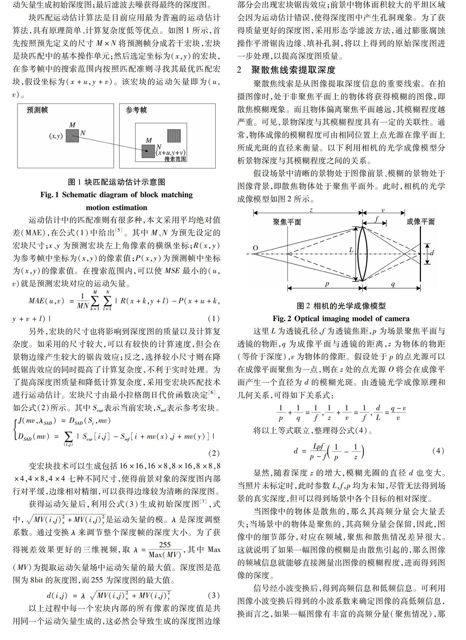

聚散焦线索是从图像提取深度信息的重要线索。在拍摄图像时,处于非聚焦平面上的物体将获得模糊的图像,即散焦模糊现象。而且物体偏离聚焦平面越远,其模糊程度越严重。可见,景物深度与其模糊程度具有一定的关联性。通常,物体成像的模糊程度可由相同位置上点光源在像平面上所成光斑的直径来衡量。以下利用相机的光学成像模型分析景物深度与其模糊程度之间的关系。

假设场景中清晰的景物处于图像前景、模糊的景物处于图像背景,即散焦物体处于聚焦平面外。此时,相机的光学成像模型如图2所示。

图2 相机的光学成像模型

Fig.2 Optical imaging model of camera

这里为透镜孔径,为透镜焦距,为场景聚焦平面与透镜的物距,为成像平面与透镜的距离,为物体的物距(等价于深度),为物体的像距。假设处于的点光源可以在成像平面聚焦为一点,则在处的点光源将会在成像平面产生一个直径为的模糊光斑。由透镜光学成像原理和几何关系,可得如下关系式:

将以上等式联立,整理得公式(4)。

(4)

显然,随着深度的增大,模糊光圈的直径也变大。当照片未标定时,此时参数,,均为未知,尽管无法得到场景的真实深度,但可以得到场景中各个目标的相对深度。

当图像中的物体是散焦的,那么其高频分量会大量丢失;当场景中的物体是聚焦的,其高频分量会保留,因此,图像中的细节部分,对应在频域,聚焦和散焦情况差异很大。这就说明了如果一幅图像的模糊是由散焦引起的,那么图像的频域信息就能够直接测量出图像的模糊程度,进而得到图像的深度。

信号经小波变换后,得到高频信息和低频信息。可利用图像小波变换后得到的小波系数来确定图像的高低频信息,换而言之,如果一幅图像有丰富的高频分量(聚焦情况),那么经变换后,会得到大量的非零小波系数;相反若图像中的高频分量较少(散焦情况),经过变换后则会得到很少的非零小波系数。

为了确定图像中各个部分的高频信息和低频信息,首先遍历图像中各个像素,以该像素为中心选取宏块,宏块大小为16*16。每一个宏块执行小波变换后会得到256个小波系数,若是宏块中高频信息较多(散焦情况),非零小波系数的个数应较多,若是宏块中高频信息较少(散焦情况),非零小波系数的个数应较少。通过计算每个宏块非零小波系数的个数,就可以对应得到该像素的深度层次。在实际情况中,由于噪声的存在,可以放宽小波系数门限阈值,即统计宏块中大于1的小波系数个数作为该像素的深度值。

3 运动线索和聚散焦线索结合

單独利用这两种线索提取深度有各自的缺陷。为了弥补各自的不足,需要将二者融合。记为运动线索获取的深度,为散焦模糊线索获取的深度,采用线性融合策略,则融合深度表达式为:

(5)

其中为线性融合策略中,运动线索所占比例,为模糊线索所占比例。一般情况,可取二者等比例融合,即。特别地,当时,相当于仅仅考虑运动线索;当时,相当于仅仅考虑模糊线索。

当然,这种线性融合策略的比例系数是全局的,实际中的情况更倾向于是图片的不同区域,两种线索对深度贡献的比例不同,因此,本文提出了如下的分段线性融合策略。

这里以运动线索深度作为评判依据,当图片中某些区域的值大于阈值时,此时认为图片中运动线索占据主导,所以采取的比例系数要大于0.5(实验中取0.7);当图片中某些区域的值小于阈值时,此时认为图片中运动线索是次要的,模糊线索占据主导,所以采取的比例系数要小于0.5(实验中取0.3);而介于和之间时,认为两种线索对深度的贡献相等,此时比例系数等于0.5。即

(6)

4 实验结果与分析

在Windows XP SP3系统环境下,利用Matlab7.0软件进行如图3所示的实验。

(a)原始视频帧

(a) Original video frames

(c)散焦线索的深度估计结果

(c) Estimation results of?defocusing cue

(b)运动线索的深度估计结果

(b) Estimation results of?motion cues

(d)分段线性融合的结果

(d) Piecewise linear fusion result

图3 实验结果

Fig.3 Experimental results

选取如图3(a)所示的某一序列的图片帧作为测试。图3(b)是利用当前图片帧和下一帧之间的运动矢量得到的深度图。从图中可以看出,具有较大运动矢量的人物,其深度估计良好,但静止的背景部分,深度估计较差。图3(c)是利用散焦模糊线索得到的深度图。从中可以看出,纹理多的部分深度估计良好,但纹理少的部分,估计效果变差。图3(d)是采用本文的分段线性融合策略的结果,这里,。从图中可以看出,对比单独利用两种线索,融合后的深度图要更为准确,无论是前景的人物,还是背景的走廊和房屋,都具有很好的深度层次。因此,这种融合策略能够很好地弥补这两种线索的不足,提高深度图的生成质量。

参考文献

[1] 袁红星,吴少群,朱仁祥,等.融合对象性和视觉显著度的单目图像2D转3D[J].中国图象图形学报.2013,(11):100-107.

[2] FENG X, GUIHUA E, XUDONG X. 2D-to-3D conversion based on motion and color mergence [C]//3DTV Conference: The True Vision - Capture, Transmission and Display of 3D Video 2008, Istanbul:3DTV-CON ,2008:205-208.

[3] VALENECIA S A, RODRIGUEZ-DAGNINO R M. Synthesizing stereo 3D views from focus cues in monoscopic 2D images [J]. Proceedings of SPIE-IS&T Electronic Imaging, 2003,5006: 377-388.

[4] MALIK A S, SHIM S-O, CHOI T-S. Depth map estimation using a robust focus measure [C]// //2007?IEEE?International Conference?on?Image?Processing, San Antoni: ICIP,?2007: 564-567.

[5] Jinshun Xu,Zhuxing Yang. Hierarchical SDD Metric and Multi-resolution Motion Estimation[Z].

Taiwan: Internet Technology Lab. National Sun Yat-Sen University, 1994:46-52.

[6] WIEN M. Variable block-size transforms for H.264/AVC[J]. IEEE Transactions on Circuits and

SystemsforVideoTechnology.2003.13(7):60-613.

[7] IDESES, YAROSLAVSKY L P, FISHBAIN B, et al. 3D from Compressed 2D Video[C] //Proc. SPIE, [S.l.]:SPIE, 2007,649:64901C-1.

基金項目:黑龙江省自然科学基金(F201114);哈尔滨市科技创新人才研究专项资金项目(2012RFQXG090)。

作者简介:牛连丁(1976-),男,山东平阴人,硕士,工程师,主要研究方向:图像处理与多媒体技术;

孙华东(1980-),男,黑龙江宁安人,博士,讲师,主要研究方向: 数字图像处理;

陈 铭(1985-),男,黑龙江哈尔滨人,硕士,助理工程师,主要研究方向: 图像处理与多媒体技术。