一种新的基于显著图的视线跟踪方法

2015-04-03黄生辉宋鸿陟吴广发司国东彭红星

黄生辉,宋鸿陟,吴广发,司国东,彭红星

一种新的基于显著图的视线跟踪方法

黄生辉,宋鸿陟,吴广发,司国东,彭红星

(华南农业大学信息学院,广东 广州 510642)

针对现有视线跟踪系统设备复杂、标定过程繁琐等方面的不足,提出了一种新的基于显著图的视线跟踪方法。通过红外光源设备在人眼角膜上产生的光斑中心与瞳孔中心建立瞳孔-角膜反射向量,然后将该向量作为视觉特征重构了基于显著图的视线跟踪算法。实验结果证明,提出的方法不仅缓解了视线跟踪系统标定过程繁琐的问题,而且对提高系统的精度和健壮性有一定的促进作用,这为面向人机交互的视线跟踪研究提供了可行的低成本解决方案。

视线跟踪;瞳孔-角膜反射向量;显著图;标定过程;

0 引言

人们获取的信息大部分来源于视觉,因此对视觉的研究具有重要的意义。通过视觉特征判断人眼注视点或视线方向的视线跟踪技术,不仅在解剖学、神经科学和心理学等领域有重要的意义,而且在人机交互、车辆辅助驾驶、市场营销以及虚拟现实等领域也有广泛的应用前景[1]。通常,基于视频的视线跟踪算法可以分为两类:一是基于2D的视线跟踪方法[2];二是基于3D的视线跟踪的方法[3]。相对于2D的视线跟踪方法,3D的视线跟踪方法,虽然在一定程度上可以克服头部运动,但对硬件的要求较高,且系统的标定过程比较复杂。在2D的视线跟踪方法中,瞳孔角膜反射技术由于其简单且有较好的准确性,因此它是目前基于视频的视线跟踪系统常用的方法[1]。

在传统的视线跟踪方法中,为了获取人眼真实的注视点,需要建立视觉特征和人眼注视点之间的映射关系。这要求用户在使用系统时,事先看屏幕上若干指定的点,训练一个映射函数,即进行系统标定,然后系统根据训练好的映射函数估计人眼在屏幕上的注视点坐标。对于自然的人机交互而言,这种标定过程是繁琐且不自然的。为避免这种明显的标定过程,Sugano等人[4]将显著图技术应用于视线跟踪系统中,提出了一种基于显著图的视线跟踪方法。首先让用户自然地看屏幕上的视频帧,把帧图像的显著图作为人眼注视点的概率分布,然后通过高斯过程回归建立人眼图像和人眼注视点之间的映射关系。然而,他们将整张人眼图像作为映射函数的输入,而人眼图像包含了很多的冗余信息且易受光照变化影响,因此他们的视线跟踪系统精度并不高(约为6°)。Chen等人[5]在Sugano等人工作的基础上将3D的视觉特征作为输入重构了基于显著图的视线跟踪算法,提出了一种基于3D的概率型视线跟踪方法。虽然他们的系统精度有所提高(约为3°),但是系统设备比较复杂。

本文在前人的基础上提出了一种新的基于显著图的视线跟踪方法。通过低成本的红外光源设备在人眼角膜上产生的光斑中心与瞳孔中心建立瞳孔-角膜反射向量,然后将该向量作为视觉特征重构了基于显著图的视线跟踪算法。下面将详细介绍提出的视线跟踪方法的整个流程。

1 系统描述

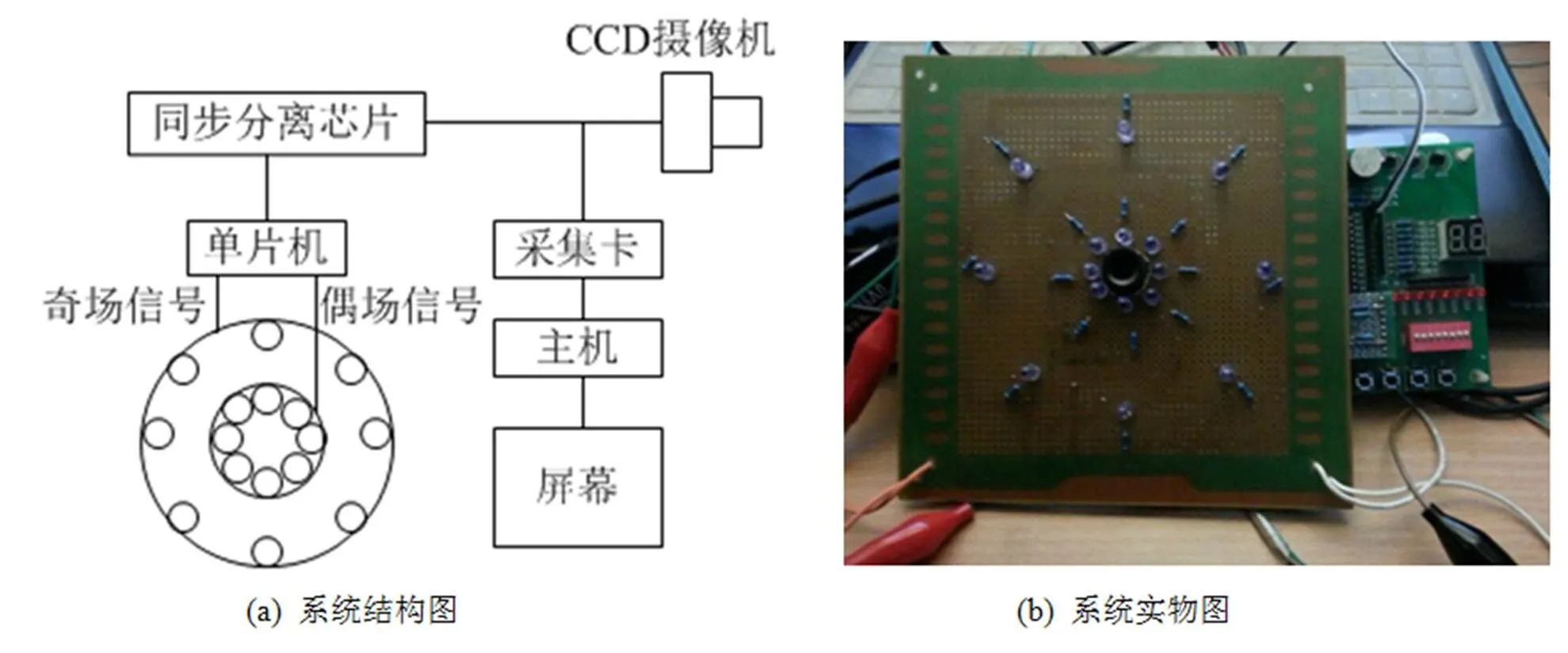

本文的红外光源设备[2]由CCD摄像机、镜头、近红外发光二极管、窄带通红外滤光片、视频同步分离芯片、图像采集卡、单片机、主机以及屏幕等组成。其中,近红外发光二极管的波长为880nm,镜头焦距为25mm,配合窄带通红外滤光片,可以产生较好的红外光照效果,增强了视线跟踪系统对光照变化的适应性。红外光源设备系统图,如图1所示。

系统工作时,用户注视屏幕,由CCD摄像机获取人脸图像,然后视频信号一路通过视频同步分离芯片(LM1881),分离出奇场和偶场信号,再通过单片机控制红外发光二极管灯组的亮灭;另一路视频信号通过图像采集卡,将视频帧传输到主机,通过编程将视频帧分离出奇场图像和偶场图像,即亮暗瞳孔图像,如图2(a)和图2(b)所示,之后对亮暗瞳孔图像进行差分,可以得到差分图像,如图2(c)所示。

2 瞳孔-角膜反射向量提取

2.1 瞳孔区域定位

得到差分图像后,通常需要对差分图像进行阈值化、形态学以及几何滤波[6-7]分离出瞳孔区域。然而,由于视线跟踪系统应用场景的复杂性,如光照变化、头部运动等因素影响,采用经典的单一阈值处理方法不能很好地分离出瞳孔区域,为此本文采用了如下处理方法。

图1 红外光源设备系统图

图2 亮暗瞳孔图像和差分图像

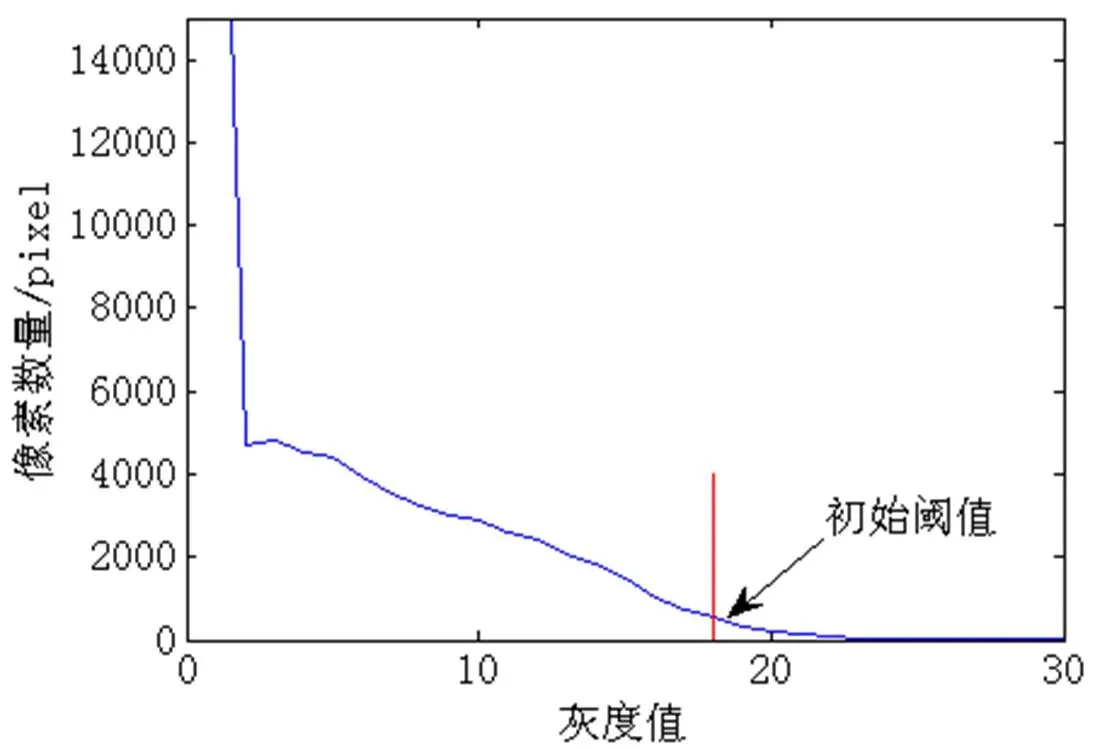

1)首先对差分图像求直方图,然后对直方图进行积分,并保证图像中亮像素点的数量(大约占图像中像素点总数的1/1000),这样能得到自适应的初始阈值[8],如图3所示。

图3 差分图像直方图和初始阈值

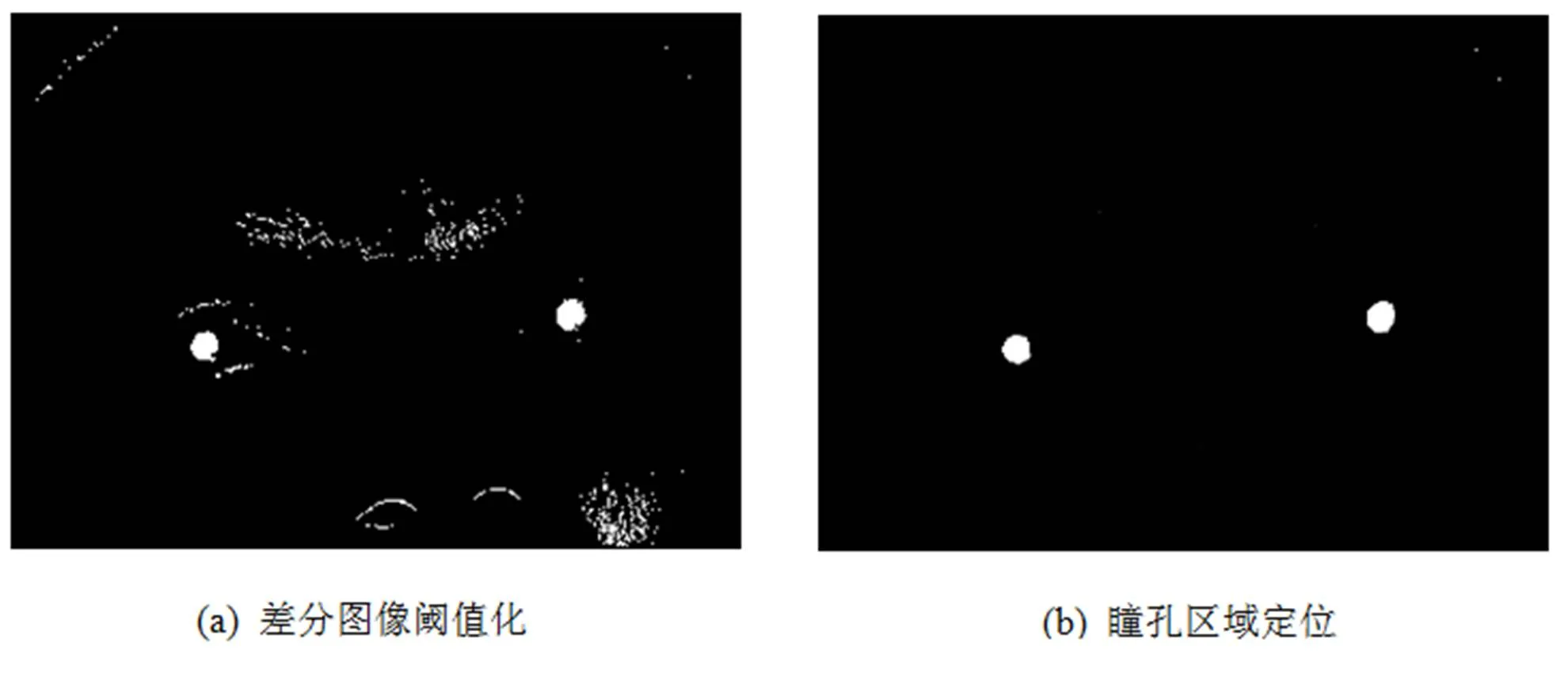

2)利用初始阈值对图像进行阈值化,如图4(a)所示,接着对阈值化后的图像进行连通区域分析,根据瞳孔的先验知识,如瞳孔的面积、长宽比、圆形度、周长、矩、瞳孔的个数以及两瞳孔之间的距离关系,进行几何滤波,剔除那些不符合要求的区域块,当没有满足条件的区域块时,则自动调整阈值。重复检测直到找到符合条件的区域为止,如图4(b)所示。

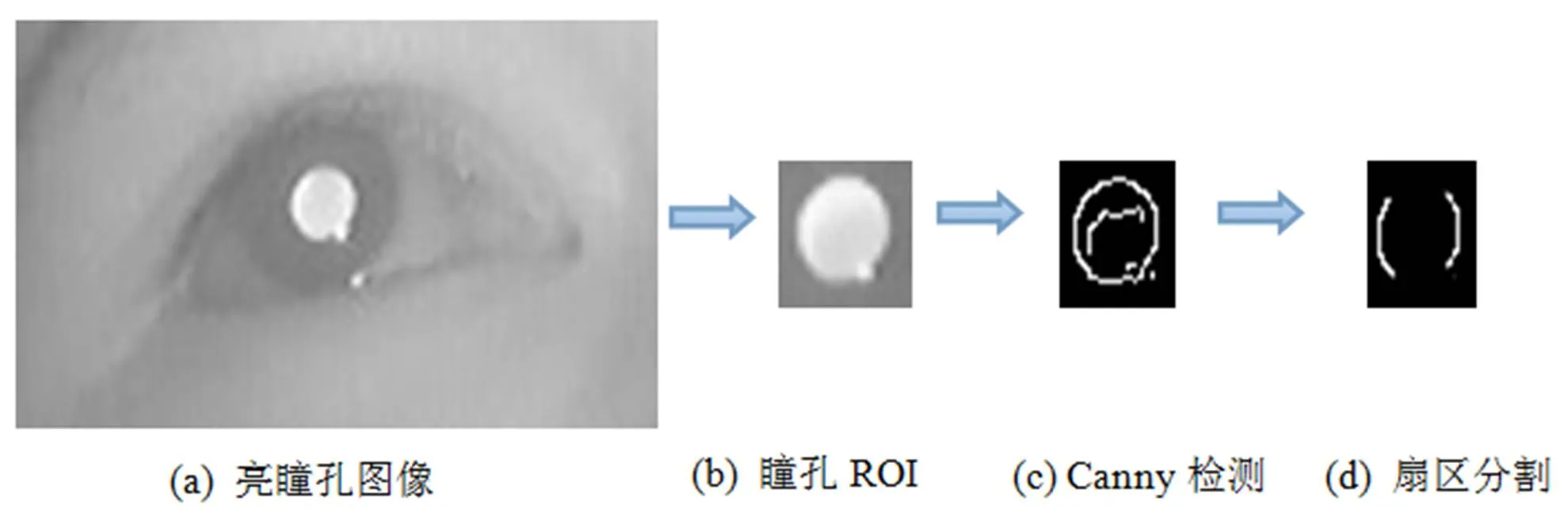

2.2 瞳孔和角膜反射光斑中心定位

在瞳孔区域定位后,在亮瞳孔图像中设置感兴趣区域ROI(Region of Interest),这样缩小了图像处理的范围,同时也有助于减少眼睑或眉毛对瞳孔的影响,然后利用Canny边缘检测算法对瞳孔区域进行边缘检测,之后对候选边缘利用连通区域及标记算法[2]进行分析,提取出最长的边缘作为瞳孔边缘,最后根据像素点的梯度差和梯度方向将瞳孔边缘分为4个扇区[9],取左右扇区中的边缘作为瞳孔候选边缘点。瞳孔边缘提取过程,如图5所示。

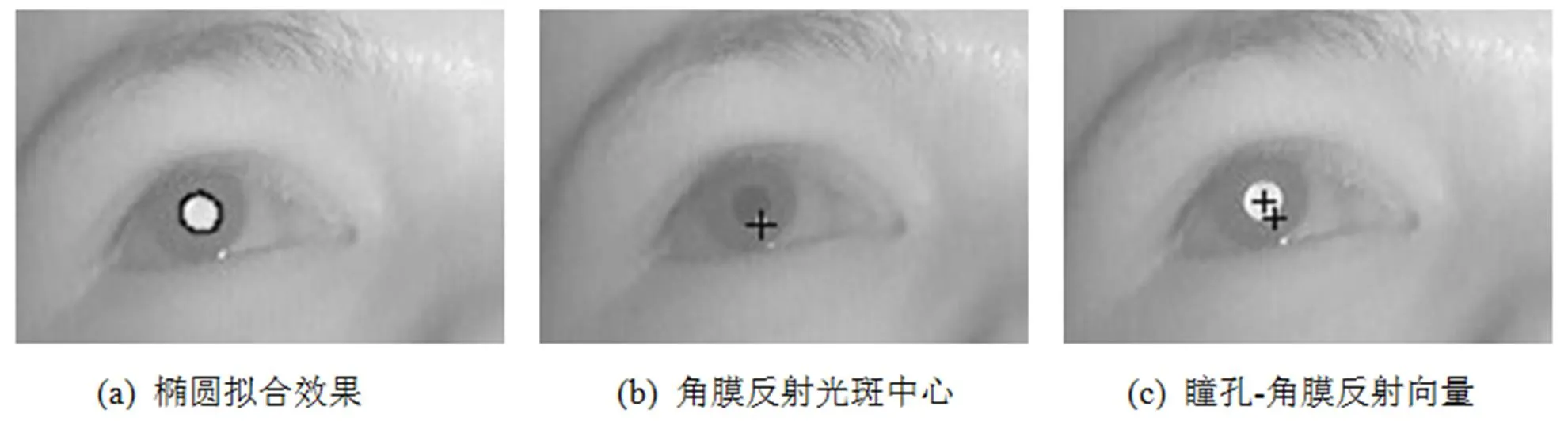

在确定瞳孔候选边缘点后,采用直接最小二乘椭圆拟合算法[10]对瞳孔候选边缘点进行拟合,并剔除离瞳孔轮廓较远的点,重复上述过程直到获取稳定的椭圆中心为止,并将椭圆中心作为瞳孔的中心位置(p,p)。另外,在头部保持不动的情况下,角膜反射光斑的位置通常是不变的[1-2],因此可以在暗瞳孔图像的瞳孔区域附近搜索角膜反射光斑,然后利用质心法[6]计算出角膜反射光斑的中心位置(c,c),最后根据两个区域的中心位置可以求得瞳孔-角膜反射向量=(pc,pc)。瞳孔-角膜反射向量的提取过程,如图6所示。

图4 差分图像阈值化和瞳孔区域定位

图5 瞳孔边缘提取过程

3 基于显著图的视线跟踪方法

3.1 视线跟踪系统框架

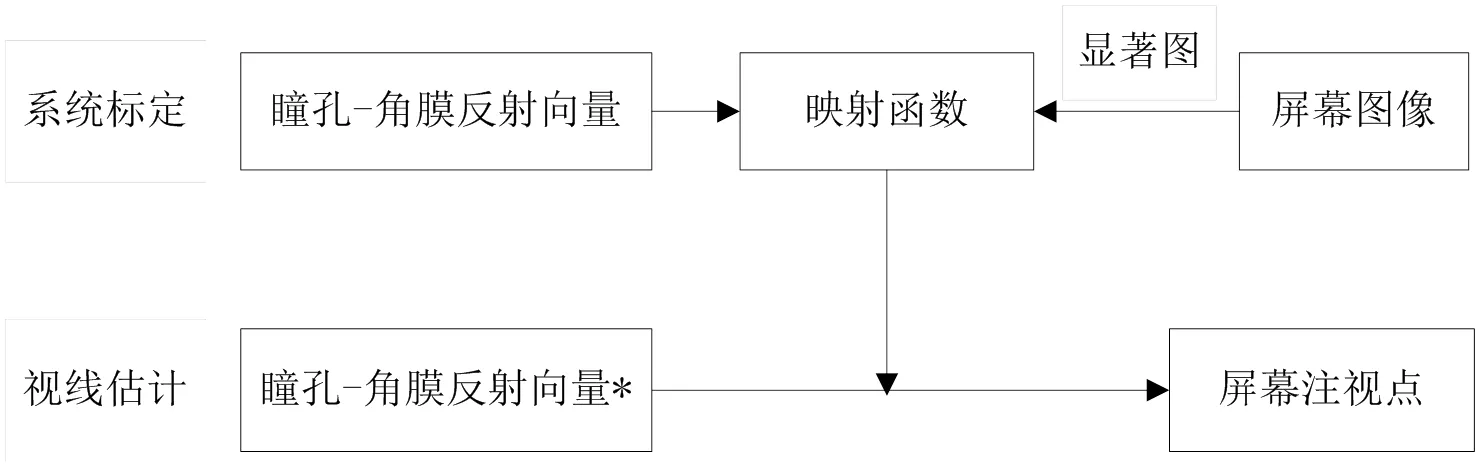

本文将瞳孔-角膜反射向量作为视觉特征重构了基于显著图的视线跟踪算法。通过让用户自然地看屏幕上的序列图像,结合显著图算法,训练一个从瞳孔-角膜反射向量到人眼注视点之间的映射关系,即进行系统标定。显然,这一过程并没有强迫用户看屏幕上若干指定的点。对用户而言,这是一种自由标定的体验。在显著图方面,本文利用了GBVS(Graph-Based Visual Saliency)算法[11]来生成图像的显著图。文献[11]的实验结果表明,人眼注视位置和GBVS算法生成的显著图有相当的一致性,利用显著图可以预测人眼在图像上的注视位置。GBVS算法生成的显著图,如图7所示。

在完成系统标定后,对新的人眼图像进行特征提取,得到瞳孔-角膜反射向量,根据训练好的映射函数进行视线估计,输出人眼在屏幕上的注视点。本文提出的基于显著图的视线跟踪系统框架,如图8所示。

3.2 视线估计

在提取到瞳孔-角膜反射向量后,本文基于向量相似度[4]建立瞳孔-角膜反射向量与人眼在屏幕上注视点之间的映射关系,结合GBVS算法生成的显著图,计算出人眼注视点在屏幕上的权值概率分布,最后根据权值概率分布,进行视线估计,获取人眼注视点的坐标。

图6 瞳孔-角膜反射向量的提取

图7 GBVS算法生成显著图

图8 视线跟踪系统框架

首先,假设屏幕依次显示张不同的图像{1,…,I},然后利用GBVS算法生成相应的显著图{1,…,s},且与之关联的人眼图像为{1,…,e},利用瞳孔-角膜反射技术对人眼图像提取瞳孔-角膜反射向量为{1,…,}。这样就生成了显著图和瞳孔-角膜反射向量数据集{(1,1),…,(s,}。

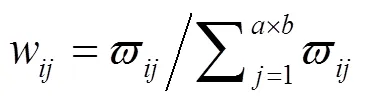

由于图像中的显著区域被认为是真实注视点所在区域,因此显著图可以被认为是人眼注视点的概率分布。基于这个思想,定义瞳孔-角膜反射向量的相似度为[5]:

式中:k是可调参数,且当瞳孔-角膜反射向量和比较接近时,的值会很大。

为了减少计算量,对显著图s缩小倍,则新的显著图为:

s*=s/,Î[1,] (2)

然后对s*进行×(长×宽)等分,得到区域1~q×,对于区域q在s*中的权值概率分布,可以定义为:

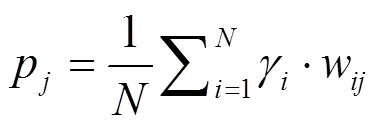

在得到权值概率分布后,根据新的人眼图像,提取瞳孔-角膜反射向量new,然后根据公式(1),计算new和1,…,n的相似度,即1,…,。另外,由于屏幕相应也被进行了×等分,因此,对于每个区域,人眼注视点落在该区域的概率为:

最后,将p为最大值时所对应的区域作为用户注视的区域,并且选取区域的中心位置作为人眼在屏幕上的注视点坐标。

4 实验结果

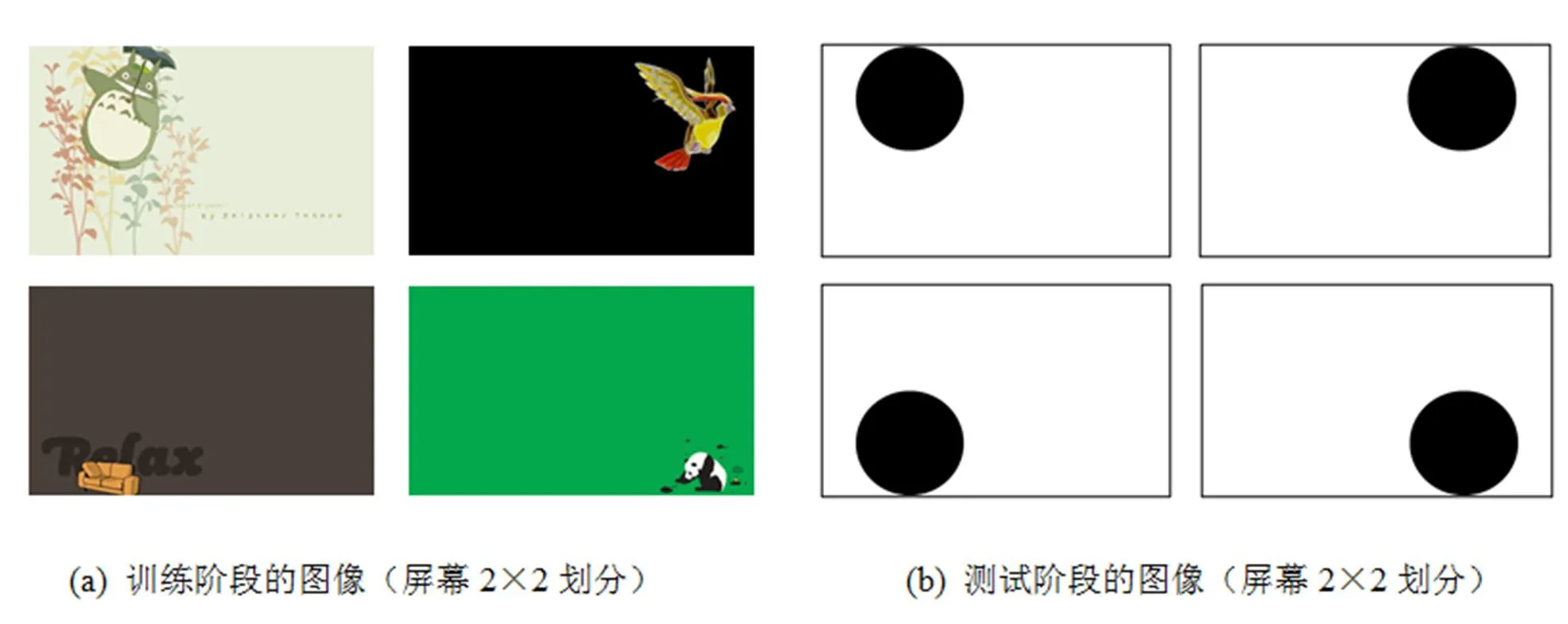

为了评估本文提出的视线跟踪方法,本文对50名能熟练操作计算机且视力正常的测试用户进行实验。实验环境为一般办公环境,计算机屏幕大小为14.1in(长31.22cm,宽17.55cm),显示分辨率为1024×768,摄像机图像分辨率为640×480,摄像机采样帧率为25Hz,测试用户距离计算机屏幕为50cm。根据不同的测试任务对屏幕进行2×2、3×3、4×4划分,例如对屏幕进行2×2划分表示将屏幕进行四等分。实验分别在正常光照条件、暗光照条件和亮光照条件下进行。实验使用的图像的显著内容尽量单一,且内容尽量分布在不同的区域,例如,在屏幕2×2划分下,训练和测试阶段使用的图像,如图9所示。

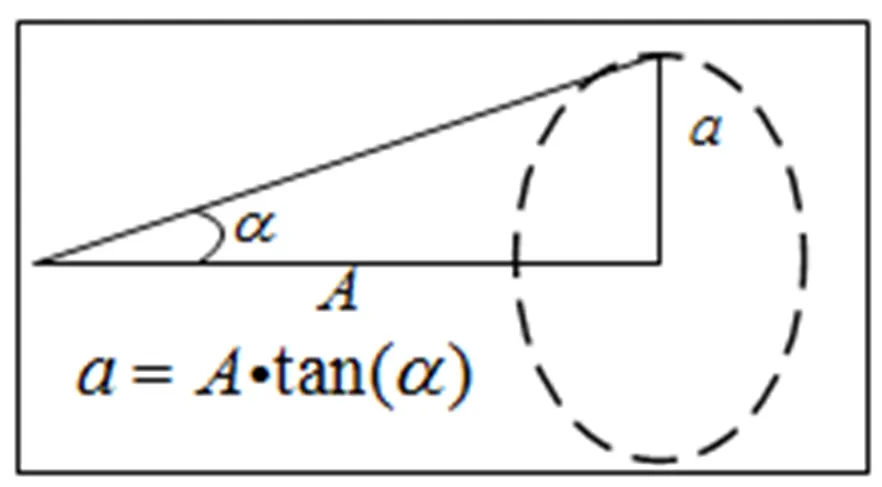

本文的视线跟踪系统的精度,可以由视角的测量误差[12]来度量(视角越小则精度越高),如图10所示。

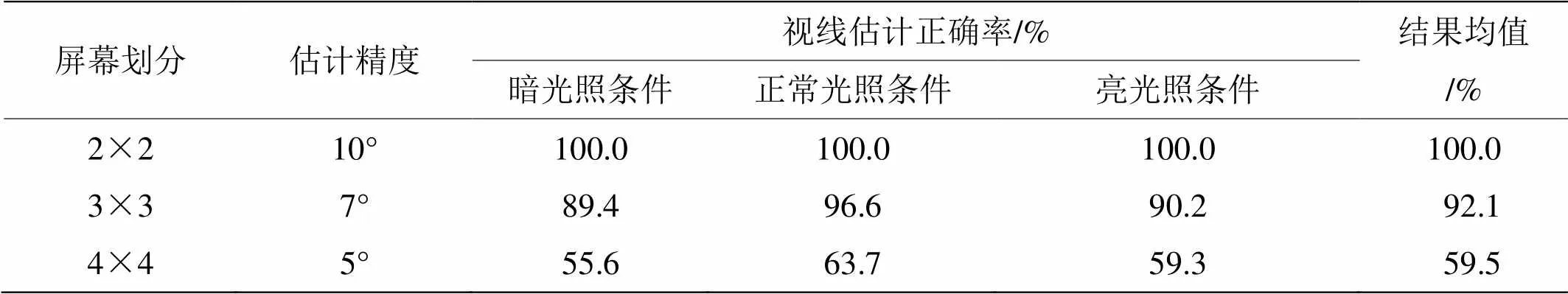

在屏幕大小为14.1in,显示分辨率为1024×768,用户距离屏幕为50cm条件下,根据不同的屏幕划分可以得到人眼注视的精度与屏幕圆形视觉区域的大小的对应关系,即视线估计精度参照表,如表1所示。

图9 训练图像和测试图像(屏幕2×2划分)

图10 视角三角形

表1 视线估计精度参照表

注:屏幕大小为14.1in,显示分辨率为1024×768,人眼与屏幕距离为50cm。

在实验过程中,测试用户自然地注视屏幕中全屏显示的图像,且假设用户始终注视屏幕上自己认为最显著的区域。对于每种屏幕划分(对应不同精度),在训练阶段,屏幕会每隔2s依次为用户呈现不同的图像,在屏幕自动更新图像前,系统会拍摄用户的人眼图像,然后提取瞳孔-角膜反射向量,将该向量用于系统映射函数的训练;在测试阶段,屏幕会依次显示定制的白底黑球图像,当用户注视白底黑球图像时,系统会再次提取瞳孔-角膜反射向量,结合训练好的系统映射函数,就可以计算出用户在屏幕上注视点的坐标。最后,将此坐标与实际的黑球区域进行比较,如果坐标落在黑球区域内,则判定系统对这次视线的估计是正确的,否则是错误的。另外,为了检验系统的健壮性,实验需要在不同光照条件下进行。在控制光照条件的情况下,对于每种屏幕划分,统计当前光照条件下系统成功视线估计的次数与当前光照条件下总实验次数的百分比,即当前光照条件下系统的视线估计的正确率为:

=/(5)

式中:是系统当前光照条件下的视线估计正确的次数;是系统当前光照条件下总的实验次数;是系统当前光照条件下视线估计正确率。考虑到环境因素、主观因素以及随机误差的影响,实践证明,当视线估计的正确率达到50%时就可以认为本次视线估计在当前光照条件下和精度要求下是有效的。

下面针对50名测试用户,在不同的屏幕划分和不同的光照条件下,分别进行20次实验的平均统计结果,如表2所示。

从表2可见,针对不同的屏幕划分和不同的光照条件下进行实验,实验结果表明,在精度为10°和7°的情况下,可以取得92%以上的正确率,说明当系统所要求的精度不高于7°时,视线估计的效果较好;在精度为5°的情况下,虽然视线估计的正确率有所下降,但仍可以达到59%(>50%)以上的正确率,说明本文的方法的视线估计精度可以到达5°。另外,在不同的光照条件下,视线估计的正确率基本一致,说明本文的方法对光照适应性较好,具有一定的健壮性。

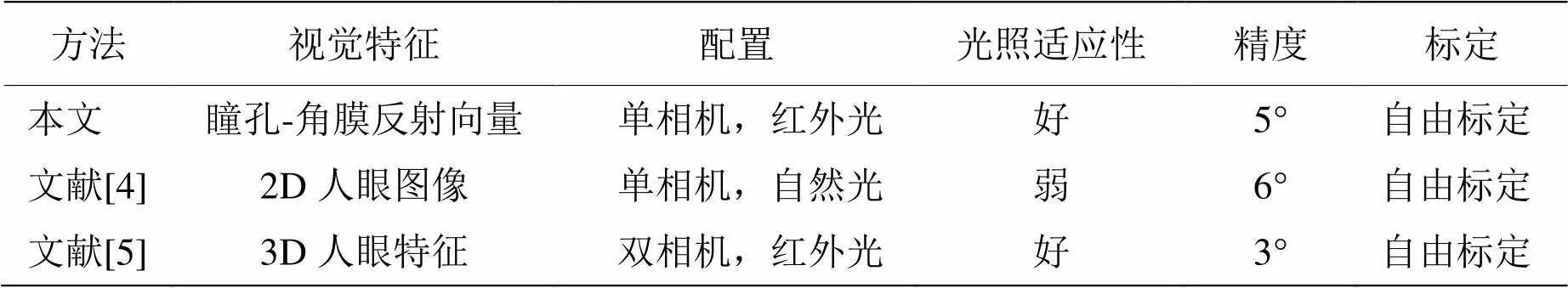

本文方法和其他与显著图相关的视线跟踪方法比较结果,如表3所示。

表2 实验统计结果

注:每个测试用户在每种屏幕划分和每种光照条件下都进行了20次实验

表3 本文方法与其他基于显著图的视线跟踪方法性能比较

注:文献[5]需要配置立体相机,用来标定相机、光源和屏幕的空间三维位置

从表3可见,本文方法采用了瞳孔-角膜反射向量作为视觉特征,在配置上使用了红外光源,增强了系统对光照变化的适应性,在精度以及光照适应性方面要优于采用自然光的文献[4],而与文献[5]相比较,虽然精度有所下降,但本文方法的配置相对比较简单,降低了硬件成本。

5 结论

本文将瞳孔角膜反射技术和显著图相结合,提出了一种新的基于显著图的视线跟踪方法。将瞳孔-角膜反射向量作为视觉特征重构了基于显著图的概率型视线跟踪算法,缓解了视线跟踪系统标定过程繁琐的问题,且对提高系统的精度和健壮性有一定的促进作用。总之,本文对视线跟踪系统的标定问题进行了尝试,提出了一种新的视线跟踪方法,这为面向人机交互的视线跟踪系统研究提供了可行的低成本解决方案。

[1] Hansen Dan Witzner, Qiang Ji. In the eye of the beholder: A survey of models for eyes and gaze[J]., 2010, 32(3): 478-500.

[2] 吴广发, 宋鸿陟, 黄生辉. 基于瞳孔-角膜反射技术的视线跟踪方法[J]. 现代计算机, 2014(5): 67-71.

[3] Zhu Zhiwei, Ji Qiang. Novel eye gaze tracking techniques under natural head movement[J]., 2007, 54(12): 2246-2260.

[4] Sugano Y, Matsushita Y, Sato Y. Calibration-free gaze sensing using saliency maps[C]//2010(CVPR), 2010: 2667-2674.

[5] Chen Jixu, Ji Qiang. Probabilistic gaze estimation without active personal calibration[C]//2011(CVPR), 2011: 609-616.

[6] 张闯, 迟健男, 张朝晖, 等. 一种新的基于瞳孔-角膜反射技术的视线追踪方法[J]. 计算机学报, 2010, 33(7): 1272-1285.

[7] 陈钱. 红外图像处理技术现状及发展趋势[J]. 红外技术, 2013, 35(6): 311-318.

[8] Haro A, Flickner M, Essa I. Detecting and tracking eyes by using their physiological properties, dynamics, and appearance[C]//, 2000, 1: 163-168.

[9] 张太宁, 白晋军, 孟春宁, 等. 基于单相机双光源的视线估计[J]. 光电子×激光, 2012, 23(10): 1990-1995.

[10] Fitzgibbon Andrew, Maurizio Pilu, Fisher Robert B. Direct least square fitting of ellipses[J]., 1999, 21(5): 476-480.

[11] Harel J, Koch C, Perona P. Graph-based visual saliency[C]//, 2006: 545-552.

[12] Gneo M, Schmid M, Conforto S, et al. A free geometry model-independent neural eye- gaze tracking system [J]., 2012, 9(1): 1-15.

A Novel Eye Gaze Tracking Method Based on Saliency Maps

HUANG Sheng-hui,SONG Hong-zhi,WU Guang-fa,SI Guo-dong,PENG Hong-xing

(,,510642,)

For the deficiencies that existing eye gaze tracking devices are complex and calibration procedures are tedious, a novel eye gaze tracking method using saliency maps is proposed. With pupil center and reflection center on corneal generated by IR light device, a pupil-corneal reflection vector is constructed, which then acts as a kind of vision feature to reconstruct the eye gaze tracking algorithm based on saliency maps. The experiment result demonstrates that the proposed method not only can alleviate the tedious calibration of eye gaze tracking, but also has a little improvement in system accuracy and robustness, which provides a feasible low-cost eye gaze tracking research for human computer interaction.

eye gaze tracking,pupil-corneal reflection vector,saliency maps,calibration

TP391

A

1001-8891(2015)05-0411-07

2014-12-02;

2015-02-10.

黄生辉(1987-),男,湖南郴州人,硕士研究生,主要研究方向为人机交互,红外图像处理。E-mail:ahuang1900@qq.com。

宋鸿陟(1972-),男,黑龙江大庆人,副教授,硕士生导师,主要研究方向为人机交互,信息可视化。E-mail:hz.song@163.com。

国家自然科学基金资助项目,编号:60875045。