网络教学中的学习情绪双元辨别研究

2014-08-07邓朝晖彭建胥

邓朝晖,彭建胥

网络教学中的学习情绪双元辨别研究

邓朝晖,彭建胥

针对目前网络教学系统中对学生学习情绪与学习状态的捕捉辨识存在问题,提出在网络学习情绪辨别机制中,结合人脸表情辨别和基于半投票机制的文字语意推论辨别两种非侵入性情绪辨别方式的优点,设计了网络实时监视指导单元。实验表明,该非侵入性的情绪双元辨别机制使网络教学系统中的学习情绪辨别率得到有效提升,系统交互性明显加强,为网络教学系统中学习情绪辨别机制的设计提供方向。

情绪双元辨别;人脸表情辨别;文字语意推论;实时监视;网络教学

Network Teaching

0 引言

情绪辨别是通过各种感应器,获取由情绪变化所引起的表情与生理变化信息,并对这些信息进行分析,以了解情绪变化。

随着情绪辨别的发展,越来越多的学者提出利用情绪辨别帮助学生学习网络课程。情绪运算的鼻祖Picard教授曾说过[1]:要让电脑更有智慧更自然的与人类互动,必须赋予电脑认识、了解、甚至表达情绪的能力。可见,在网络教学过程中,让电脑捕捉到学生的学习情绪表达,并提供恰当的反馈信息,能提高网络教学效率;在网络教学系统中设置能辨别学生学习情绪的实时监视指导单元,是网络教学系统设计的一个研究重点。

目前的网络教学系统,大多为学生提供了高弹性的互动学习环境(如:根据学生的知识背景设置教材内容与教学策略,对于差生降低学习难度等),很少研究涉及到学生的学习状态(如:学生学习能力的下降,可能是学习情绪的波动造成学习动机降低,而不是本身的学习能力有问题)。少部分的网络教学系统中考虑了对学生学习状态的捕捉,但大多采用头戴式感应帽或者在身体上安置各种生理信息感应器来获取情绪信息,这些侵入性的情绪辨别方式在某种程度上影响了学生的学习效果。

人类可以通过各种表情的传递、肢体语言、生理现象、声音及利用文字表达情绪,使用某种单一的方法来获取情绪是不完整的。所以,本文在网络教学系统中通过加入非侵入性的情绪辨别机制,利用人脸表情辨识和文字语意推论双元情绪辨别机制,可以更全面更准确地了解学生的学习情绪状态,为学生提供及时适当的课程内容与回馈做准备,以提高学生的学习兴趣和动机。

1 相关研究

1.1 人脸表情辨别

人脸表情辨别是指利用计算机对人脸表情信息进行特征提取,推断人的心理情绪,从而实现人机之间的智能交互[2]。

近年来,人脸表情辨别[3]在视频监控、身份验证和信息安全等领域的应用日益广泛。在过去的几十年内,已经提出了多种用于人脸表情辨别的方法,如:基于灰度分布特征的方法、基于运动特征的方法和基于频率特征的方法等。

一个完整的人脸表情辨别过程一般应包括四部分[4]:表情图像的获取、表情图像预处理、特征提取及表情分类辨别。1.2 自然语言处理

自然语言处理研究是人类用自然语言与计算机进行通信的实现,它使计算机既能理解自然语言文本的意义(自然语言理解),又能以自然语言文本表达给定的意图、思想等(自然语言生成)[5],实现自然语言处理,需要大规模真实语料库的研制工作及大规模、信息丰富的词典的编制工作。

近年来,情绪辨别技术的研究已成为自然语言处理中的热点问题,有关情绪分析的研究论文层出不穷[6~8]。在电子商务、信息安全等领域,情感分析技术有很多的应用需求[9]。

2 实时监视指导单元的系统构架

网络教学系统的实时监视指导单元由人脸表情辨别与学习状态辨别机制以及课程与互动机制两大部分组成,体系结构如图1所示:

图1 实时监视指导单元体系结构图

在网络教学过程中,学生通过系统终端用户界面进行网络课程学习:学生的表情状态信息通过人脸表情辨别处理后传送给互动代理,由互动代理选择合适的声音与动画反馈给学生;学生与系统的自然语言交流经过文字语意推论处理,将学习状态信息送给课程代理,课程代理选择适当的教学策略,并从课程数据库挑选合适的教材供学生学习。本文探讨人脸表情辨别与学习状态辨别机制的实现。

3 人脸表情辨别的实现

利用系统终端的网络摄像头采集学生的动态表情变化。对于采集到的视频序列帧:首先对每一帧进行人脸表情图像预处理,然后采用类内分块主成分分析方法进行特征提取,最后用核最近邻分类方法进行分类,以取得较好的表情辨别效果。

3.1 表情图像预处理

在表情图像预处理中,利用图像亚采样技术在原始图像中获得对表情辨别有帮助的人脸区域,采用灰度均衡化技术提高图像的整体对比度,使灰度分布均匀[10]。

亚采样由函数Subsample(aaa, r, c, iv, s)完成,其中r为图像经亚采样后的行像素数,c为图像经亚采样后的列像素数,iv为亚采样间隔△,参数s控制着亚采样网格的水平位移的大小。亚采样间隔△的取值合适与否对分类正确率与分类速度有很大影响。本系统△的取值通过实验确定在4和6之间。

为了消除因光照变化、不同肤色差异造成的图像细节的影响,对表情图像进行灰度值均衡化处理。灰度值均衡化是以累积分布函数变换法为基础的直方图修正法[11],变换函数如公式(1):

其中n是图像中像素的总和,nk是灰度级为rk的像素个数,L为图像中可能的灰度级总数,pr(rj)函数得到的曲线就是图像的灰度图。

3.2 表情特征提取

主成分分析方法(Principal Component Analysis, PCA)[12][13]具有简单直观、计算效率高、概念清晰、推广性强等优点,得到广泛应用。PCA表情特征提取过程为:首先对表情图像进行训练,得到一个用主成分描述的多维坐标系,然后把表情模板投影到该特征空间中,得到表情模板在该空间的投影系数,作为该模板的特征。对于一幅待辨别的表情图像,将其投影到该特征空间中,与表情模板进行匹配,对该幅表情图像进行分类。由于各类不同表情的差异较大,对所有的训练样本进行变换后,PCA表情辨别率较低。

基于传统PCA的不足,系统采用类内分块PCA方法进行特征提取:单独对每类表情训练样本进行PCA处理,得到只含有该类表情特征的主成份,与其他表情无关,这些单独构成每一类特征空间的主成份特征向量,就是“特征表情”。类内分块PCA算法如下:

(1)对当前类别为i(i=l,…,c)内划分后的全部训练样本子图像块(xij)kl(i=1,2…,Ni),求得该类样本总体协方差矩阵Σi2和均值xi;

(2)直接计算出矩阵Σi2的特征值Kih及相应的标准正交特征向量Uih(i=1,2…c,h=l,2,…,s*t);

(3)选取前r个最大特征值对应的标准正交归一的特征向量ui1,ui2…uir,这些特征向量组成的特征向量组便是符合条件的当前类训练样本子图像块的特征向量组,构造最优投影矩阵U′=[ui1,ui2,…,uir];

(4)对每个已有类别进行训练,直至得到所有类别的最优投影矩阵Ui′;

(5)对每一类表情的所有训练样本向该类子空间投影来提取特征,计算出所有训练样本的特征矩阵Yij(pr×q);

(6)看看是否所有类别的训练样本均已训练完,若是,则结束;否则继续回到第(1)步开始,直至得到所有类别的训练图像的特征矩阵;

(7)对待测试样本,向各个类别的最优投影矩阵Ui′投影来提取特征,得到一组特征矩阵Yij{t1,t2,…,tC}。

3.3 表情分类辨别

系统采用核最近邻分类方法进行表情分类辨别,通过利用Mercer核,把输入空间样本映射到高维特征空间,使得映射后同类样本接近,异类样本变远。

已知分别属于C个类{wi,i=1,2,...,C}的j个样本{x1,x2,…,xj},对于未知类别样本x的判决过程为:计算未知样本到已知样本的核距离,找到其最小距离对应的样本xk。判决决策规则为:对于未知样本x,比较x与j个已知类别的样本之间的核距离,x与其最近的样本同类。

4 文字语意推论的实现

系统的文字语意推论基于本体论和自然语言处理的推论模式。

4.1 本体论

本体是共享概念模型的明确的形式化规范说明[14],本体的本质是:(1)概念化,通过抽象出客观世界中一些现象的相关概念而得到的模型;(2)明确性,概念及它们之间的联系都有明确的定义;(3)形式化,精确的数学描述,计算机可读;(4)共享化,本体中体现的知识可跨应用系统进行互操作。

本体论的核心作用是利用树状结构定义某一领域的专业词汇及它们之间的关系,其中节点是一个个的词汇,节点之间的连接就是词汇之间的关系。领域本体是本体的一种,它描述特定领域(医疗、教学等)中概念与概念间的关系,其目的是捕获相关领域的知识,提供对该领域知识的共同理解,确定该领域内共同认可的词汇,并从不同层次的形式化模式上给出这些词汇和词汇之间相互关系的明确定义[15]。

要让计算机具有推理功能,必须建立相关教学领域的领域本体。系统采用的本体为MIT media lab制作的OMCSNet语义网。

4.2 自然语言处理

与计算机交互过程中,学生用文字表达抽象的信息。对于实时监视指导单元来说,句子中的动词、形容词、副词包含有状态信息,因此这些词就是句子的关键字。

美国卡内基美隆大学的link parser连接解析器提供句子间隶属的阶层关系,能清楚的判别句子的关键字位置及不同关键字的词性,从而选出对情绪有影响的词进行推理。例如对于句子:I saw a girl saw a saw. 输出为[ S[ NP I NP] [ VP saw [ SBAR[ S[ NP a gir NP] [ VP saw [ NP a saw NP] VP] S] SBAR ] VP ] S ] 。其中,最外层的S代表句子,它包含两个成员:NP的I和以saw开头的VP(包含子句)。句子最主要的表达含义通常位于最外层的主要句子,因此适当加重外层句子关键字所提供情绪信息的比重,可以得到更准确的情绪信息。假设输入文字内容由argv字符串输入本算法,下标从1到n,句子结构的处理算法如下:

For each token form argv[1] to argv[n]

On [*:push *into symbolStack,push an empty string into tokenStack.

On *]:push *into symbolStack.top()into“digestedSymbol,” push tokenStack.top() into“digestedToken.”

On *:Append currentString in tokenStack.top()

接着处理学习情绪信息。sumEI是目前已经统计处理的情绪信息,共10项,如sumEI[0]代表满意等。currentEI表示目前子句所提供的情绪信息。算法如下:

While (currentsSS=SubSentence.pop())//若还有子句未处理

{

Eicap=MAX(sumEI[i])//选择十项中最大值

If(currentSS.negated)

For each sumEI[i]:

{

sumEI[i]=CEIL(Eicap)-sumEI[i];

sumEI[i]+=currentEI[i];

}

}

4.3 语意推论的准确度与投票机制

在普林斯顿大学的WordNet中,名词、动词、形容词和副词均被组成一个同义词网络,每个同义词集合代表一个基本的语意概念。例如:很棒的(awesome)这种学习状态可搜到的同义词组为amazing、awe-inspiring、awful、awing等。

为了提高语意推论的全面性,系统采用WordNet对输入语句做更广泛的搜索和更深层的推论,然后再用OMCSNetKai推论引擎查找句子中各子句与各同义词之间的关联度。同时,将学生意见作为推论的一部分,形成半自动化的投票机制。算法如下:

(1)在OMCSNetKai推论引擎中,学生输入的语句经过自然语言处理后形成一个个的概念Ci(i=0,1,2,…,n)

(2)对于每一个概念Ci,利用WordNet的同义词查询后得到一个概念组SEi;

(3)对于SEi中每个概念,利用基于OMCSNet语义网的OMCSNetKai语意推论引擎对每种学习状态集合内的元素作相关度的推论。投票方法开始参与学习状态决策的流程,学生在投票方法中可以决定是否参与投票,如果参与,将提升被选择学习状态原始值一倍的程度。

5 实验结果与分析

系统采用日本ATR 媒体信息科学实验室的JAFFE 表情数据库作为人脸表情辨别准确率测试的检验平台,可获得的JAFFE数据库包含有10 名日本女性的7 种表情,每种表情图片由2~4 张不等的256×256 的灰度图组成,共213张,分析结果如表1所示:

表1 人脸表情辨别率

通过分析可知:本系统的人脸表情辨别方法是有效的,为系统及时了解学生的学习情绪提供了可靠依据。

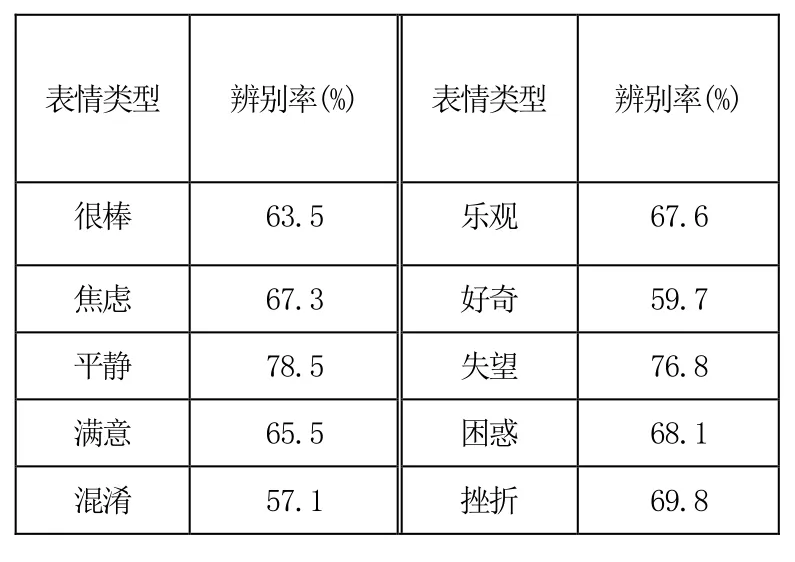

为了判断文字语意学习状态辨别率,在网络文本中随机挑出含有学习状态的文字语句作为分析样本,10种学习状态各100句,总共1000句,分析结果如表2所示:

表2 语意学习状态辨别率

OMCSNetKai语意推论引擎结合WordNet同义词查询能帮助计算机收获更多语意中更深层次的含义。另外,在语意推论部分,将学生意见作为推论的一部分,形成的半自动化投票机制,为确认学生的学习状态提供了保障。

通过实验分析可知,采用本文提出的人脸表情辨别与文字语意推论辨别相结合的情绪双元辨别模式,准确率比单一情绪辨别模式要高10%左右。

6 总结

在网络教学系统的实时监视指导单元中引入采取表情辨别与文字语意推论辨别相结合的非侵入性情绪双元辨别机制,取得了较好的学习情绪辨别效果。未来的研究工作,可考虑加入其他非侵入性情绪辨别方法:如在系统中加入语音情绪辨别,方便学生利用音频输入设备直接与系统交流。在人脸表情的辨别方面,可以采取类神经网络等方便快速的人脸辨别作为改良的辨别方法,以进一步提高系统的学习情绪辨别率。

[1] Picard R. W., Papert S., Bender W. Affective learning-a manifesto. [J]BT Technology Journal. 2004, Vol22, NO4.

[2] 刘芳. 应用图像处理技术的人脸表情识别研究[D]. 北京:北京科技大学硕士学位论文, 2003, 06.

[3] WRIGHT J, YANG A, GANESH A, et al. Robust face recognition via sparse representation[J]. IEEE Trans on Pattern Analysis and Machine Intelligence, 2009, 31(2): 210-227.

[4] 李文. 人脸表情识别研究[D]. 西安: 陕西师范大学硕士学位论文, 2007, 05

[5] 宗成庆. 统计自然语言处理[M]. 北京: 清华大学出版社. 2008.

[6] 杨江, 彭石玉, 侯敏. 基于主题情感句的汉语评论文倾向性分析[J]. 计算机应用研究, 2011, 28(2): 569-572.

[7] 段建勇, 谢宇超, 张梅. 基于句法语义的网络与论情感倾向性评价技术研究[J]. 情报杂志, 2012, 31(1):147-150.

[8] LI Shou-shan, HUANG Chu-ren,ZONG Cheng-qing. Multi-domain sentiment classification with classifier combination[J]. Journal of Computer Science and Technology, 2011,26(1): 25-33.

[9] 衣丽霞, 王辉, 籍晓红. 情感分析中极性副词的自动扩展[J]. 计算机应用研究. 2013, 30(7):1958-1960,1970.

[10] 罗元, 吴彩明, 张毅. 基于PCA与SVM结合的面部表情识别的智能轮椅控制[J]. 计算机应用研究. 2012, 8: 3166-3168.

[11] 章毓晋. 图像处理与分析[M]. 北京:清华大学出版社, 1999.

[12] Calder Andrew J, Burton A Mike, Miller Paul, Young Andrew W. A Principal Component Analysis of Facial Expressions[J]. Vision research, 2001, 41: l 179—1208.

[13] Baek Kyungim, Draper Bruce A, Beveridge J Ross, She Kai. PCA VS. ICA: A comparison on the [OJ] http://www.dodcounterdrug.com/faciakecognition/FRVT 2000/frvt2000.htm.

[14] Knowledge System Laboratory, Stanford University. What is an ontology[EB/OL].(2009-01-28)[2011-05-1 0].http://www-ksl.stanford.edu/kst/what-is-an-ontology.ht ml.

[15] 崔其文, 解福. 改进的领域本体概念语义相似度计算方法[J]. 计算机应用与软件. 2012, 29(2): 173-174, 182.

Research of Learning Emotional Dual Recognition in Network Teaching

Deng Zhaohui, Peng Jianxu

(Computer Information Management Department, Chenzhou Vocational Technical College, Chenzhou423000, China)

To solve the problem about identification of learning state in current network teaching system, it combined the adventures of facial expression recognition and text semantic recognition based on semi-voting in learning emotional recognition mechanism, and designed a real-time monitoring guidance unit. Through experiments, it showed that in network teaching system the learning emotional recognition rate and human-computer interaction could be improved greatly by the mechanism provided a direction for the emotional recognition mechanisms of network teaching system.

Emotional Dual Recognition; Facial Expression Recognition; Text Semantic Recognition; Real-Time Monitoring;

TP311.51

A

1007-757X(2014)01-00035-04

2013.11.20)

湖南省高校科研项目(12C0977)

邓朝晖(1973-),女,郴州职业技术学院计算机信息管理系,副教授,硕士,研究方向:虚拟实验、动画制作,郴州,423000彭建胥(1974-),女,郴州职业技术学院计算机信息管理系,副教授,本科,研究方向:计算机应用技术,郴州,423000