帧间差分相位谱帧长和帧移的最优设置方法

2013-04-12王金芳聂新礼

王金芳,虢 明,聂新礼

(吉林大学通信工程学院,长春130012)

说话人识别是一种利用语音识别人身份的技术,处理过程分为训练和测试。训练是指从语音中提取出能表征说话人个性的特征并建立模型的过程,测试是指将待测试语音与已建立的模型匹配以判断此说话人身份的过程。说话人识别分为说话人鉴定和说话人确认。由于相位卷绕(Wrapping)等问题[1-3],目前大多数特征的提取都是利用语音的幅度信息,很少顾及相位。最近可懂度测评实验[4]表明了语音相位的重要性,在合理选择帧长(100~1000 ms)的条件下,短时相位谱对人类感知有不可忽视的作用[5-8],且在相位分析方面矩形窗明显优于其他窗函数[8-10]。分别对短时相位谱取时间、频率微分得到两种常用参数,瞬时频率[11-12]和群时延[13]。无论何种参数,帧长和帧移的选取极大地影响语音信号短时相位谱。McCowan等[14]提出从相邻帧间相位谱差中提取特征,指出帧长和帧移参数的设置需在相位突变检测能力和相位噪声两方面进行折中考虑,但其参数设定仅依靠经验分析。

利用互信息理论[15]选择说话人识别特征,已进行了一定的研究[16-17],在此基础上,本文提出利用短时幅度谱和Mel频率Delta相位倒谱系数(Mel-Frequency Delta-Phase Cepstral Coefficients,MFDPs)间互信息确定帧长和帧移的方法。这里虽以MFDP特征为例,但同样适用于其他基于短时相位谱的特征提取,仿真实验验证了其可靠性。

1 Mel频率帧间差分相位倒谱系数

语音信号为s(n),其短时离散傅里叶变换定义为

式中:m是帧索引;w(n)表示长为的窗函数;D指帧移(满足D≤T)。与幅度不同的是,窗函数对相位有影响,并且同一语音信号各帧间无共同时间参考点,解决方法是对短时相位谱进行补偿。定义帧间差分相位谱

以帧间差分相位谱的绝对值|ΔΨm(k)|代替幅度谱按照Mel频率倒谱处理方法提取MFDP特征,其性能仅略低于基于幅度谱的MFCC特征[14]。

2 相位谱参数确定

2.1 互信息

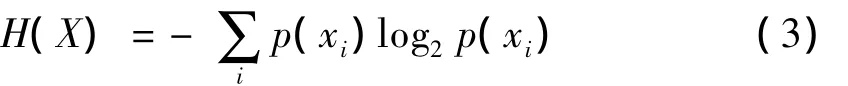

离散随机变量的信息熵H(X)定义为

式中:p(xi)=p{X=xi}表示随机变量X取值为xi的概率。

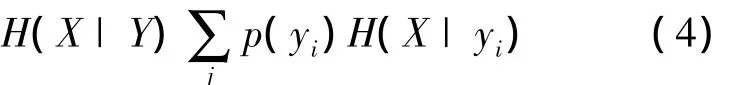

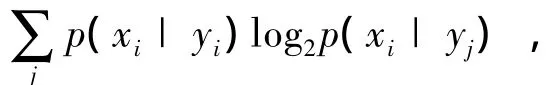

在随机变量Y条件下X的平均条件熵定义为

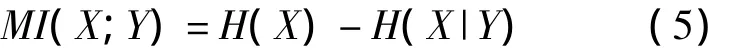

两个随机变量X、Y所构成的信息集合间的相关性可用互信息来衡量,定义为

互信息具有非负性MI(X;Y)≥0,对称性MI(X;Y)=MI(Y;X)和有界性MI(X;Y)≤H(X) +H(Y)。

2.2 帧长和帧移选择

为度量说话人自身与语音特征间的相关性,文献[16]将声学空间到特征空间映射过程捕获的信息量用互信息表示,当互信息量达到最大时,识别错误率最低。

离散瞬时频率是对相邻时刻点之间的相位作差,而帧间差分相位是对相邻帧相位作差,帧移可以不是一个采样点,因此可以看作是瞬时频率基础上的延展。帧移增大,相位变化的分布范围展宽,导致检测相位突变的能力提高,但同时在远端FFT频率间隔内引入相位噪声。最优的帧移与帧长比(D/T)在增大相位检测突变能力和抑制噪声之间达到平衡。依据互信息理论确定最优帧长和帧移的准则函数可定义为

式中:X是傅里叶变换幅度谱(Fourier Transform Magnitude Spectrum,FTMS),作为参考谱表征说话人声学空间,Y表示MFDP特征。图1为基于互信息准则的参数选择算法框图。

图1 基于互信息准则的参数选择算法框图Fig.1 Parameter selection scheme based on mutual information criterion

3 实验结果与分析

实验选用的语料库为TIMIT库,是语音信号处理的标准语料库,共有630个说话人,语音为16 kHz采样、16 bits量化。从库中选取114位参录者的语音用于实验,每人10条,每条语音长约3 s。其中9条语音串接起来用于训练,1条用于测试。设计实验与文献[14]中参数设置实施对照,使用矩形窗T=4096,D=160,Mel滤波器数量取24,模型选用高斯混合模型,共进行如下3组实验。

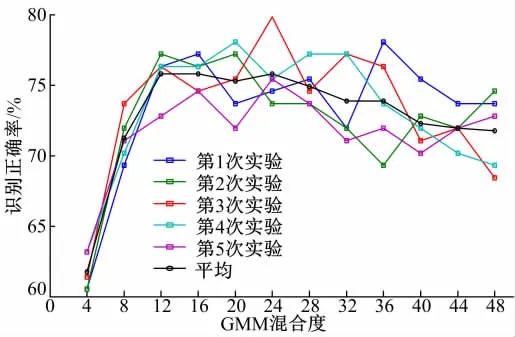

实验1 确定高斯混合度。图2给出特征维数取12时,混合度为4~48的5次说话人识别实验结果。当混合度为12~24时,系统平均识别正确率最大,获得相对最好的性能。综合考虑计算代价和准确率,混合度选定为16。

图2 不同混合度的说话人识别性能Fig.2 Speaker recognition performance of differentmixtures

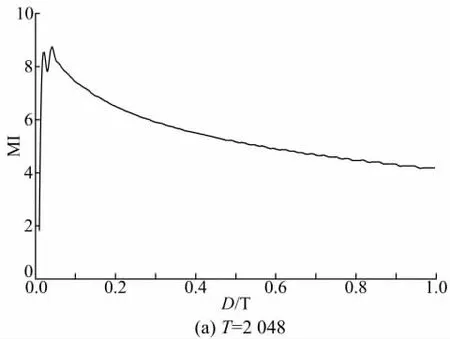

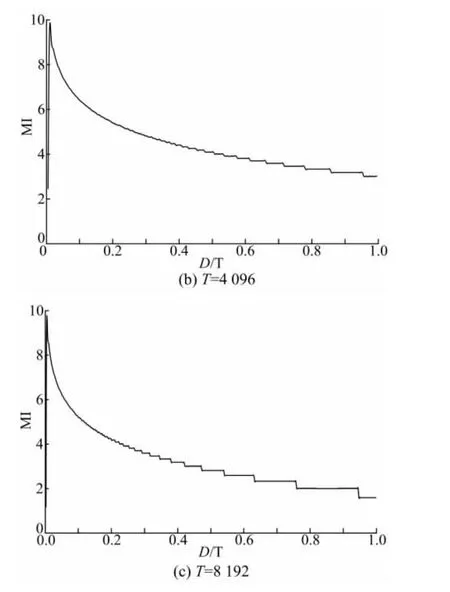

实验2 分析所提出算法的性能,并确定最优参数。实验采用矩形窗,T分别取2048、4096、8192,并且20<D<T,Mel滤波器数量为24,特征维数为22。图3是某说话人的互信息与D/T关系曲线。实验结果表明,随着T增加,互信息曲线逐渐呈现单峰性。由不同T的曲线形态可知,改变帧长导致基于相位谱的MFDP特征对说话人表征能力存在差别。经统计发现,T不小于2048点时,最优D/T都介于0到0.1之间,且随T增加,最优D/T呈现减小趋势。图3(c)较之于图3(b),当D/T大于0.4时,曲线出现“阶梯性”,变得不平滑。因此,综合考虑性能和运算代价,最优帧长确定为4096。图4给出基于最大互信息准则的不同帧长的最优D分布曲线,最优D取值如表1所示。

图3 某说话人不同T的互信息与D/T关系Fig.3 Relation between M I and D/T for some speaker w ith different T s

图4 不同T下最优D的分布Fig.4 Distribution of optimal D w ith different T s

表1 不同T下的最优D取值Table 1 Optimal D w ith different T s

实验3 在说话人识别系统上检验上述帧长和帧移参数的有效性。下面给出以干净语音训练说话人模型,分别用干净和带噪语音进行测试的结果。

实验按图4(b)改变最优D,5次干净语音测试结果如图5所示,其中D取值20~160,平均识别率总体趋势先增大后降低,D=60处识别率达到峰值,其变化趋势与图4(b)中最优D分布曲线相吻合。最优D的其他取值识别结果明显优于作为对照D=160的情况。实验验证了所提出算法的准确性和可靠性,同时说明通过经验分析得到的参数存在缺陷。

图5 不同D下以干净语音测试的识别性能Fig.5 Test performance of clean speech w ith different D s

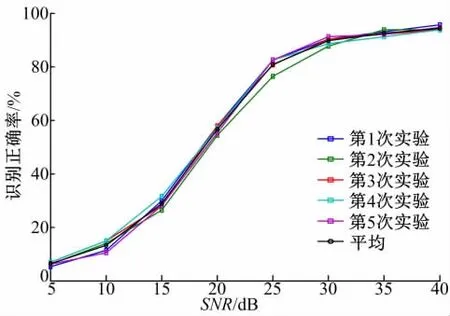

将干净语音按5~40 dB叠加高斯白噪声生成带噪语音进行测试,D取60的识别性能如图6所示。40 dB带噪语音与干净语音对系统的测试结果接近。识别性能随信噪比降低而急剧恶化。由此可见,训练和测试条件不匹配导致MFDP特征对说话人个性表征能力减弱。

图6 D=60用带噪语音测试的识别性能Fig.6 Test performance of noisy speech w ith D=60

4 结束语

本文提出一种利用最大互信息准则确定帧间差分相位谱帧长和帧移的参数设置方法。首先依据相位信息提取特征矢量集,然后计算此特征矢量集与幅度谱的互信息,按照最大化互信息准则确定帧长和帧移。实验结果表明,本文方法较经验分析方法更准确,有效弥补后者的缺陷,而且本文方法的有效性和正确性得以充分验证。由实验过程发现,训练和测试条件不匹配对系统识别率产生极大影响,这将是下一步需要着重解决的主要问题。

[1]Al-Nashi H.Phase unwrapping of digital signals[J]. IEEE Transactions on Acoustics,Speech and Signal Processing,1989,37(11):1693-1702.

[2]Murthy H A,Madhu Murthy K V,Yegnanarayana B. Formant extraction from phase using weighted group delay function[J].Electronics Letters,1989,25(23): 1609-1611.

[3]Yegnanarayana B,Murthy H A.Significance of group delay functions in spectrum estimation[J].IEEE Transactions on Signal Processing,1992,40(9):2281-2289.

[4]Alsteris L D,Paliwal K K.Further intelligibility results from human listening tests using the short-time phase spectrum[J].Speech Communication,2006,48(6): 727-736.

[5]Liu L,He J,Palm G.Effects of phase on the perception of intervocalic stop consonants[J].Speech Communication,1997,22(4):403-417.

[6]Oppenheim A V,Lim JS.The importance of phase in signals[J].Proceedings of the IEEE,1981,69(5): 529-541.

[7]Schroeder M R.Models of hearing[J].Proceedings of the IEEE,1975,63(9):1332-1350.

[8]Alsteris L D,Paliwal K K.Short-time phase spectrum in speech processing:A review and some experimental results[J].Digital Signal Processing,2007,17(3):578-616.

[9]Reddy N,Swamy M.Derivative of phase spectrum of truncated autoregressive signals[J].IEEE Transactions on Circuits and Systems,1985,32(6):616-618.

[10]Alsteris L D,Paliwal K K.Importance of window shape for phase-only reconstruction of speech[C]∥ in Proc. IEEE International Conference on Acoustics,Speech,and Signal Processing(ICASSP '04),Montreal,Quebec,Canada,2004:573-576.

[11]Wang Y,Hansen J,Allu GK,etal.Average instantaneous frequency (AIF)and average log-envelopes (ALE)for ASR with the Aurora 2 database[C]∥ in Proc.Interspeech 2003,Geneva,Switzerland,2003:25-28.

[12]Stark A P,Paliwal K K.Speech analysis using instantaneous frequency deviation[C]∥in Proc.Interspeech 2008,Brisbance,Australia,2008:2602-2605.

[13]Murthy H A,Gadde V.Themodified group delay function and its application to phoneme recognition[C]∥in Proc.IEEE International Conference on Acoustics,Speech,and Signal Processing(ICASSP'03),Hong Kong,China,2003:68-71.

[14]McCowan I,Dean D,McLaren M,et al.The deltaphase spectrum with application to voice activity detection and speaker recognition[J].IEEE Transactions on Audio,Speech,and Language Processing,2011,19(7): 2026-2038.

[15]McEliece R J.信息论与编码理论(第二版)[M]:北京:电子工业出版社,2003.

[16]Eriksson T,Kim S,Hong-Goo K,et al.An informationtheoretic perspective on feature selection in speaker recognition[J].IEEE Signal Processing Letters,2005,12 (7):500-503.

[17]Rajan P,Hegde R M,Murthy H A.Dynamic selection ofmagnitude and phase based acoustic feature streams for speaker verification[C]∥in Proc.European Signal Process.Conf.,Glasgow,Scotland,2009:1244-1248.