基于改进SIFT算法的视频序列图像配准

2011-06-14汪道寅胡访宇

汪道寅,胡访宇

(中国科学技术大学,安徽合肥230027)

0 引言

图像配准技术是图像融合和图像重建等应用的前提,是不可缺少的关键步骤。图像配准可分为基于特征和基于区域的配准,其基本步骤为特征检测、特征匹配、匹配函数设计和图像的变换及重采样[1]。图像配准在医学、遥感和目标识别等众多图像分析领域得到了广泛地应用,是图像处理领域中研究的热点。

尺度不变特征SIFT是由David Lowe于1999年提出,并于2004年总结完善[2]。SIFT匹配算法主要可分为特征检测、特征描述和特征匹配3个部分。Mikolajczyk和 Schmid通过对比 SIFT、PCA-SIFT、Steerable Filter和Moment Invariants等数10种特征描述后指出[3],SIFT是目前最为有效地特征检测算子。SIFT算法存在需要完善的地方,如匹配部分的部分阈值参数不具有普遍适用性,并且误配点没有得到有效的剔除。针对以上问题提出相应改进,并将其应用到视频序列图像的配准当中。实验表明,改进算法实现了更有效的配准。

1 SIFT算子

1.1 检测尺度空间的特征点

图像在尺度空间中表示为图像和可变高斯核函数的卷积,LoG(Laplacian of Gaussian)算子表达式为:

对相邻层的卷积结果进行差值,得到差分金字塔DoG(Difference of Gaussian),DoG算子是对LoG算子的近似,其表达式为:

式中,因子k满足k=21/S;D(x,y,σ)在尺度空间中的极值点作为候选特征点。

1.2 精确定位特征点的位置

差分金字塔DoG的泰勒展开式为:

式中,X=(x,y,σ)T为包含特征点位置和尺度信息的向量。通过D(X)的幅值大小及其曲率来筛选特征点,D(X)的曲率特性通过其二阶微分组成的Hessian矩阵来度量。

1.3 确定特征点的主方向

点坐标为(x,y)处的梯度幅值和方向为:

在以特征点为中心的邻域内用梯度方向直方图来统计邻域像素的梯度方向。梯度方向直方图的峰值代表了该特征点处邻域梯度的主方向,即作为该特征点的主方向。

1.4 生成特征描述符

以特征点为中心取16×16的方格,每个小格代表特征点邻域所在尺度空间的一个像素。在4×4的图像小块上计算8个方向的梯度方向,绘制每个梯度方向的累加值,形成128维的SIFT特征向量即特征描述符。对特征描述符进行归一化并与阈值0.2比较,使其对线性变化和光照具有不变性。

1.5 特征点之间的匹配

采用特征描述符向量之间的Euclid距离来度量2个特征点之间的匹配程度。当2个特征描述符的Euclid距离最小并且与次最小Euclid距离的比值小于给定的阈值时,则这2个特征点匹配。

2 SIFT改进算子

SIFT改进算子的步骤可分为特征检测、特征描述和特征匹配。首先,对待配准图像和参考图像进行特征检测。特征检测需要经过检测DoG金字塔中的极值点、除去低对比度的点和除去边缘响应点;其次,对检测到的特征点生成特征描述子。计算每个特征点梯度的幅值和方向,统计梯度方向直方图,生成特征描述子;最后,通过特征描述子进行特征匹配。通过Euclid距离来匹配特征描述子,采用相邻平行性、Hough变换和随机一致性采样RANSAC算法等约束,得到精确的匹配点对,采用最小二乘LS法来计算它们之间的空间变换矩阵,对待配准图像进行最终的变换操作,得到配准图像。

2.1 阈值参数的自适应优化

David将Euclid距离比阈值设为0.8[2],然而该参数并不是对所有图像均有效。在对不同的图像进行试验时,发现阈值并不总能得到最佳效果。为了使得该参数对不同的均有效,应使其对不同的图像进行自适应的动态调整和优化,即具有普遍适用性。衡量特征检测性能的参量如重复率(Repeatability)和信息量(Information Content)。重复率表达同一场景在不同情况下的稳定性,而信息量是特征点显著性的度量。实验中采用重复率来评价特征检测的性能,通过重复率来调控Euclid距离比阈值的设置。假设参考图像I1和待配准图像Ii,其公共部分检测到的特征点为和,它们匹配的定义为:

式中,H1i为变换矩阵,则重复率定义如下:

2.2 去除误配点的相邻平行性约束

误配点对仿射参数的求取、图像重采样和变换的影响较大,因此必须尽可能地剔除误配点。David指出[2],RANSAC算法的性能很好,但是在外点较多的情况下其性能将受到很大的影响。设每个点是内点的概率为p,则k个点均为内点的概率为pk,随机抽样S次,一致性的概率为P,Richard Szeliski指出[6]参数满足以下关系式:

所需要的最少抽样次数为:

当概率p<50%时,达到相同的一致性概率所需的运算次数较多,故在执行RANSAC算法之前,先进行Hough变换聚类操作。为了更有效地去除误配点,在Hough变换前加入相邻平行性约束。所谓相邻平行性约束,是指相邻的匹配点对具有相似的平行关系。计算各匹配点对之间连线的斜率,通过周围的匹配点对来判断该点对是否匹配。

3 实验结果及分析

3.1 将视频转换为序列图像

实验处理的对象是大桥上拍摄的监控录像。提取6幅图像,以其中1幅为参考图像,其他5幅为待配准图像。实验中,为了减少背景图像的影响,所处理的图像大小均取256×301。其中,各表中标号1代表参考图像,标号2,3,4,5,6分别代表待配准图像。作为示例,标号为1和2的参考图像和待配准图像的配准过程具体如下所述。

3.2 特征检测

通过领域比较得到候选的极值点,再对其进行筛选,除去低对比度点和边缘响应点,最终得到较稳定的极值点。所有图像特征点生成过程如表1所示。

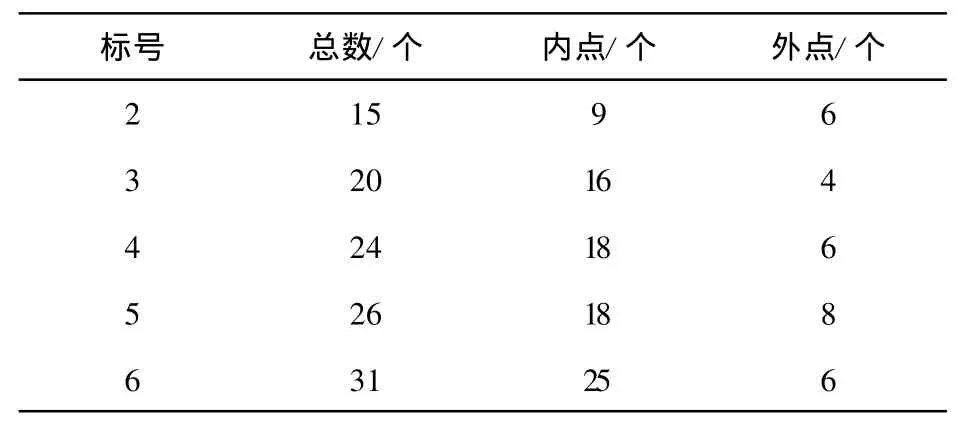

表1 6幅图像中极值点的数目

由表1可知,随着汽车向摄影头的方向移动,图像的尺度越来越大,检测到的特征点数目越来越多。

3.3 特征匹配

计算特征点对所确定的直线的斜率,并与相邻的特征点对直线斜率进行比较,当二者之间的差值超过一定范围时,则认为该特征点对不满足目前的匹配模式。同时,对已经匹配的特征点标记,不再计算该点与其他特征点之间的斜率,消除一点对多点和多点对一点的情况。通过实验得知,误配点得到了有效地的剔除。实验中各幅图像内外点数目如表2所示。

表2 待配准图像内外点数目

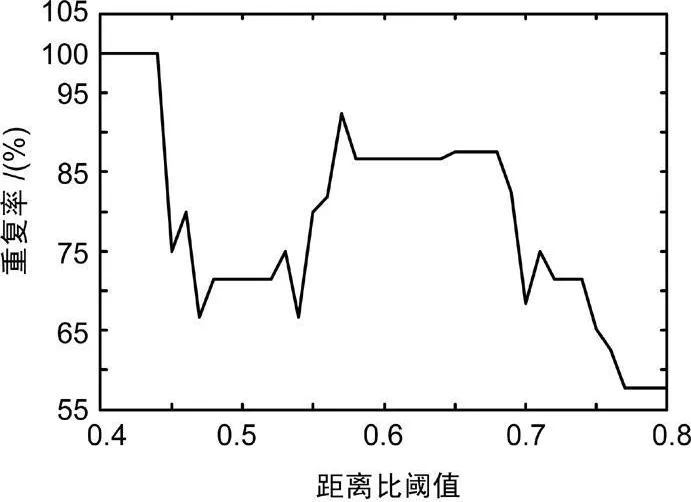

表2记录了除参考图像外的其余5幅待配准图像的内外点检测数目。内点是满足模型参数估计的点,外点是不符合模型的点。由表格可知,随着特征点总数的增加,模型内点的数目也在增多。距离比阈值与重复率的关系如图1所示。

图1 距离比阈值与重复率的关系

由图1可知,随着Euclid距离比的增加,重复率出现起伏变化。当Euclid距离比为0.4左右时,重复率接近于1。此时计算仿射参数的均方根误差,取最小均方根误差时所对应的距离比阈值。经计算得到,最小均方根误差为3.969 5×10-13,对应距离比阈值为0.43。得到的仿射变换矩阵如下:

通过矩阵A对待配准图像进行变换。

3.4 图像变换及重采样

在得到图像之间的变换矩阵后,对待配准图像进行变换,得到配准图像如图2所示。图2左上子图为参考图像,右上子图为待配准图像,左下子图为原SIFT算法配准后的图像,右下子图为改进SIFT算法配准后的图像。图2是以第1幅待配准图像为例的配准结果,其他4幅图像配准过程相同。

图2 原SIFT和改进SIFT配准后的图像

由图2可知,改进算法纠正原算法的扭曲现象,说明仿射参数的估计更准确,图像配准的效果更好。

4 结束语

尺度不变特征SIFT算法因其稳定性、独特性和多量性等优点,在图像处理领域发挥着越来越重要的作用。上述对SIFT算法阈值参数的设置进行了调整,使其具有自适应性;同时去除了部分错配的特征点。将改进后的SIFT算法用于视频序列图像的配准,实验表明算法性能得到了有效提高。后续工作将改进的算法应用于更多类型的图像,并采用更加有效的错配点消除方法,以实现更精确的图像配准。

[1]ZITOVA B,FLUSSER J.Image Registration Methods:a Survey[J].Image and Vision Computing,2003,21(11):977-1000.

[2]DAVID L G.Distinctive Image Features from Scale-invariant Keypoints[J].International Journal of Computer Vision,2004,60(2):91-110.

[3]MIKOLAJCZYK K,SCHMID C.A Performance Evaluation of Local Descriptors[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2005,27(10):1615-1630.

[4]SCHMID C,MOHR R.Christian Bauckhage Evaluation of Interest Point Detectors[J].International Journal of Computer Vision,2000,37(2):151-172.

[5]BROWN M,LOWE D G.Invariant Features from Interest Point Groups[R].Wales:British Machine Vision Conference,2002:656-665.

[6]SZELISKI R.Image Alignment and Stitching:a Tutorial[J].Foundations and Trends in Computer Graphics and Computer Vision,2006,2(1):1-104.