基于局部特征匹配的目标跟踪研究

2011-06-09肖秦琨刘向军

肖秦琨,刘向军

(西安工业大学 电子信息工程学院,陕西 西安 710032)

随着计算机视觉技术、信号处理和多媒体等技术的发展,视频监控系统得到广泛的应用。为了减少人力的参与和提高视频监控系统的智能化,研究目标跟踪的有效方法是非常有必要的[1]。运动目标跟踪利用目标点、线、区域块等特征对目标进行特征匹配,从而实现跟踪。比较典型的匹配算法有:Mean-shift算法、粒子滤波和模板匹配等。Mean-shift算法[2]采用颜色特征,计算量小、实时性好,缺点是灰度图像或纹理信息较少,图像的目标跟踪不能取得很好的跟踪结果,且目标存在遮挡和明显尺度变化时容易丢失目标。粒子滤波算法[3]作为一种基于贝叶斯估计的非线性滤波算法,在处理非高斯非线性时变系统的参数估计和状态滤波问题方面有独到的优势,但是作为一种新型算法对通用问题缺乏借鉴意义,实时性差且粒子滤波的收敛性尚未解决。模板匹配算法[4]是通过计算像素点邻域相似度来判断匹配度,算法简单,但该方法需遍历整张图片,计算量大,且目标形变、旋转、遮挡时,跟踪的鲁棒性较差。基于以上问题,研究基于Shape Context的目标跟踪算法具有良好的现实意义。

基于以上原因,文中提出了一种基于局部特征匹配的目标跟踪方法,该方法利用Shape Context[5]对目标边缘上点的相互位置关系进行匹配,对平移、旋转、遮挡等情况具有良好的鲁棒性。局部特征匹配的基本思想是:利用Shape Context提取目标的轮廓信息和特征,然后对两个目标特征点进行相似度比较,通过判断其相似度,利用预测投票的方法断定其质心位置进行匹配。

1 目标跟踪算法

目标跟踪常用的特征提取算法有:SUSAN算法、Harris算法等。然而这些算法在目标部分遮挡、形变等情况时,对目标提取的特征信息不准确,容易发生误匹配或无法找到匹配目标。而基于Shape Context的特征提取,是一种对目标的边界特征进行描述的方法,通过边界的局部特征匹配可以很好的确定目标。

1.1 Shape Context特征提取

轮廓能最直接描述一个物体,因而轮廓线上的一定数量的离散点可以表示一个物体的形状信息。Shape Context通过提取目标的轮廓边界信息,计算其相似度来描述目标的特征。

一幅图中,在边缘检测的基础上,可以得到一组离散的边界点点集,设点集为 Pi={p1,p2,…pn},对任一个点 pi,其余n-1个点与i点构成的向量组,能很好的反映该点在目标中的形状信息。

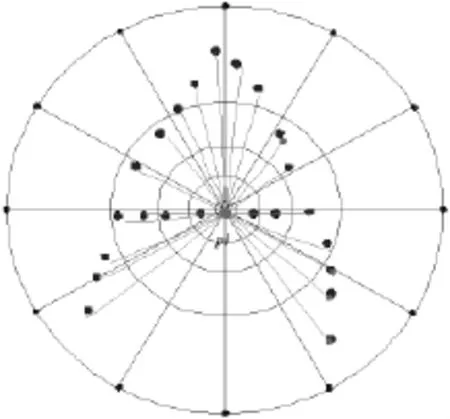

为直观反映Shape Context特征描述方法,我们引入一种类似雷达扫描系统的对数极坐标系,如图1所示:

图1 特征提取示意图Fig.1 Schematic of the feature extraction based on shape context

整个空间被分成 12×5=60个bin,对给定点pi,以该点为中心所成的极坐标系中,落入每个bin中像素点个数来描述。依次计算得到n个形状直方图,对任一物体的轮廓可以用n×60大小的矩阵表示。

1.2 特征匹配和目标跟踪

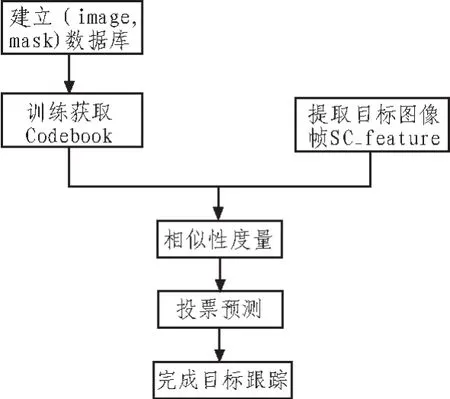

文中基于目标Shape Context特征信息,建立特征数据库,以特征数据库为中介,与被跟踪目标特征信息进行匹配,投票找出被测目标的质心和边界信息,从而确定被跟踪目标,如图2所示。

图2 文中目标跟踪流程图Fig.2 Flow chart of tracking

1)建立目标特征信息数据库

以人为例,建立10~20个目标的image、mask(轮廓信息)信息,训练得到目标的SC特征,生成codebook特征集D(D:包含 cek,k=1,...,n)。Codebook 中记录边缘点的 SC 特征,点与质心的相对位置等信息。

2)特征匹配

对被测目标进行边缘检测(edge_detection),提取目标图片帧的SC特征,与codebook中特征集进行比较。用Cost值评价两个点的相似度[6]。令Cs为Shape Context的Cost值。Cs就是基于 χ2-test的直方图距离统计值。g(k)和 h(k)分别表示待匹配的两幅图像对应点的直方图值。计算方法如下:

Cs值越小,相似度越大。

3)投票预测目标的质心

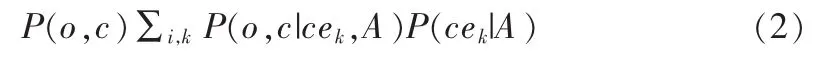

设被检测点A的SC信息为{fi},定义codebook中与fi匹配的cek的概率为P(cek|A),该点预测到的目标o的质心c的概率P(o,c|cek,A)。由此可得到被检测帧中目标的质心为:

由P(o,c)得到投票图,投票最大值即hypo_center。同时根据点对点的投票结果确定被检测目标的边界bbox_list。

与传统的目标跟踪算法不同,文中引入了Shape Context的统计直方图值进行相似度度量,这就克服了传统方法中目标旋转、平移等情况下难以匹配的问题,同时,采用预测估计的方法判断目标的位置,能够取得良好的匹配效果。

2 实验结果及分析

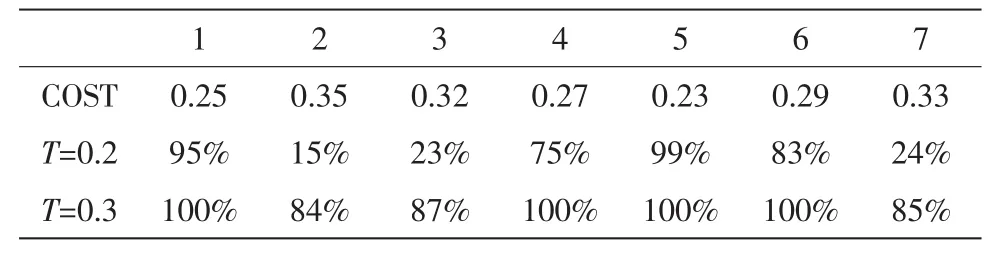

对于相似度度量,采用了COST值计算,我们选取前7副数据库中的图片与待检测的目标帧(第21帧)进行演示,计算结果演示如表1所示。

表1 COST值计算相似度Tab.1 Computing the sim ilarity of COST

表1中,T为阈值,COST为基于χ2-test的直方图距离统计值的平均值。通过实验,发现当阈值设定为T=0.3时,匹配率接近100%,很多情况下可作为经验值使用。

针对文中提出的特征提取方法,采用MATLAB进行算法的实现。

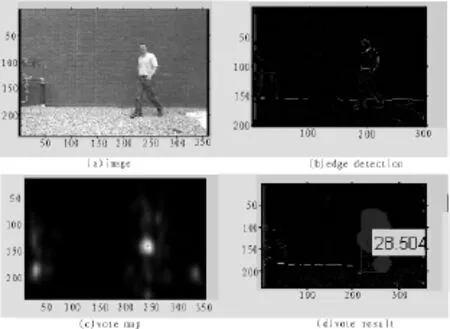

如图3所示,对于输入的原图像,首先我们进行边缘检测,对其进行SC_feature的提取,通过相似度量确定与codebook中的对应点。图(c)为投票的图,“+”位置代表投票的最大值。图(d)为通过多次投票得到目标的位置信息,显示出投票的结果。

图3 目标跟踪过程演示Fig.3 Object tracking experiment

图4 跟踪结果Fig.4 Tracking result

图4为多次投票后得到的多帧图像中的目标跟踪结果,由图4可见,文中提到的基于局部特征的目标跟踪算法是有效的。

图5 目标质心位置跟踪结果Fig.5 Trajectory of object center

为了直观的显示本文方法下目标跟踪的效率,建立了一个目标运动质心位置变化和投票预测得到的质心位置的对比图,如图5所示,“.”表示采用文中提到的方法进行实验得到的目标质心位置,“-”表示目标本身质心位置变化。从图中可以看出,本方法得到的目标质心位置和目标的运动轨迹基本相同,能够实现良好的跟踪效果。

3 结束语

根据目标跟踪中存在的诸多问题,文中详细研究了基于Shape Context特征提取算法进行目标跟踪,对目标旋转、变形、局部遮挡等问题具有良好的鲁棒性。文中的新颖之处在于:

1)与传统的目标跟踪算法不同,引入了Shape Context的统计直方图值进行相似度度量机制,对目标旋转、形变时具有良好的鲁棒性。

2)在相似度度量基础上,采用投票的方法对目标的位置进行预测估计,实验证明,这种方法能做到很好的匹配效果。

[1]朱宏.基于视频序列的运动目标检测与跟踪技术研究[D].成都:西南交通大学,2008.

[2]宋新,沈振康,王平,等.Mean Shift在目标跟踪中的应用[J].系统工程与电子技术,2007,29(09):405-409.SONG Xin, SHEN Zhen-kang, WANG Ping, et al.Application of mean Shift method in target tracking[J].Systems Engineering and Electronics, 2007,29(09):405-409

[3]Johnson N,Hogg D C,et al.Learning the distribution of object trajectories for event recognition[J].Image and Vision Computing,1996,14(1):609-615.

[4]Feng Z R,Lu N,Jiang P.Posterior probability measure for image matching[J].Pattern Recognition,2008,41(7):2422-2433.

[5]Belongie S, Malik J, Puzicha J.Shape context:a new descriptor for shape matching and object recognition[J].Neural Information Processing Systems,2001,13(3):831-837.

[6]Belongie S,Mori G,malik J.Matching with shape contexts[J].IEEE Workshop on Content-based access of Image and Video-Libraries,2000,11(3):961-967.